AI修图功能2026年进化到什么程度了?全面盘点

简单说:2026年的AI修图功能已经从"一键滤镜"进化到"对话式修图"——你用自然语言告诉AI想要什么效果,它就能帮你实现。速度和精度都比两年前强了不止一个量级。

你还记得2023年的AI修图是什么样吗?就是几个按钮:一键美颜、一键增强、一键去背景。效果嘛,凑合能用,但经常翻车。

才过了三年,AI修图功能的进化速度真的让人有点恍惚。我前两天用了一个工具,直接打字说"把背景换成咖啡馆,保持人物光影一致",出来的图我看了好几遍才确认不是合成的。

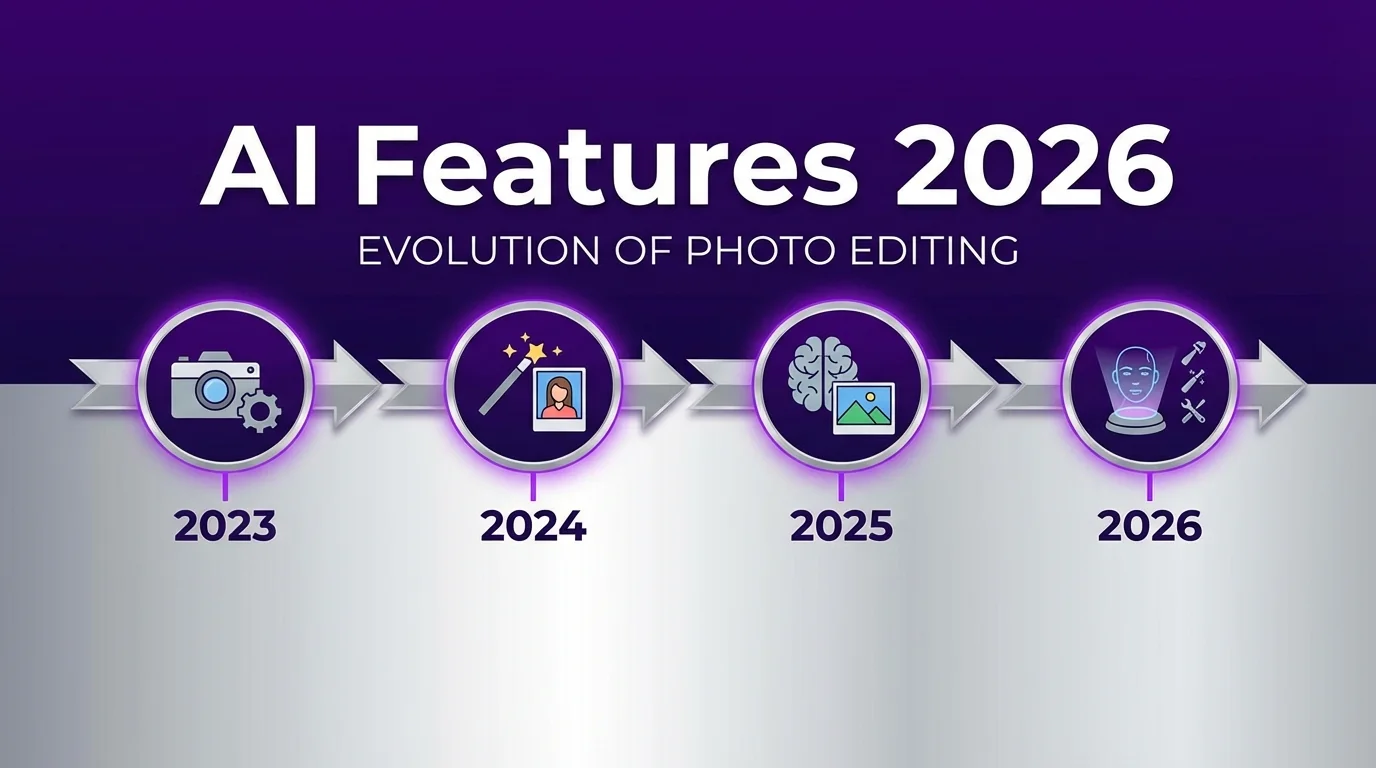

2023-2024年:一键式功能的黄金期

2023到2024年是AI修图"一键式"功能爆发的阶段,去背景、美颜、增强这些基础能力在这两年里从"能用"变成了"好用"。

那时候最火的就是一键去背景。说实话,2023年初的去背景效果还挺粗糙的,头发丝边缘经常锯齿状,半透明物体基本处理不了。但到了2024年底,主流工具的抠图精度已经能处理发丝、婚纱、玻璃杯这些复杂边缘了。

美颜功能也是这个阶段成熟的。从早期的"一刀切磨皮"(整张脸糊成一片)进化到了"智能分区美颜"——眼睛、鼻子、嘴巴、皮肤分开处理,保留五官立体感的同时去掉瑕疵。这个进步挺大的。

不过那时候的AI修图有个明显的问题:不够灵活。你只能在预设的功能里选,想要的效果如果不在菜单里,就没办法。就像点菜只能看固定菜单,不能自己说想吃什么。

2025年:生成式编辑的突破

2025年AI修图最大的突破是生成式编辑——不只是调整已有内容,而是能凭空"生成"新内容填充到图片里。

Adobe的生成式填充在2024年底就有了,但2025年才真正好用起来。你框选一块区域,打几个字描述想要什么,AI就能生成跟周围环境融合的内容。删个路人、加棵树、换个天空,都不在话下。

我试了下用它给一张室内照片加窗外风景——打字写"窗外是海边日落",生成的效果光影居然是对的,窗框上还有暖色的反光。这在一年前完全不可能。

根据Grand View Research的报告,2025年全球AI图像编辑市场规模达到了38亿美元,同比增长超过40%。生成式编辑功能是最大的增长驱动力。

这一年还有个重要变化:AI开始理解"语义"了。以前你说"把这个人变年轻",AI可能就是简单磨皮。2025年的工具能真正理解"年轻"意味着什么——皮肤紧致、轮廓饱满、眼神明亮,而不是一味地磨平。

2026年:对话式修图来了

2026年最让人兴奋的变化是对话式修图——你可以用自然语言跟AI聊天,一步步描述你想要的效果,AI实时调整。这感觉就像身边有个修图师在帮你干活。

我个人觉得这是AI修图的一个分水岭。以前你得懂参数、懂工具,现在你只要会说话就行。"把肤色调暖一点""背景再虚化一些""眼睛亮度提高但别太假"——这种模糊的、主观的描述,2026年的AI居然能理解。

不是所有工具都做到了这一步。目前做得比较好的有几家,但体验差距还挺大。有的只是套了个聊天界面,底层还是固定功能的排列组合。真正的对话式修图应该能处理多轮对话,记住你之前说过的偏好。

FlowPix团队最近也在关注这个方向,我们测试了不少对话式修图工具,发现一个有意思的现象:同样一句指令,不同工具的理解差异很大。"让这张照片更有电影感"——有的理解成加暗角,有的理解成调色温,有的理解成加胶片颗粒。这说明AI对"审美"的理解还在早期阶段。

局部精修的精度飞跃

2026年AI局部精修的精度已经到了像素级别,能单独处理一根头发丝、一颗痘印、一个毛孔。

这个进步可能普通用户感知不强,但对专业修图师来说是质变。以前AI处理局部细节,经常"误伤"周围区域——你想去一颗痣,结果旁边的皮肤纹理也被抹掉了。现在的AI能精准识别目标,只动该动的地方。

人像修图受益最大。发丝级别的抠图、单根睫毛的调整、瞳孔反光的增强……这些以前要在Photoshop里放大到200%一点点画的活,现在AI几秒钟搞定。想深入了解的话,可以看AI细节修图指南。

产品图也是。金属质感的高光、玻璃的折射、布料的纹理——AI现在能分别识别这些材质,针对性地增强。不像以前那样一刀切地拉锐度,结果金属过曝、布料噪点一起来。

视频帧修图:从静态到动态

AI修图正在从静态图片扩展到视频帧,2026年已经有工具能对视频逐帧做AI修图,而且保持帧间一致性。

这个方向我觉得是2026年最值得关注的趋势之一。以前修视频截图,每帧单独处理,色调经常不统一,看着闪。现在的AI能理解视频的时间连续性,前后帧的修图效果是平滑过渡的。

短视频创作者应该会很喜欢这个功能。拍的视频光线不好?AI逐帧增强。人脸有瑕疵?AI逐帧美颜,而且表情变化的时候美颜效果会跟着调整,不会出现某一帧突然"变脸"的情况。更多细节可以参考视频帧转高清照片那篇。

AI修图功能还有哪些没解决的问题

尽管进化很快,2026年的AI修图在创意审美、极端光线、复杂多人场景这几个方面还是不够靠谱。

审美这个东西太主观了。AI可以执行"把天空变蓝"这种明确指令,但"让这张照片更有感觉"这种抽象需求,它经常理解偏。每个人对"好看"的定义不一样,AI目前还做不到千人千面的审美适配。

极端光线也是个老问题。严重过曝或欠曝的照片,AI能救回一些,但细节一旦丢了就是丢了。物理上不存在的信息,AI也变不出来——它只能"猜",猜得像不像就看运气了。

多人合照的处理也还不够智能。五六个人的合影,AI很难同时把每个人都修好看。经常是这个人脸修好了,那个人脸变形了。这方面的合照修图技巧还是需要人工介入。

接下来会怎么发展

我个人判断,AI修图的下一步是"意图理解"——不需要你说具体怎么修,AI看一眼就知道这张图该怎么处理。

现在的对话式修图还是需要你给指令。但未来可能是这样的:你把图扔进去,AI自动分析场景、光线、主体,然后给你几个修图方案选。你选一个,它就执行。整个过程你不用说一个字。

听着有点科幻?其实已经有雏形了。有些工具的"一键增强"已经不是简单的固定算法,而是会根据图片内容动态调整策略。风景照侧重天空和色彩,人像照侧重肤质和五官,产品照侧重质感和背景。这就是"意图理解"的早期形态。

说了这么多AI修图功能的进化,最大的感受就是:变化太快了。两年前觉得不可能的事,现在已经是基础功能了。两年后会怎样?老实讲,我不敢预测。

如果你也在关注AI修图的发展,欢迎把这篇分享给同样感兴趣的朋友。也可以收藏一下,过半年回来看看我的预测准不准。