AI配音很假怎么办?让AI配音变自然的5个实用技巧

简单说:AI配音假主要是因为语速均匀、停顿生硬、情感缺失,通过调SSML标记、加呼吸音、控制语速变化、后期EQ处理和选对音色,可以让AI配音接近真人水平。

"AI配音太假了,听着像机器人。"这是我收到最多的反馈之一。2024年我刚开始用AI配音的时候也是这种感觉——每个字都太完美了,完美到不自然。后来花了三个月不断调试,终于找到了让AI配音变自然的系统性方法。今天就全部分享出来。

技巧一:用SSML控制节奏和停顿

SSML(语音合成标记语言)是解决"假"感最直接的工具。大部分AI配音平台都支持SSML,但很多人根本不知道用它。核心操作就三个标签:

- <break>:在自然断句处加0.3-0.8秒停顿,模拟真人呼吸节奏

- <prosody>:局部调整语速和音高,让关键信息有重音效果

- <emphasis>:给重点词汇加重语气,打破均匀感

举个实际例子。原句"这款产品的售价为299元",纯AI合成时每个字的速度一样。加上SSML后,在"售价"前加0.3秒停顿,"299"降速10%,听起来就像真人主播在强调价格。

详细操作可以看AI配音搭建指南,里面有SSML的具体写法。

技巧二:加入呼吸音和气口

真人说话不可能没有呼吸。AI配音最大的破绽就是"一口气读完不停"。解决方法是在长句中间插入微弱的呼吸音素材。你可以自己录几段呼吸声,然后用Audacity混合到AI配音中。

我试过在一个3分钟的AI配音里加了7个呼吸音点,听众反馈从"感觉有点假"变成了"没听出来是AI"。就这么简单的一个操作,效果立竿见影。

呼吸音的具体放置方法可以参考AI配音编辑教程。

技巧三:语速不要全程恒定

真人说话的速度是波动的——重要内容说慢点,过渡内容说快点。AI默认匀速输出,这就是"假"的根源之一。建议把长文案分成3-5句一组,每组之间设置不同的语速:

- 开场白:正常语速的95%

- 核心信息:正常语速的85%

- 过渡段落:正常语速的105-110%

- 结尾号召:正常语速的90%,加重情感

这种速度变化会让人感觉有"情绪起伏",大幅降低机器感。讯飞和微软Azure的TTS API都支持段落级别的语速控制。

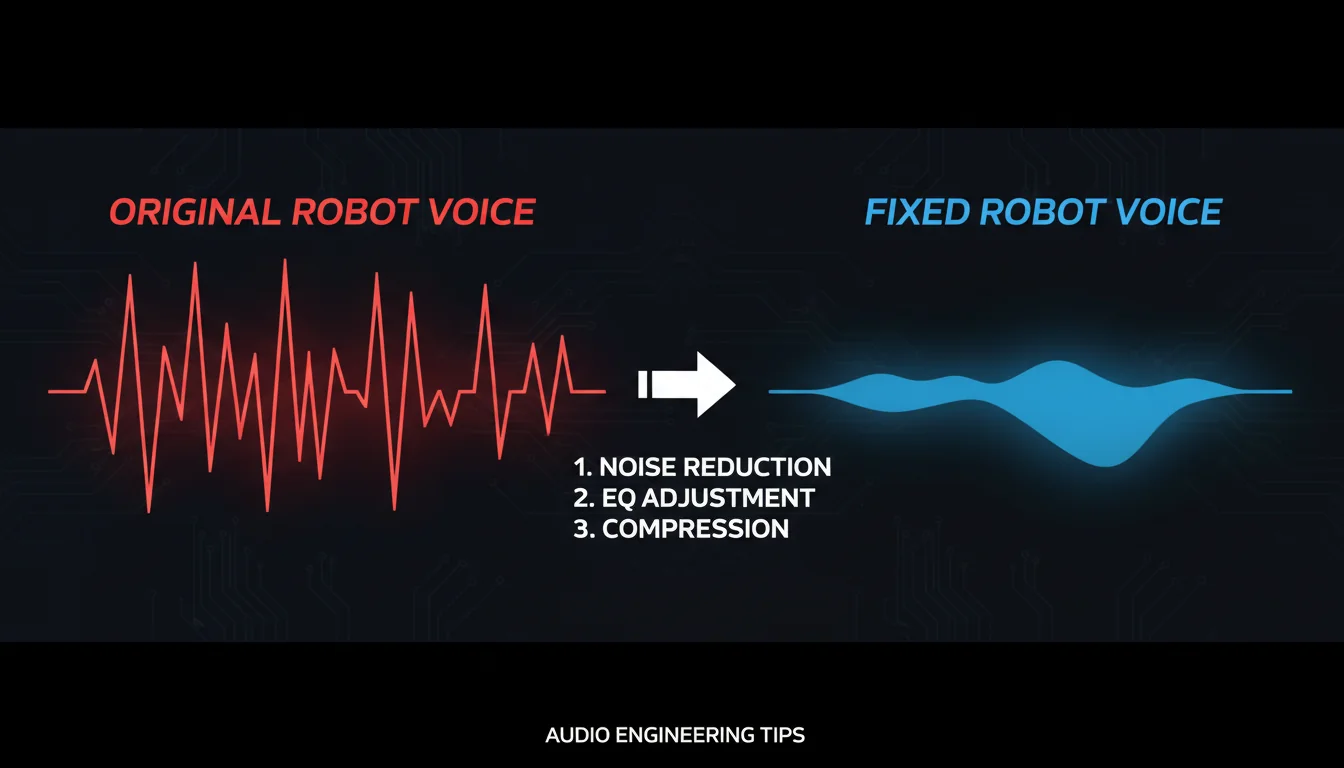

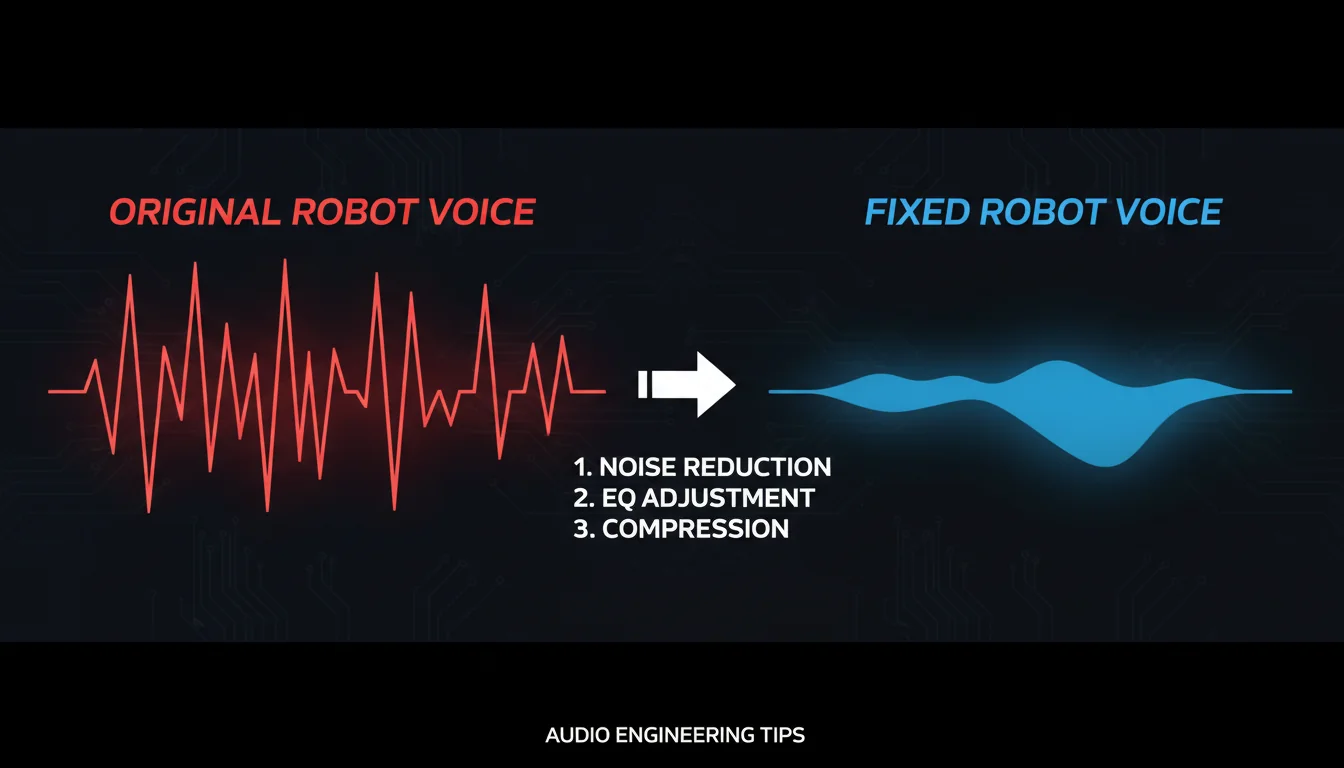

技巧四:后期EQ处理消除"数字味"

AI配音通常在3-5kHz频段有明显的"数字感",这是因为合成引擎的采样处理方式。用EQ把这个频段衰减2-3dB,同时略微提升200-500Hz的低频温暖感,效果会好很多。

我做过一个A/B测试:同一段AI配音,原版和EQ处理版给10个人盲听,8个人认为处理版是真人。频段调整的参数在配音编辑指南里有详细说明。

根据艾瑞咨询数据,中国AI语音合成市场规模已超50亿元,技术迭代速度很快。2026年的AI配音已经比两年前自然了很多,但如果不做任何后期处理,还是会有明显的机器痕迹。

技巧五:选对音色比什么都重要

不同平台的音色质量差距巨大。同样的文字,用讯飞的"小燕"音色和用某个不知名平台的默认音色,效果天差地别。选音色时注意三点:第一,选" expressive"或"情感"版本的音色,不要选基础版。第二,选跟你内容调性匹配的音色——严肃内容用沉稳音色,轻松内容用活泼音色。第三,一定要用你的实际文案试音,不要只听平台的demo。

我之前给一个客户选音色,demo听着都很自然,结果用他们的营销文案生成后,某些专业术语的发音特别奇怪。所以一定要用自己的文案测试。

音色和平台对比看这篇AI配音软件评测,合成技巧看AI合成配音教程。

我的失败教训:不要省后期

说一个真实失败案例。去年有个项目赶进度,AI配音生成后直接用了,没做任何后期。客户收到后非常不满意,说"这比我们自己读的还差"。后来花了2小时做SSML调整+EQ处理+加呼吸音,客户说"完全不一样了,这个可以用"。同一个AI引擎,区别只在后期处理上。

所以我的建议是:AI配音生成只是完成了一半,后期处理是另一半。两者缺一不可。FlowPix团队现在的标准流程里,后期处理时间占比超过40%。

掌握了这5个技巧,你的AI配音质量会有质的飞跃。觉得有用就收藏起来,分享给同样在用AI配音的朋友们吧!