AI修图算法揭秘:背后的GAN、扩散模型是什么

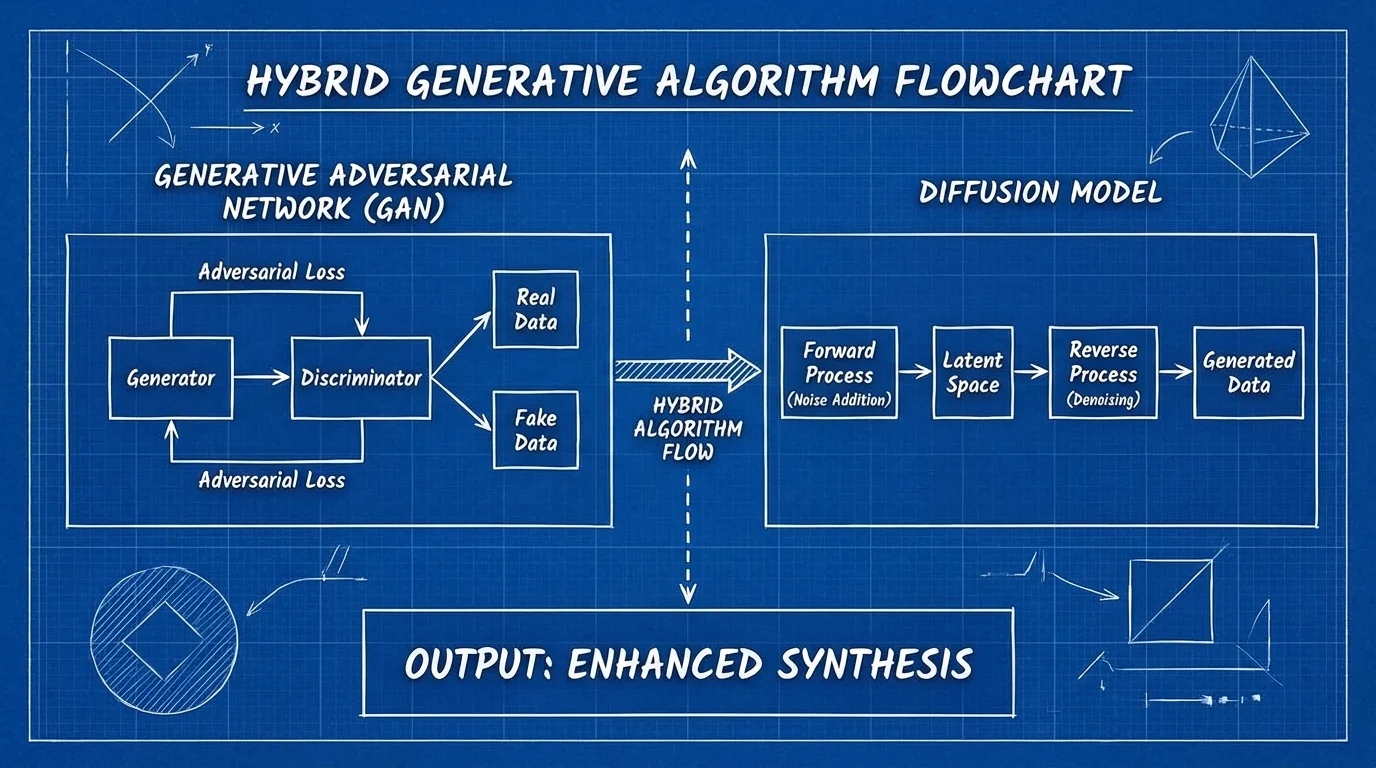

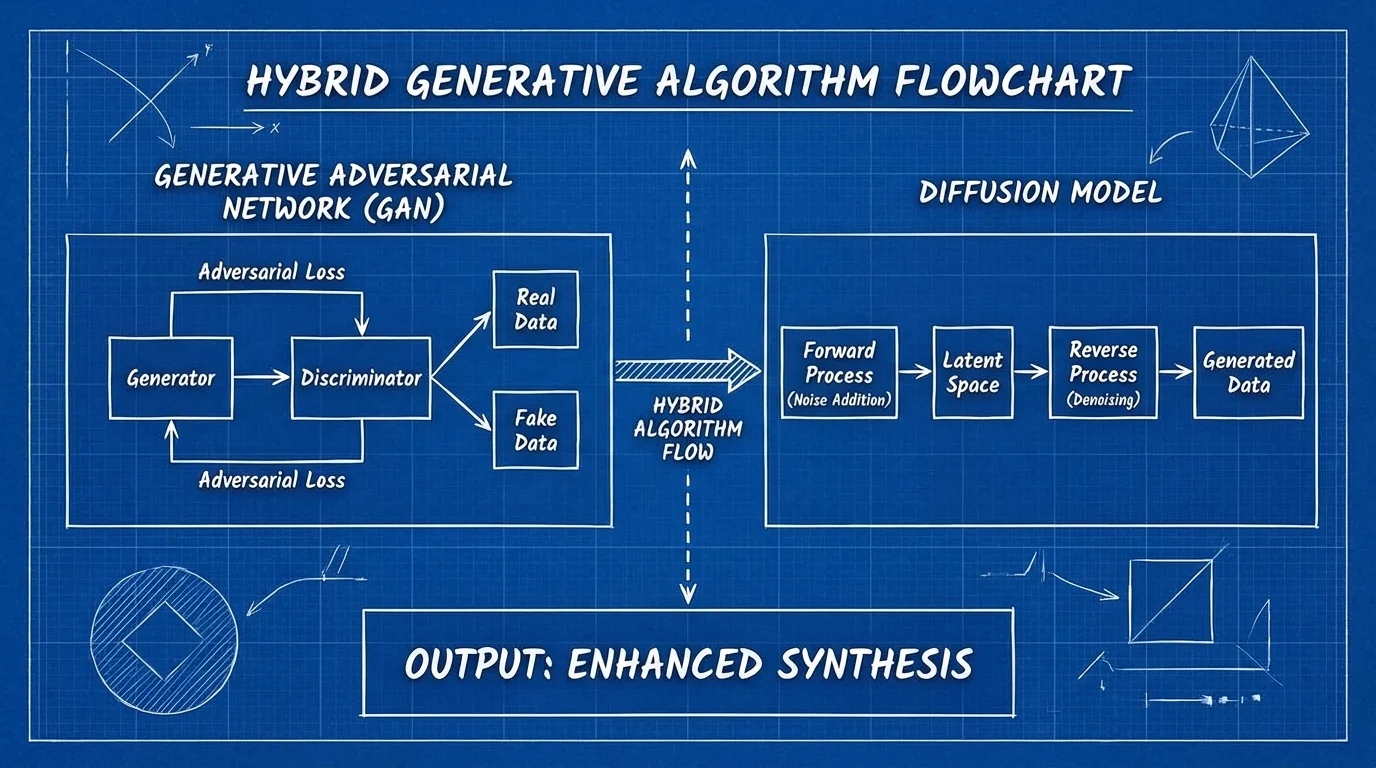

简单说:AI修图主要用GAN和扩散模型两种技术。GAN早几年流行,用于去噪、超分、风格迁移。扩散模型是现在的主流,Stable Diffusion、DALL-E都是。效果更好,但更吃算力。

AI修图背后是什么?

很多人好奇,一张照片扔进去,AI怎么就知道怎么修。FlowPix编辑部查了资料、问了做算法的朋友,用大白话讲清楚。

GAN:对抗生成

GAN就是两个AI打架,一个负责生成假图,一个负责鉴别真假。打到最后,假图越来越真。

Generator 生成假图,Discriminator 判断真假。Generator 想骗过 Discriminator,就得不断改进。这种对抗训练出来的模型,能生成很逼真的图像。

早期的 AI 换脸、风格迁移、去噪很多用 GAN。比如 Topaz 的部分算法、GFPGAN 人脸增强。GAN 的问题是训练不稳定,容易崩。

扩散模型:去噪生成

扩散模型反过来想——先给图加噪声,再让AI学怎么去噪。学好了,从纯噪声也能"去噪"出有意义的图。

训练时:给清晰图加噪声,加到最后变成纯噪声。AI 学这个过程的反向——从噪声恢复清晰图。推理时:从随机噪声开始,一步步去噪,最后得到图像。

Stable Diffusion、DALL-E、Midjourney 都用扩散模型。效果比 GAN 好,细节更丰富,训练更稳定。但算力需求大。

具体应用怎么用

抠图用分割模型,降噪用去噪网络,风格迁移用风格转换模型。不同任务用不同技术。

remove.bg 的抠图是语义分割——给每个像素分类,是主体还是背景。Topaz DeNoise 是去噪网络,学的是"噪声长什么样"然后减掉。风格迁移有的用 GAN,有的用扩散模型的 Img2Img。

FlowPix编辑部觉得:用户不用懂技术,知道"AI 是学出来的"就行。效果好不好,试了就知道。

| 技术 | 代表 | 特点 |

|---|---|---|

| GAN | GFPGAN、早期风格迁移 | 训练不稳定,效果不错 |

| 扩散模型 | Stable Diffusion、DALL-E | 效果好,吃算力 |

| 分割模型 | 抠图、去背景 | 任务专用 |

根据arXiv论文统计,2024-2025年图像生成领域扩散模型论文占比超过60%,GAN 占比下降。想了解技术趋势看AI修图趋势,电脑配置看AI修图配置。