AI Agent提示词怎么写?让AI自己干活的5个关键技巧

简单说:AI Agent不只是回答问题,而是能自己规划步骤、调用工具、完成整套任务。写Agent提示词需要定义清晰目标、明确工具权限、设计思考-行动-观察循环、设置异常处理、设定输出格式。

你有没有发现,2026年AI圈子里最热的词已经不是"大模型"了?

是Agent。

到处都在说AI Agent、Agentic Workflow、自主智能体。听着挺唬人的,但你真去看看实际的东西,会发现核心原理没那么玄乎——说白了就是让AI不只是回答一个问题,而是能自己规划步骤、调用工具、完成一整套任务。

我从去年开始折腾这个方向。起初是因为工作上有些重复性的事情实在太烦了——每周整理一次行业报告,每天筛选一遍邮件,定期更新数据报表。我就想,能不能让AI自己干?

折腾了几个月,踩了不少坑,现在终于摸出了一套还算好用的方法。今天FlowPix就把最关键的5个技巧分享出来。

先说说Agent和普通AI对话的区别到底在哪

Agent不一样,你给它一个目标,它自己拆解步骤、自己决定先干什么后干什么、遇到问题自己想办法解决。你跟ChatGPT聊天,是"你问一句它答一句",这叫单轮或者多轮对话,但本质上还是你在主导流程。Agent模式下你更像是一个甲方——提需求,验收成果,中间过程不用管。

Agent不一样。你给它一个目标,它自己拆解步骤、自己决定先干什么后干什么、遇到问题自己想办法解决。你更像是一个甲方——提需求,验收成果,中间过程不用管(或者少管)。

举个具体的例子。普通对话模式:你说"帮我分析一下竞争对手的定价策略",AI给你一段分析文字,完了。Agent模式:你说"监控5个竞争对手的价格变动,每周出一份对比报告,发现异常波动时立即提醒我"。它会自己去抓数据、自己做对比、自己生成报告、自己判断什么算"异常"。

差距很大对吧?但要让AI真正做到后者,你的提示词写法得完全不同。

5个写Agent提示词的关键技巧

定义清晰的目标和成功标准、明确可用的工具和权限边界、设计思考-行动-观察循环、设置异常处理和兜底机制、设定输出格式和检查点——这五个技巧是写Agent提示词的关键。普通提示词你说"帮我写篇文章"就行了,Agent提示词你得说清楚成功标准和输出格式。

技巧一:定义清晰的目标和成功标准

这个是最基本的,也是最多人忽略的。

普通提示词你说"帮我写篇文章"就行了。Agent提示词你得说清楚:"写一篇2000字的行业分析文章,包含至少5个数据来源引用,目标受众是创业者,完成后输出为Markdown格式并保存。"

为什么?因为Agent会自主决策。如果你没定义清楚什么叫"完成",它可能写了500字就觉得差不多了,也可能写了5000字还在继续。

关键原则:目标要可衡量。"写得好一点"不是好目标。"确保每段不超过100字、全文至少包含3个案例"才是好目标。

技巧二:明确可用的工具和权限边界

Agent的强大之处在于能调用工具。但你得告诉它:你能用什么,不能用什么。

这就像雇一个新员工。你不会说"你随便干吧"。你会说"你可以用公司的数据库查数据,可以用Slack给团队发消息,但不要动生产环境的服务器,花钱超过500块的事情先问我"。

同样的道理。一个好的Agent提示词里会包含:"你可以访问以下工具——搜索引擎、计算器、文件读写。在不确定的情况下,选择保守方案而不是激进方案。涉及到外部API调用时,先列出计划让我确认。"

不设边界的Agent要么什么都不敢干,要么干出你不想看到的事情。根据Anthropic的研究,明确设定Agent的工具权限和边界能显著提升任务执行的成功率和安全性。

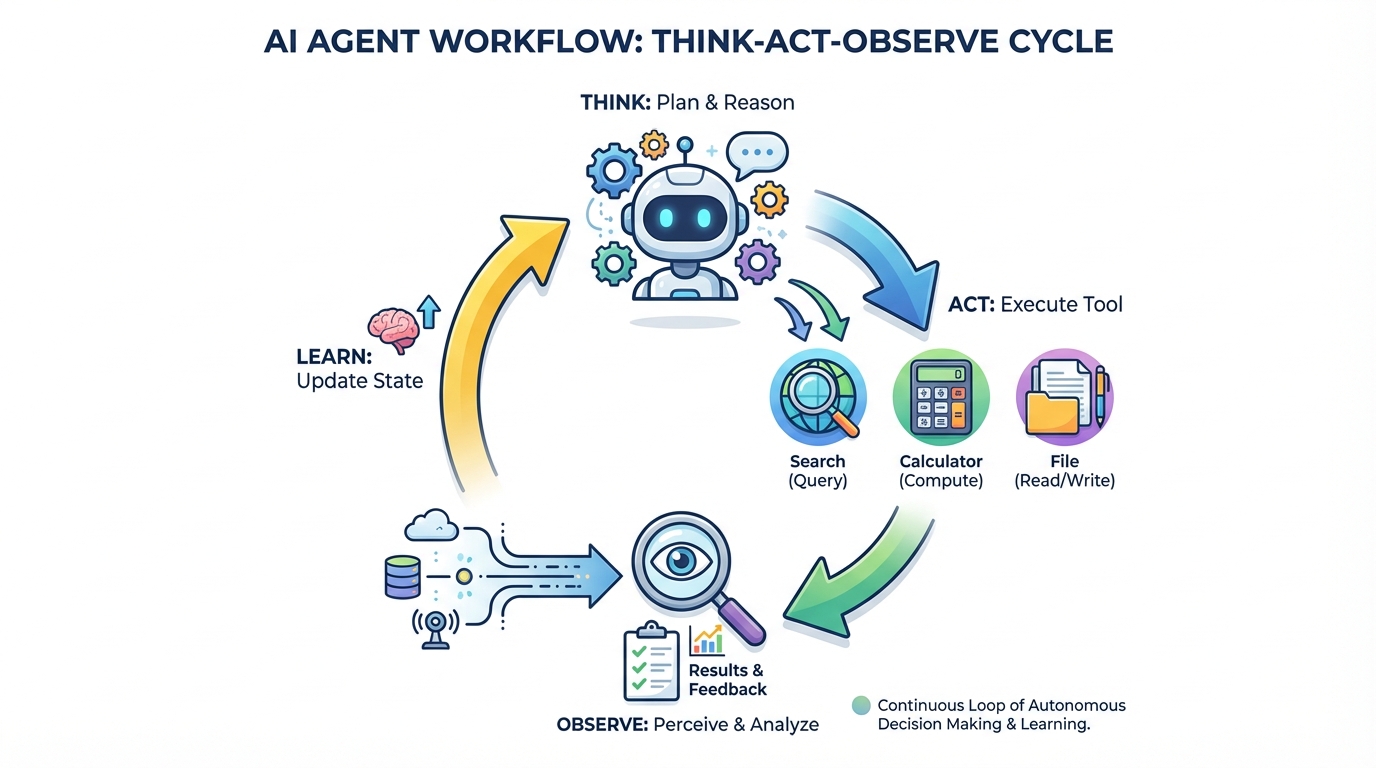

技巧三:设计"思考-行动-观察"循环

这是Agent架构里最经典的模式,叫ReAct(Reasoning + Acting)。

你在提示词里可以这么写:"对于每个步骤,请先说明你的思考过程(为什么要这么做),然后执行行动,最后观察结果并决定下一步。如果结果不符合预期,重新调整方案。"

这个结构为什么重要?因为它强制AI在行动之前想清楚,行动之后做复盘。不然它很容易一条路走到黑——第一步错了,后面全错,到最后你才发现白忙活。

我之前让Agent帮我做一个市场调研。没加这个结构的时候,它直接去搜索然后一股脑输出了一堆信息,很多是过时的、不相关的。加了"思考-行动-观察"之后,它每搜一轮都会先评估"这个信息靠不靠谱、跟我的目标有没有关系",最终报告的质量高了不止一个档次。

技巧四:设置异常处理和兜底机制

这个很多人不会想到。但如果你搞过编程就知道,任何自动化流程都得考虑"出错了怎么办"。

Agent也一样。你得在提示词里说:"如果搜索不到相关信息,标注为'数据缺失'而不是编造内容。如果某个步骤尝试3次都失败,跳过这个步骤并在最终报告中说明。如果你不确定某个判断是否正确,用'[待确认]'标记。"

不加这些,AI会怎样?它会编。找不到数据就自己编一个听起来很合理的数字,执行失败就假装成功了。这是AI的通病,不管是ChatGPT还是别的模型都一样。你不提前防住,后果可能很麻烦。

话说回来,现在AI行业的发展方向已经从拼参数转向拼可靠性了。Agent的可靠性,很大一部分取决于你提示词里的异常处理设计。

技巧五:设定输出格式和检查点

最后一个,也是让Agent真正实用的关键。

你得告诉它最终输出长什么样。"请以JSON格式输出""请用Markdown表格""请按照以下模板填写"——格式化输出不仅方便你阅读,更重要的是方便后续的自动化流程处理。

另外加一个"检查点"机制。比如说一个分五步的任务,你可以要求"完成第1步和第3步后,暂停并展示中间结果让我确认"。这样你不用等到最后才发现跑偏了,中间就能及时纠偏。

一个完整的Agent提示词长什么样

说了这么多零散的技巧,组合起来到底怎么写?给你一个我实际在用的框架:

目标定义:"你是一个[具体角色],你的任务是[明确目标]。成功标准是[可衡量的指标]。"

工具和权限:"你可以使用以下工具:[工具列表]。限制条件:[边界说明]。"

执行流程:"请按照'思考→行动→观察'的循环执行。每个步骤先说明意图,再执行,最后评估结果。"

异常处理:"遇到[具体情况]时,请[具体处理方式]。不确定的内容用[标记方式]注明。"

输出要求:"最终以[格式]输出。在第[N]步完成后暂停等待确认。"

这个框架是通用的。你拿它去写内容生产的Agent、数据分析的Agent、客服回复的Agent,都能用。核心就是把提示词写作的底层逻辑从"单次对话"扩展到"多步任务流"。想了解更多Agent开发的最佳实践,可以参考OpenAI的官方文档,里面有详细的Agent构建指南和示例代码。

Agent提示词的三个常见误区

第一个误区:一上来就写超级复杂的Agent。别。先从两三步的简单任务开始,跑通了再加复杂度。我见过有人第一次写就搞了一个15步的全自动流程,结果每一步都出问题,调试到怀疑人生。

第二个误区:完全不给限制。放飞自我的Agent很危险。我有次让一个Agent帮我群发邮件,忘了加"每天最多发50封"的限制,它一口气发了300多封。

第三个误区:期望Agent百分百可靠。目前不现实。2026年的AI Agent技术还在早期阶段,偶尔犯错是正常的。把它当成一个需要监督的实习生,而不是一个完全自主的员工。你想用AI搞副业赚钱,靠谱的方式是人机配合,不是完全甩手。

常见问题

哪些AI平台支持Agent功能?

截至2026年初,主流的有:ChatGPT的GPTs和自定义工作流、Claude的Tool Use、Google的Gemini Agent、微软的Copilot Studio、还有开源的LangChain和AutoGen框架。如果你不想碰代码,ChatGPT和Claude是最友好的选择。想要更大的灵活性,LangChain值得学一学。

Agent提示词跟普通提示词的核心区别是什么?

最大区别在于:普通提示词关注"这一次对话的输出质量",Agent提示词关注"整个任务流程的执行逻辑"。你要考虑的不只是措辞,还有步骤拆解、工具调用、错误处理、输出规范这些流程层面的东西。

不会写代码能用AI Agent吗?

能。现在很多平台都提供了无代码的Agent构建方式。比如ChatGPT的GPTs,你纯靠自然语言描述就能搭建一个Agent。当然,会代码的话能做更复杂的事情,但入门门槛并没有很多人想象的那么高。

Agent会不会胡说八道(幻觉问题)?

会。所有AI都有幻觉问题,Agent也不例外。而且Agent因为是多步执行,如果一步产生了幻觉,后面的步骤可能会在错误的基础上继续推进,导致"错误放大"。这就是为什么我在技巧四里强调异常处理的重要性——你得教它在不确定的时候停下来,而不是硬往前冲。

Agent能处理多复杂的任务?

目前来说,5-10步的任务流程比较靠谱。超过15步的长流程,出错概率会明显上升。我的经验是:如果一个任务超过10步,考虑拆成几个子Agent分别执行,然后用一个主Agent来协调。就像管理团队一样——一个经理带3-5个人好管,带20个人就得分组了。