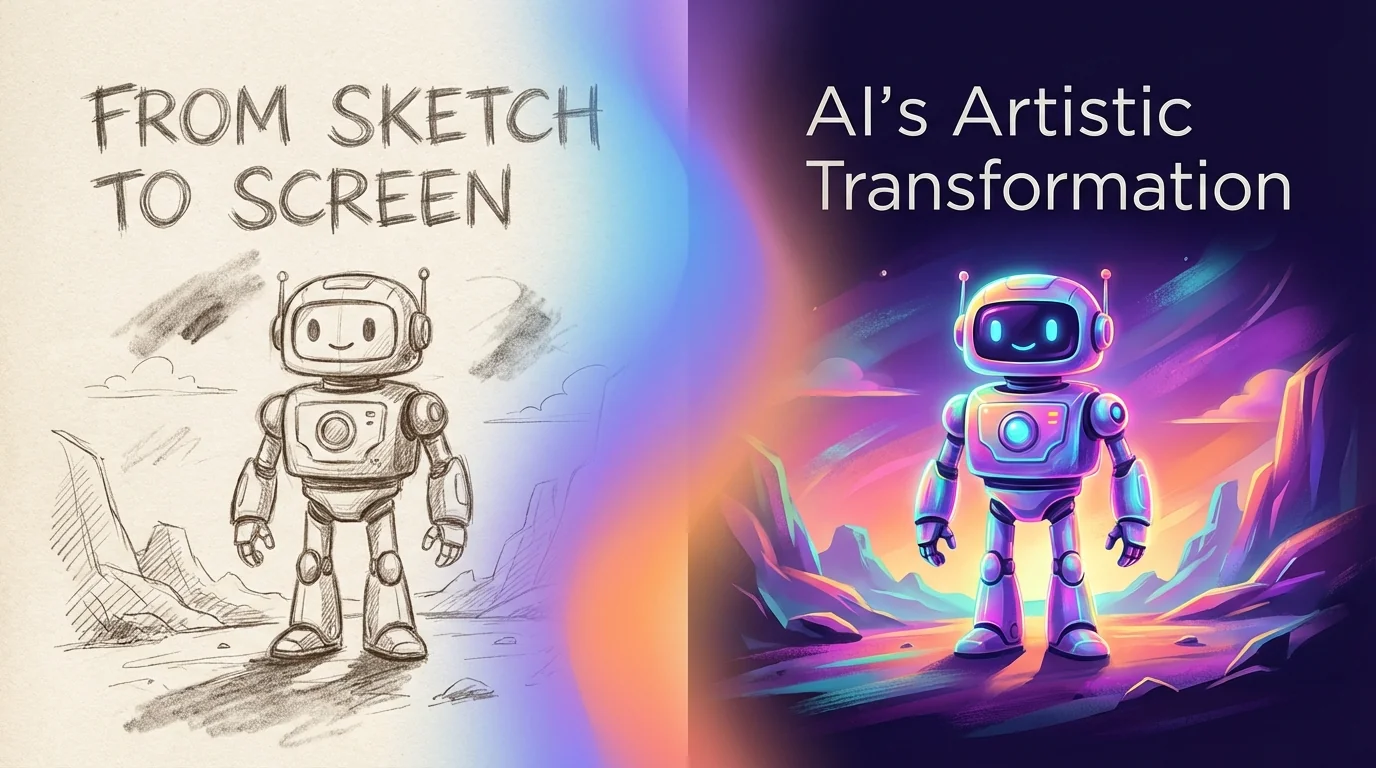

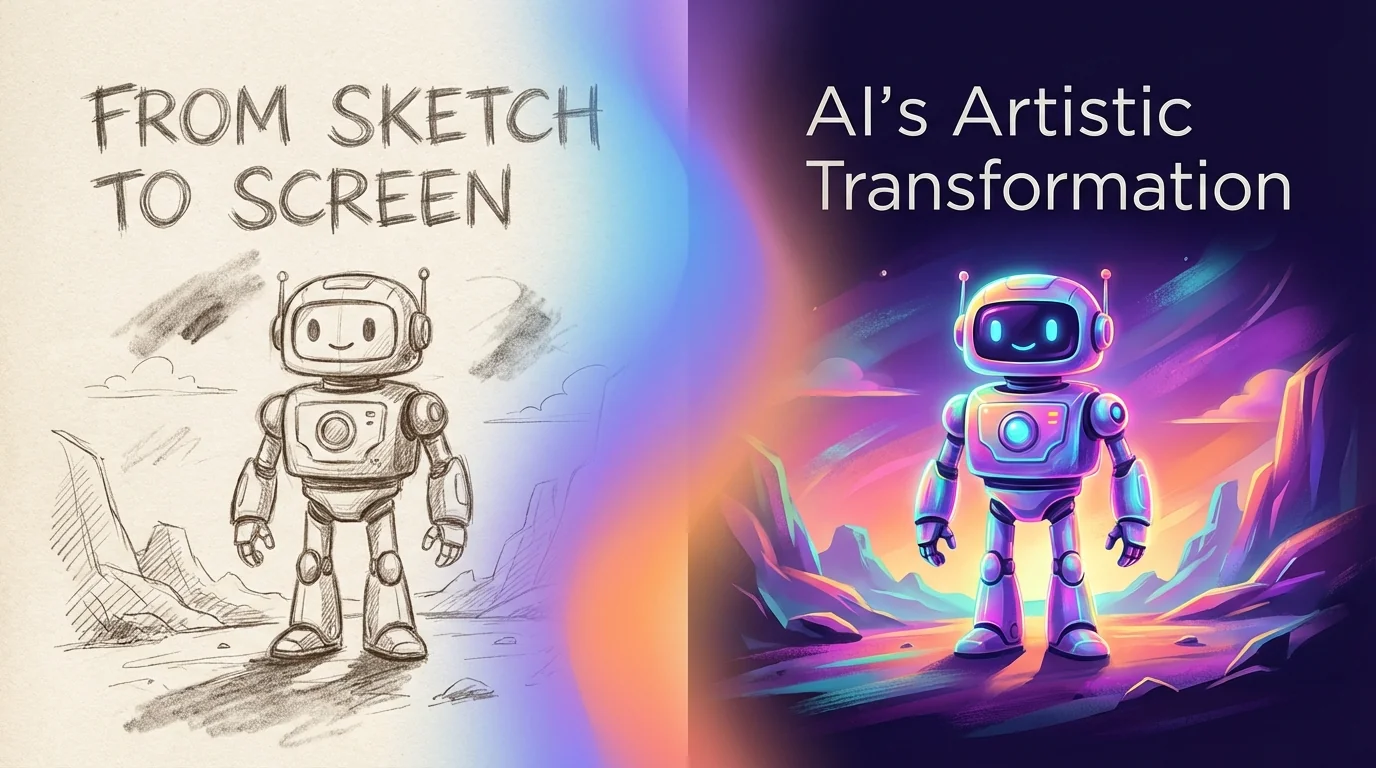

AI修图草图变成品:从涂鸦到精美插画的完整流程 - FlowPix

简单说:用AI把草图变成精美插画,核心流程就三步——画个大概轮廓、选对工具、写好提示词。ControlNet配Stable Diffusion效果最强,怕麻烦就用在线工具。整个过程比你想的快得多。

你有没有过这种经历?脑子里有个画面特别清楚,笔拿起来一画,出来的东西跟鬼画符一样。

我就是这样。

去年底有个项目需要几张概念插画,找外包报价两千一张,交期一周。我当时心想——要不试试AI?于是拿iPad随手涂了个草图,丢进ai修图草图工具里跑了一下。二十秒后看到结果的时候,说实话,有点不真实。那个歪歪扭扭的线条居然变成了一张光影完整、细节丰富的插画。省了八千块。(当然也让我对自己的画技产生了更深的怀疑。)

AI草图变成品到底怎么回事

AI草图变成品的原理是:模型识别你画的线条结构和空间关系,把它当成"骨架",再根据提示词往上面"长肉"——补充色彩、材质、光影和细节。这个过程在技术上叫做条件生成(Conditional Generation)。

打个比方。你的草图就像建筑图纸的框架线,AI是那个同时兼任设计师、材料师和灯光师的超级装修队。你只需要告诉它"我要北欧风"还是"我要工业风",剩下的它全包。

2024年ControlNet论文发布之后,这项技术进步特别快。根据arXiv上的ControlNet原始论文数据,在草图条件引导下的图像生成准确率比纯文本生成提升了约45%。到了2026年,市面上工具的效果又上了一个台阶。

不过有一点要心里有数:AI不是读心术。你画一个圈它不一定知道那是苹果还是篮球。关键信息还是得靠提示词补齐。

选哪个工具——看你愿不愿意折腾

怕折腾的用在线工具(Krea AI、Scribble Diffusion),想要专业级效果就上ControlNet + Stable Diffusion本地部署。中间还有些半在线方案可以选。

我把市面上主流工具都试了一遍,给你列个表:

| 工具 | 上手难度 | 成品质量 | 费用 | 我的评价 |

|---|---|---|---|---|

| Scribble Diffusion | 极低 | 中等 | 免费 | 验证想法够了 |

| Krea AI | 低 | 中上 | 免费/订阅 | 实时预览很爽 |

| ControlNet + SD | 高 | 最高 | 免费(需显卡) | 正经出活首选 |

| Midjourney + --sref | 中 | 高 | $10/月起 | 风格稳定,但控制力一般 |

| Adobe Firefly | 低 | 中上 | Creative Cloud订阅 | 版权最安全 |

说真的,工具之间的差距没有很多人吹的那么大。对于80%的使用场景,随便哪个都能出不错的结果。差别主要在极端需求上——比如你要精确控制某个局部的光源方向,或者需要保持多张图之间风格高度统一,那就非ControlNet不可了。

完整流程:从涂鸦到成品的每一步

完整流程分五步:构思草图、清理线稿、选择工具和模型、编写提示词、迭代微调。下面一步步拆开说。

第一步:画草图

别在这一步纠结太久。

草图的目的是传达构图和大致形状,不是展示画功。用纸笔画完拍照也行,iPad上随便涂也行,甚至用鼠标在画图板里拖几下都行。重点是把你脑子里的画面"倒"出来。

几个建议:

- 人物——把头、身体、四肢的位置和比例大致画对

- 场景——地平线的位置很关键,前景中景远景的分布画出来

- 物品——外轮廓画准就行,内部留白让AI发挥

有次我偷懒画了个三角形加几条横线,提示词写"cyberpunk city skyline at night",出来一张赛博朋克城市夜景。三角形变成了一栋发光的摩天大楼。AI的脑补能力真的离谱。

第二步:清理线稿(可选但推荐)

如果你的草图线条太乱——比如反复描了很多遍、擦过的痕迹还在——最好清理一下。

怎么清理?最简单的方法是用手机拍照后调高对比度,让线条更清晰、背景更干净。讲究一点的可以用AI草图转照片工具先把线稿提取出来。

不过如果你是用数字工具直接画的,这步基本可以跳过。

第三步:选工具和模型

这里分两种情况说。

在线工具路线(5分钟出图):

- 打开Krea AI的实时画布

- 上传或直接画草图

- 输入提示词描述你想要的风格

- 实时看到AI的"翻译"结果

- 满意就导出高清版

Krea的实时预览是个杀手级功能。你画一笔它就变一下,那种交互感很上瘾。

本地部署路线(效果天花板):

- 装好Stable Diffusion WebUI(推荐用Stable Diffusion修图教程里的方法)

- 安装ControlNet扩展

- 下载Scribble或Lineart预处理器模型

- 在txt2img界面打开ControlNet面板

- 上传草图,选Scribble预处理器

- 写提示词,调参数,生成

第一次配置大概要折腾一两个小时,看你电脑环境。配好之后每次出图就几秒钟的事。

第四步:提示词决定一切

草图管构图,提示词管风格。这两样一个都不能拉胯。

我总结了几套好用的提示词模板——

精美插画风:

digital illustration, highly detailed, vibrant colors, fantasy art style, dramatic lighting, artstation trending

水彩手绘风:

watercolor painting, soft colors, gentle brush strokes, paper texture, delicate details, artistic

赛博朋克风:

cyberpunk style, neon glow, dark atmosphere, futuristic, rain reflections, cinematic composition

日系动漫风:

anime style, clean lineart, cel shading, bright colors, detailed background, studio quality

这里有个小技巧:在提示词最前面加上你想要的整体质量描述,比如"masterpiece, best quality"。听起来很玄学,但确实管用——SD模型训练的时候就是这么打标签的。

想了解更多动漫风格的调法,可以看看AI动漫风格修图教程。

第五步:迭代微调

第一次生成的结果能直接用的概率?老实说大概30%。

不满意怎么办?几个方向:

- 调整ControlNet权重(0.4-0.8之间试)——权重高了太像草图,低了AI太自由

- 换个提示词描述方式

- 改预处理器(Scribble换成Canny或者Lineart试试)

- 在草图上加细节再跑一遍

通常迭代三四次就能拿到满意的结果。这比从零画一张插画快多少?我的体感是快10-20倍。

上色这件事——AI比你想的聪明

AI修图草图上色不需要你指定每个区域的颜色,只要在提示词里描述整体色调和氛围,模型会自动分配合理的配色方案。当然你也可以画一张简单的色块图来精确控制。

上色是草图变成品里最"魔法"的环节。一张黑白线稿丢进去,出来的配色经常让我觉得"我自己配都配不出这么和谐"。

FlowPix编辑部之前做过一个小测试:同一张草图,只改提示词里的色调描述词,生成了暖色调、冷色调、高饱和、低饱和四个版本。效果差异巨大,但每个版本自身的配色都很协调。AI在色彩搭配上真的有天赋(或者说,它学了太多好作品)。

想更精准地控制颜色怎么办?画一张和草图一样大小的色块图——不用画细节,就是大块大块地涂颜色——然后用ControlNet的IP-Adapter或者Reference模式加载进去。效果很稳。

插画成品的质量提升技巧

想让AI生成的插画从"还行"变成"真的能用",关键是高清放大、局部重绘和后期调色这三板斧。

生成出来的图一般是512x512或者768x768。直接用?太糊了。

放大的方法:

- SD WebUI自带的Hires. fix——生成时直接放大到2倍

- 用Extras里的ESRGAN放大器——后期放大到4倍甚至更高

- Topaz Gigapixel AI——商业软件,效果最好但要花钱

局部不满意怎么办?用Inpainting。比如脸生成得不好,就用蒙版把脸圈出来,单独重新生成那个区域。这招特别实用,FlowPix团队日常出图基本每张都会用到。

最后一步是后期调色。我一般会丢进Lightroom或者Snapseed里调一下整体色温和对比度。AI生成的图有时候颜色会稍微过饱和,拉一拉就自然了。更多基础调整可以参考AI修图入门指南。

哪些场景适合用草图变插画

说几个我见过的真实案例吧。

一个独立游戏开发者,美术预算几乎为零。他自己画角色草图,用AI生成概念设定图,美术风格统一得还挺好。游戏上架Steam之后评价里好几个人夸画风。

一个做绘本的妈妈(没学过画画),用AI把孩子的涂鸦变成了一本完整的故事绘本。我在小红书上看到的,点赞过万了。

还有做电商的,产品图需要配场景插画。以前找设计师画一套要大几千,现在自己涂个草图就能出。

不过我也遇到过不太行的场景——需要超精确的工程制图、医学插图这种专业领域,AI的理解力还是差一截。它可以画得很好看,但"准确"和"好看"不是一回事。

踩过的坑和避坑指南

最常见的坑是草图太模糊、提示词太笼统、以及ControlNet权重没调好。这三个问题占了"出图不满意"原因的80%。

具体展开说——

草图太模糊:线条断断续续的,AI容易在断开的地方"自由发挥"。解决办法就是关键线条画连贯,哪怕其他地方随意一点。

提示词太笼统:写"a beautiful illustration"基本等于没写。你得告诉AI具体要什么风格、什么色调、什么光源方向。越具体越好。

ControlNet权重太高:设成1.0的话,AI会非常"忠实"你的草图,连那些你不小心画歪的线都保留。建议从0.5开始试。

还有个隐藏的坑——分辨率。如果你的草图尺寸和生成尺寸差距太大,效果会很奇怪。最好把草图缩放到和目标输出一样大再丢进去。

说到手绘效果的AI手绘草图照片特效,也有些类似的技巧可以参考。

2026年值得关注的变化

今年有几个挺有意思的趋势。

一个是Stability AI最新推出的Stable Diffusion 3.5,在草图理解方面强了不少。之前的版本对复杂场景的空间理解比较弱,3.5这一块改善明显。

另一个是视频领域。有人已经开始用草图序列+AI生成短动画了。虽然目前帧间一致性还不够好,但方向是对的。再过一两年,画个分镜草图就能直接生成动画短片,我觉得完全有可能。

还有一个不太被注意到的变化:手机端工具越来越强了。去年在手机上跑AI生成基本不可能,现在好几个App已经能做到实时草图转图了——虽然质量比电脑端差点,但够用于快速验证想法。

我的日常工作流

分享一下我自己的习惯吧,不一定是最优解,但确实好用。

平时有想法的时候我会直接在Procreate上随手画,一般花两三分钟。然后用AirDrop传到电脑上(没用iPad的话拍照也行),丢进ComfyUI跑ControlNet。提示词我存了一个模板库,根据风格需求复制粘贴再改几个词。生成四张图,挑最好的那张做Inpainting修细节,最后放大到4K输出。

整个流程大概20分钟。

半年前同样的事情要么花两天自己画,要么花两千块外包。这效率提升太实在了。

好了,基本就是这些。从一团涂鸦到一张能用的插画,AI确实把门槛压得很低。你不需要会画画——你只需要知道自己想要什么,然后让AI去实现。对于画技一般但有想法的人来说,这简直是梦寐以求的工具。

觉得这篇教程有用的话,分享给你身边同样"手残但有想法"的朋友吧。也欢迎在社交媒体上分享你用AI草图生成的作品,看看谁的涂鸦变成品更惊艳。