AI修图算法揭秘:美颜磨皮背后的技术原理 - FlowPix

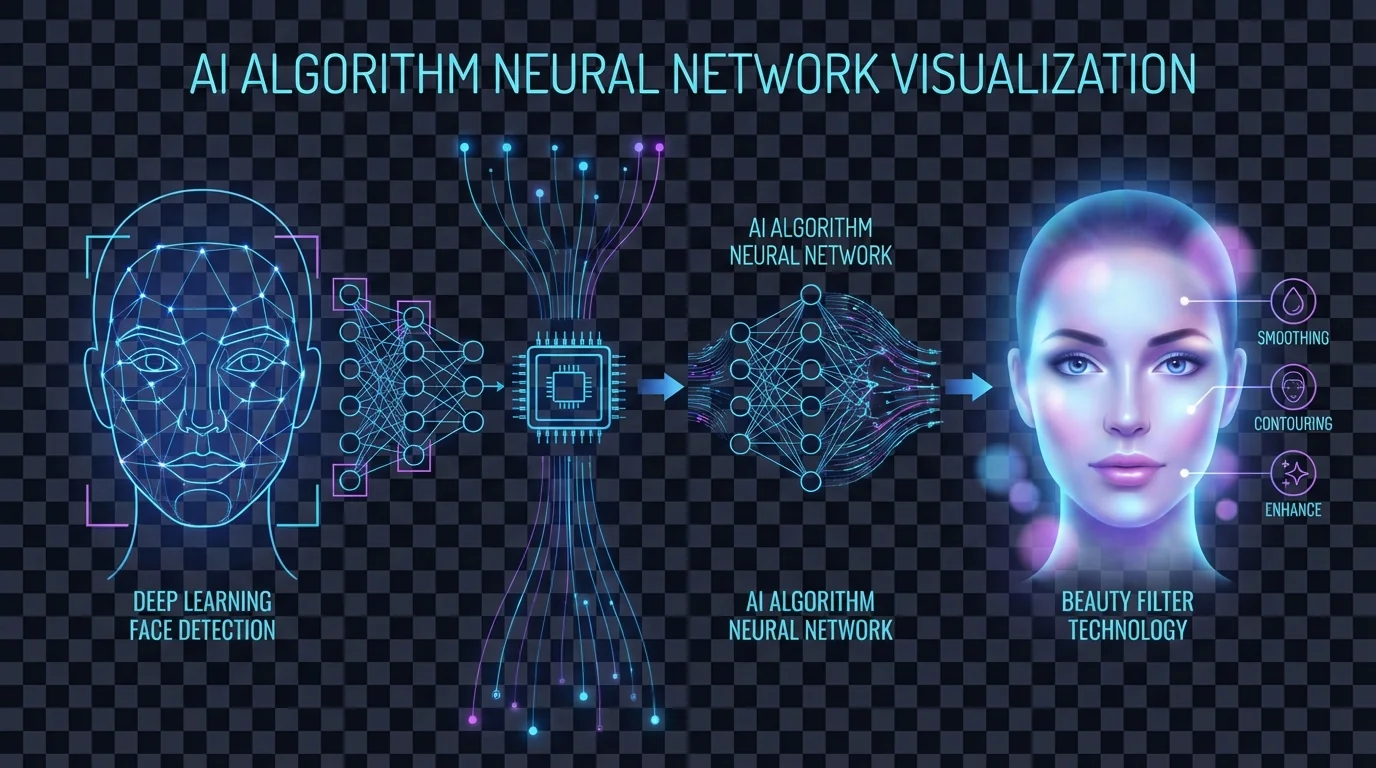

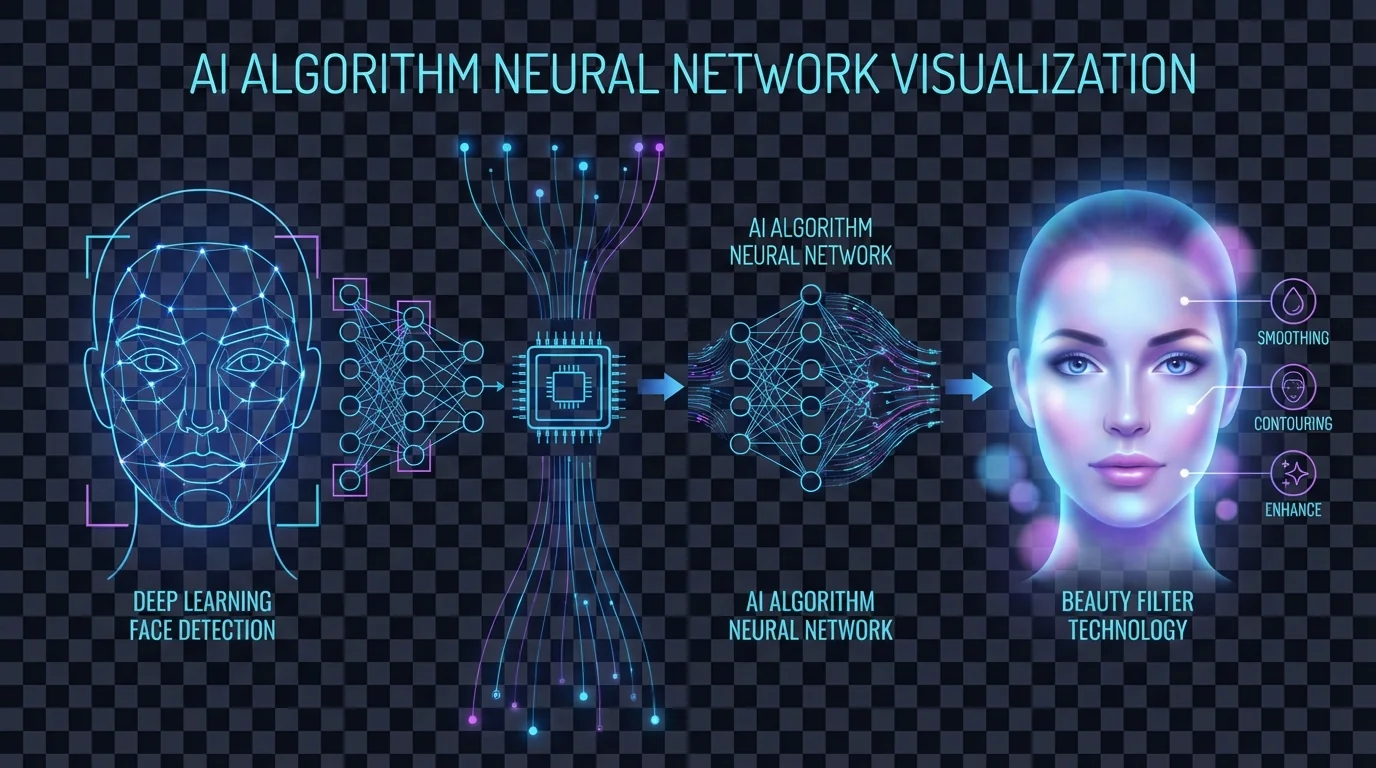

简单说:AI修图算法的核心是卷积神经网络和语义分割——磨皮靠双边滤波+皮肤区域识别,抠图用编码器-解码器网络做像素级分割,画质增强则是超分辨率重建。看懂这些,你就知道手机一键美颜背后在算什么了。

AI修图算法揭秘:美颜磨皮背后的技术原理

你有没有好奇过:点一下"美颜"按钮,手机凭什么几秒钟就把痘痘磨没、肤色提亮?AI修图到底在后台干了啥?

去年有个做产品经理的朋友跑来问,说她负责的美颜App被用户吐槽"修完像塑料人",想搞清楚能不能从算法层面改进。我帮她捋了一遍市面上的AI修图算法思路,顺带把美颜、抠图、画质增强这三块的技术原理都拆了拆。下面这段,就是给想搞懂"AI修图怎么工作"的人看的——不写公式,讲人话。

美颜磨皮:不只是高斯模糊

现在的AI美颜磨皮不是简单的高斯模糊,而是先识别皮肤区域,再用双边滤波或深度学习模型做"保边磨皮"——把痘印毛孔抹掉,同时保留五官和头发丝的清晰度。

老一代磨皮思路很简单:整张脸糊一层模糊滤镜。结果呢?皮肤确实光滑了,但眉毛、嘴唇、睫毛也跟着糊成一片,看起来很假。2015年之后大家开始用双边滤波——这种算法会根据相邻像素的亮度差来决定模糊强度,亮度差大的地方(比如鼻梁和脸颊交界)少模糊,亮度接近的地方(比如额头一大片)多模糊。皮肤区域自然变光滑,边缘不会被吃。

再往后就是深度学习上场。训练一个美颜算法模型,输入原始照片,输出"皮肤分割掩码"——哪块是皮肤、哪块是五官、哪块是头发,先标出来。然后只对皮肤区域做处理:降噪、磨皮、肤色均匀。有的模型还会学"保留毛孔纹理"——磨掉痘印但留一点细微的皮肤质感,避免塑料感。根据Grand View Research 2025年报告,全球AI图像编辑市场年复合增长率接近34%,美颜和人像增强是核心驱动场景之一。

想让人像修得更自然、别太假,可以看AI修图如何更自然,里面讲到参数怎么调。

智能抠图:像素级语义分割

智能抠图靠的是编码器-解码器结构的语义分割网络——先把图片压缩成特征图,再逐像素预测"这是前景还是背景",最后还原成精确的抠图蒙版。

传统抠图要手动画选区、调羽化,头发丝这种细节基本靠手描。AI抠图的思路完全不同:给模型喂大量"人像+精确蒙版"的训练数据,让它学会"看见人就能自动描边"。网络结构一般是编码器(如ResNet)提取特征,解码器(如U-Net)把特征还原成跟原图一样尺寸的分割图——每个像素一个概率值:1表示前景,0表示背景,0.7表示"可能是头发丝边缘"。

头发丝之所以能扣得干净,是因为模型学了边缘的纹理和透明度。半透明区域(发丝、纱裙)会输出灰度值,而不是硬切。这也是为什么现在的remove.bg这类工具,头发再乱也能抠得比较自然——背后就是这套语义分割架构。FlowPix之前写过手机自带AI修图功能盘点,很多机型已经把抠图做到相册里了,点一下就出蒙版。

画质增强:超分辨率重建

画质增强的AI算法主要依赖超分辨率网络——通过学习"低清到高清"的映射关系,给模糊、低分辨率图片补出细节,而不是简单锐化。

传统做法是拉锐化、提高对比度,但噪点也会跟着放大。AI超分的思路是:训练时喂大量"成对的低清-高清图",让模型学会"这种模糊块在高清版里通常对应什么纹理"。推理时,输入一张糊图,模型根据周围像素和学到的先验,逐块"猜"出更清晰的版本。人脸、文字、建筑边缘这些高频信息,模型尤其擅长补。

不过有个坑:AI补出来的细节不一定是"真实"的,可能是模型幻觉出来的纹理。老照片修复、证件照放大,效果通常不错;但法律证据、医学影像这类对真实性要求极高的场景,AI超分要慎用。想了解画质相关工具怎么选,可以参考2026年免费AI修图工具排名,里面有几款专门做画质增强的。

算法之外:参数和审美

算法再强,最后呈现的效果还是被"强度参数"和"审美取向"决定的。同样的模型,磨皮拉到100%和30%完全是两种画风。

很多用户吐槽"AI修完像假人",多半是默认参数太激进。美颜算法出厂设置往往会偏"讨好眼球"——磨皮拉满、肤色统一、大眼瘦脸一起上。懂一点原理的人会把这几个滑块往回调,让算法"少做一点",保留更多原片特征。AI修图最佳参数配置里写过一套通用区间,照着调能避开塑料感。

再一个是训练数据的审美偏向。模型学的是训练集里的"大多数人觉得好看"——如果数据偏东亚审美,修出来可能偏白偏柔;偏欧美的话,立体感和肤色会不一样。这也是为什么同一款App,有人觉得刚好,有人觉得怪。算法本身没问题,是"默认审美"跟你预期不一致。

看懂算法有什么用

了解AI修图算法原理,能帮你更好理解"为什么这里修得好、那里修崩了",也能在选工具、调参数时少踩坑。

知道磨皮是"保边"的,你就明白——边缘清晰、皮肤光滑,多半用了双边滤波或深度学习分割;整张图糊成一片,那是老一代高斯模糊没迭代。知道抠图靠语义分割,你就理解——为什么头发丝能扣、但透明玻璃瓶有时会翻车(训练数据里玻璃瓶样本少)。知道超分是"猜细节"的,你就不会拿AI放大的图当铁证用。

说实话,对普通用户来说不用深入到底层。但如果你做产品、做设计、或者单纯好奇"这玩意儿咋做到的",搞清这几个核心概念,心里会踏实很多。FlowPix编辑部经常测各类修图工具,算法层面的差异在实际出片上真的能看出来——修图后期全用AI行不行那篇里对比过人工和AI的差距,跟算法能力边界直接相关。

AI修图算法背后的东西大致就这些。如果你身边有朋友好奇"美颜到底咋修的"、或者想入行做图像算法,把这篇转发给他们看看呗。也欢迎在微博或小红书分享你的使用体验,咱们一起聊。