AI修图背后的模型原理:超分、修复、美颜都靠它 - FlowPix

简单说:AI修图背后的核心模型主要有四类——超分辨率模型(放大不糊)、图像修复模型(去瑕疵补内容)、美颜模型(识别人脸做局部调整)和风格迁移模型(套滤镜换风格)。它们基本都是基于深度神经网络训练出来的,用海量图片数据"教会"AI什么是好看的照片。

AI修图背后的模型原理:超分、修复、美颜都靠它

你点了一下"AI增强"按钮,照片就变清晰了。你画了一下擦除笔刷,路人就消失了。你开了美颜滑块,皮肤就变细腻了。

但这些"魔法"背后到底发生了什么?

我不打算写成一篇学术论文——那种东西看了也头疼。今天用大白话来聊聊ai修图模型的底层逻辑,不需要任何技术背景,能看懂人话就行。

先搞清楚一个基本概念:什么是"模型"

在AI修图的语境里,"模型"就是一个经过大量图片训练的程序,它学会了"好照片应该长什么样",然后按照这个标准去修改你的照片。你可以把它理解成一个看过几百万张照片的修图大师——它不用思考,靠经验直觉就知道这里该亮一点、那里该模糊一点。

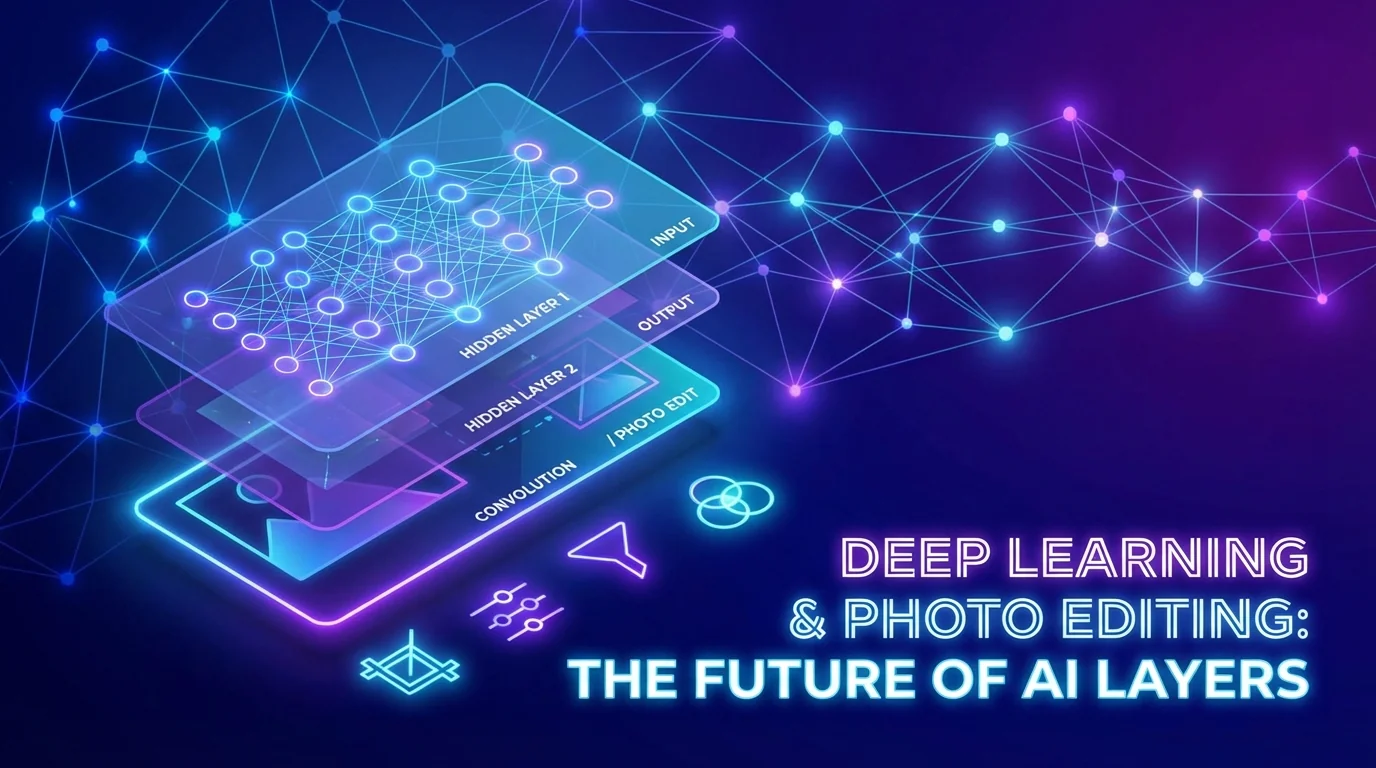

技术上来说,这些模型大多是"深度神经网络"(Deep Neural Network),结构上有很多层——输入层接收你的照片,中间几十上百层做处理和变换,输出层给出修改后的结果。每一层都在做一些数学运算,叠加起来就能完成复杂的图像处理任务。

听起来玄乎,但你不需要理解数学细节。你只需要知道:模型越大(参数越多),通常效果越好,但运行也越慢。这就是为什么有些AI修图功能在手机上比在电脑上效果差——手机跑不动大模型,只能用压缩过的小模型。

超分辨率模型:让模糊照片变清晰

超分辨率模型的原理是"从低分辨率的照片中推测出高分辨率版本应该有的细节"。它不是真的在"恢复"丢失的信息,而是根据训练数据中学到的模式"生成"看起来合理的细节。

举个生活化的例子。你拍了一张模糊的路牌照片,上面的字你看不清。AI超分模型看了之后,它不是真的知道那个字是什么——它是根据笔画的大致轮廓、周围字的风格、以及训练时见过的无数路牌照片来"猜"那个字最可能是什么。大多数时候它猜对了,但偶尔也会猜错。

主流的超分模型经历了几代演进:

- SRCNN(2014)——最早的深度学习超分模型,只有三层,效果有限但开创了先河

- ESRGAN(2018)——用上了GAN(生成对抗网络),效果有了质的飞跃,生成的细节更真实

- Real-ESRGAN(2021)——专门针对"真实世界"的模糊照片优化,处理手机照片、微信压缩图效果特别好

- 基于Diffusion的超分(2023-2026)——用扩散模型做超分,效果最好但也最慢,目前主要用在桌面端

根据Papers with Code的基准测试,2025年最先进的超分模型在4倍放大任务上的PSNR(峰值信噪比)已经达到了33dB以上,比2018年的ESRGAN提升了约3dB。这个提升幅度在图像质量上是很显著的。

FlowPix编辑部在评测AI修图工具时,超分功能是必测项目之一。我们的经验是:2倍超分基本可以信赖,4倍超分要看具体模型——好的模型细节自然,差的模型会出现"AI塑料感",就是那种过于清晰但不真实的奇怪质感。更多工具对比可以看2026年AI修图工具合集。

图像修复模型:擦除和填充的秘密

图像修复(Inpainting)模型的核心任务是"把被遮挡或删除的区域补全"。它分析周围像素的纹理、颜色和结构信息,然后生成一个与周围环境融合的填充内容。你在用AI擦除路人、去水印、修复老照片的时候,背后跑的都是这类模型。

早期的图像修复用的是"纹理复制"方法——简单地从周围复制相似的纹理贴上去。效果嘛,就像用贴纸盖住一样,边缘都很生硬。

现在的修复模型已经聪明得多了。它不只是看周围的像素,而是"理解"了整张图的内容。比如你擦掉了草坪上的一个人,AI知道那个区域应该是草坪,它会生成符合整体光照方向、草丛纹理走向的草地来填充——而不是简单地复制旁边一块草地贴上去。

LaMa(2021年发布的大蒙版修复模型)是这个领域一个重要的里程碑。它的特别之处是能处理非常大面积的修复区域——以前的模型修个小痘痘还行,要擦掉半栋楼就不行了。LaMa引入了快速傅里叶卷积来捕获大范围的结构信息,让大面积修复变得可行。

2024-2026年,基于扩散模型的修复方法又把质量推到了新高度。Adobe的生成式填充就是用的这类技术——你不仅能擦除物体,还能用文字描述让AI在那个区域生成全新的内容。想深入了解擦除操作的话可以看AI擦除精准操作指南。

美颜模型:不只是磨皮那么简单

现代AI美颜模型包含人脸检测、面部关键点定位、皮肤区域分割、纹理分析四个步骤,然后才是对皮肤做平滑处理。这比早年那种"全图高斯模糊"精细了几个量级。

2015年之前的"美颜"基本上就是给脸部区域加一层模糊滤镜。效果嘛——眉毛也糊了,嘴唇也糊了,鼻孔都快看不见了。那个时代的美颜照,现在回头看简直是恐怖片。

现在的AI美颜,流程大概是这样的:

- 人脸检测——先找到照片里哪些区域是人脸。用的是MTCNN、RetinaFace这类检测模型

- 关键点定位——标出眉毛、眼睛、鼻子、嘴唇、下巴的精确位置,通常是68个或更多关键点

- 皮肤分割——把"皮肤"区域和"非皮肤"区域(眉毛、睫毛、嘴唇等)精确分开

- 纹理分析——在皮肤区域里分析哪些是"正常纹理"(毛孔)、哪些是"瑕疵"(痘痘、色斑)

- 选择性平滑——只对"瑕疵"区域做平滑,保留"正常纹理"

你看,这比简单的模糊复杂多了吧?这就是为什么好的美颜工具磨完皮之后皮肤还有质感——它不是无差别地磨平一切,而是精准地只处理该处理的地方。

瘦脸、大眼这些功能用的是另一种技术——"面部网格变形"。AI在脸上建立一个三角形网格,然后通过移动网格顶点来改变脸部形状。做得好的瘦脸算法会同时调整光影,让变形后的脸看起来自然;做得不好的就会出现"果冻脸"——脸倒是小了,但背景跟着一起歪了。

风格迁移模型:滤镜的AI版本

风格迁移模型的原理是把一张"风格参考图"的色调、笔触、纹理特征提取出来,然后"注入"到你的照片中,让你的照片获得那种风格——比如油画风、赛博朋克风、电影胶片风。

2015年Gatys等人发表的论文《A Neural Algorithm of Artistic Style》是这个领域的开山之作。他们发现卷积神经网络(CNN)的不同层捕获了不同级别的信息——浅层捕获色彩和简单纹理,深层捕获复杂的结构和语义。把"风格图"的浅层特征和"内容图"的深层特征组合起来,就能生成既保留原图内容又带有新风格的图片。

说得再通俗一点:就像是AI学会了某个画家的"画法"——用什么颜色、怎么画笔触、明暗怎么分布——然后用这种画法重新"画"一遍你的照片。

现在手机上那些一键"动漫风"、"油画风"、"复古胶片"的功能,很多就是用这类模型做的。早期的风格迁移模型要跑好几分钟,现在的实时风格迁移已经能在手机上做到即时预览了。进步很大。

不过我个人觉得,大多数风格迁移滤镜用在艺术创作上挺有趣,但用在日常修图里嘛……不太好控制。效果好不好全看运气,不像手动调色那样精确可控。

这些模型怎么训练出来的

AI修图模型的训练基本上是"给AI看大量的好照片和差照片的配对,让它学会怎么把差照片变成好照片"。这个过程需要海量数据、强大的计算资源和精心设计的训练策略。

以超分辨率模型为例。训练数据是这么准备的:拿一批高分辨率的好照片,人为地把它们缩小、加噪、模糊,变成"低质量版本"。然后让AI学习从低质量版本恢复成高质量版本。训练的过程就是不断调整模型参数,让它的输出越来越接近原始的高质量照片。

这个过程用到的数据量很惊人。一个像样的超分模型通常需要几十万到几百万张训练图片,在多张高端显卡上训练几天到几周。Real-ESRGAN的论文里提到,他们的训练数据包含了从几千个不同来源收集的数据集,训练过程使用了4张NVIDIA V100显卡。

这也是为什么大厂(Adobe、Google、三星)的AI修图效果通常比小公司好——他们有更多的数据、更多的计算资源、更多的工程师来优化模型。

未来AI修图模型的趋势

2026年及之后,AI修图模型的三个明显趋势是:文本引导的精确编辑(用自然语言描述你想要的修改)、实时处理越来越流畅、以及模型越来越小但效果不打折扣。

文本引导编辑是最让我兴奋的方向。想象一下——你不需要学会各种调色参数,直接对AI说"把天空调成夕阳的颜色,人物皮肤保持不变"。Adobe的Firefly和Google的Imagen已经在往这个方向走了。这对不会用调色面板的普通人来说是真正的降维打击。

端侧实时处理也在快速进步。2024年苹果的A18芯片已经能在手机上跑相当复杂的AI修图模型了,Google的Tensor G4也不遑多让。到2026年,很多以前只能在电脑上跑的AI修图功能,在手机上也能做到即时预览了。

模型压缩技术(剪枝、蒸馏、量化)让模型越来越小。一个2023年需要几百MB的模型,通过这些技术可以压缩到几十MB甚至几MB,效果损失很小。这意味着修图App不需要那么大的安装包了,加载速度也更快。

了解原理对你修图有什么帮助

可能你会问——我又不做AI研发,知道这些原理有什么用?

有用的。当你知道超分辨率是靠"猜"的,你就不会盲目信任4倍超分的结果,你会在超分后仔细检查细节是否自然。当你知道美颜模型是逐区域处理的,你就理解了为什么局部选区美颜比全图美颜效果好(可以看看AI区域选择操作指南了解更多)。当你知道风格迁移是提取浅层特征,你就能预判哪些风格效果好(简单纹理的风格)、哪些效果差(复杂细节的风格)。

知道工具的边界,才能更好地使用工具。这话不是鸡汤,是修图实战里真的有用的认知。

觉得这篇科普有意思的话,分享给你身边对AI修图感兴趣的朋友吧——搞明白原理之后再动手,效率翻倍。