AI修图和智能修图是一回事吗?不同"智能"等级解析 - FlowPix

简单说:AI修图和智能修图不是一回事。智能修图是个大筐,从手机自动美颜到专业AI精修都往里装。真正的AI修图特指用深度学习模型处理图片,而很多自称"智能"的修图工具其实只是传统算法加了个滤镜。

AI修图和智能修图是一回事吗?不同"智能"等级解析

你打开手机应用商店搜"修图",会看到一堆App名字里带"智能"或者"AI"。AI修图、智能美颜、AI一键修图、智能滤镜……这些词看着差不多,实际上差老远了。

上个月我给一个开影楼的表姐推荐修图工具,她说"我已经用了智能修图了呀"。我问她用的什么,她说手机相机自带的美颜。我差点没绷住——那也叫智能修图?

严格来说,它确实算。但跟真正的AI修图智能修图比,那差距就像骑自行车和开高铁——都叫"交通工具",但不是一个物种。

"智能"这个词被用烂了

市面上90%以上打着"智能修图"旗号的产品,用的根本不是AI技术,而是传统图像处理算法加个自动化外壳。

你可能不知道,手机相机里的"智能美颜"大多只是做了这么几件事:检测人脸位置→根据预设参数磨皮→提亮肤色→微调五官比例。这些操作用的是传统的计算机视觉算法(人脸检测用的是Haar特征或者HOG特征),2010年就有了的技术。

但厂商不会告诉你这些。他们就写个"智能美颜"、"AI一键美化",听起来多高端。

真正的AI修图是什么概念?是用深度学习模型(通常是卷积神经网络或者扩散模型)来"理解"照片的内容,然后做出有创造性的处理。比如AI可以判断这张照片是逆光的→自动做HDR合成→同时保留暗部细节和亮部层次——这个决策过程是模型从几百万张照片里"学"来的,不是程序员手写的if-else规则。

根据arXiv上的论文统计,2024-2025年间发表的图像增强相关论文中,超过85%使用了深度学习架构。学术界早就全面转向了,但消费级产品还在拿传统算法冒充AI。

修图的四个"智能"等级

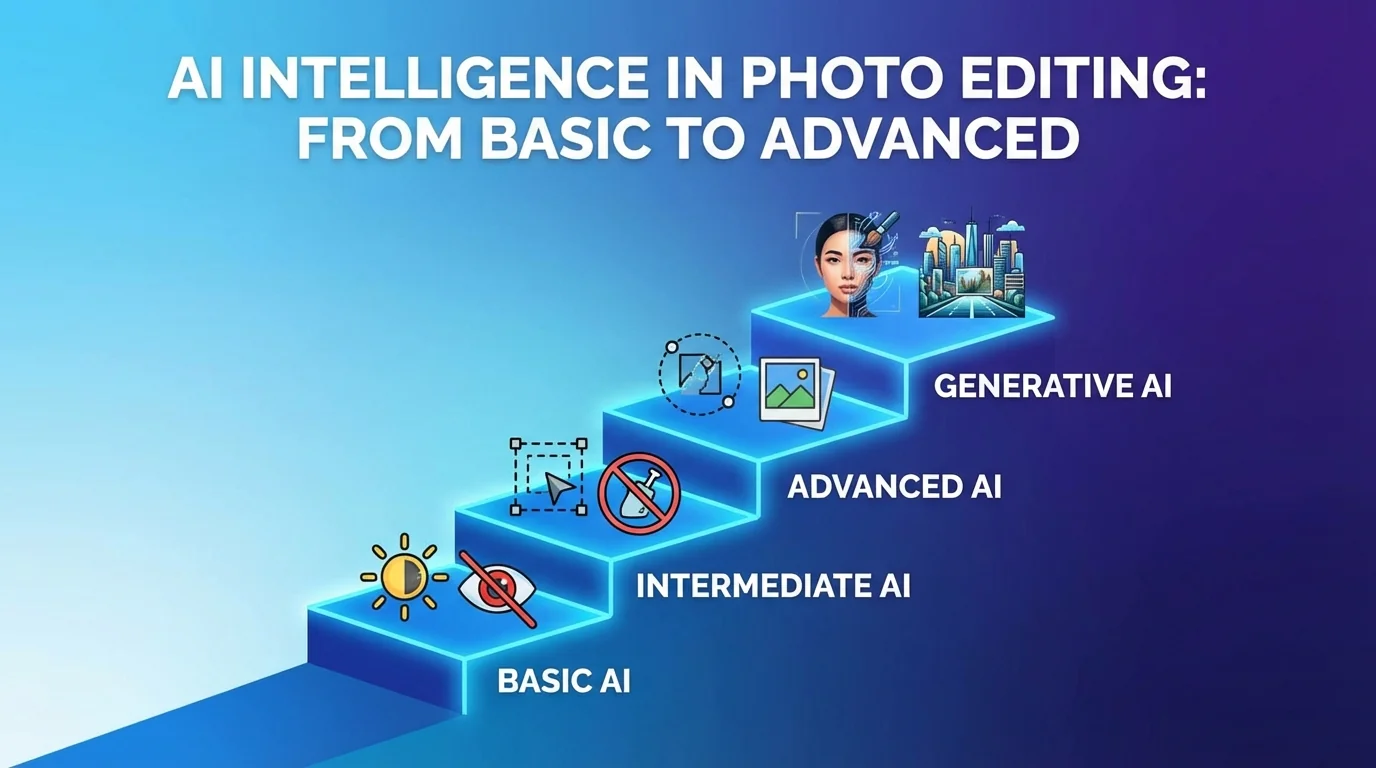

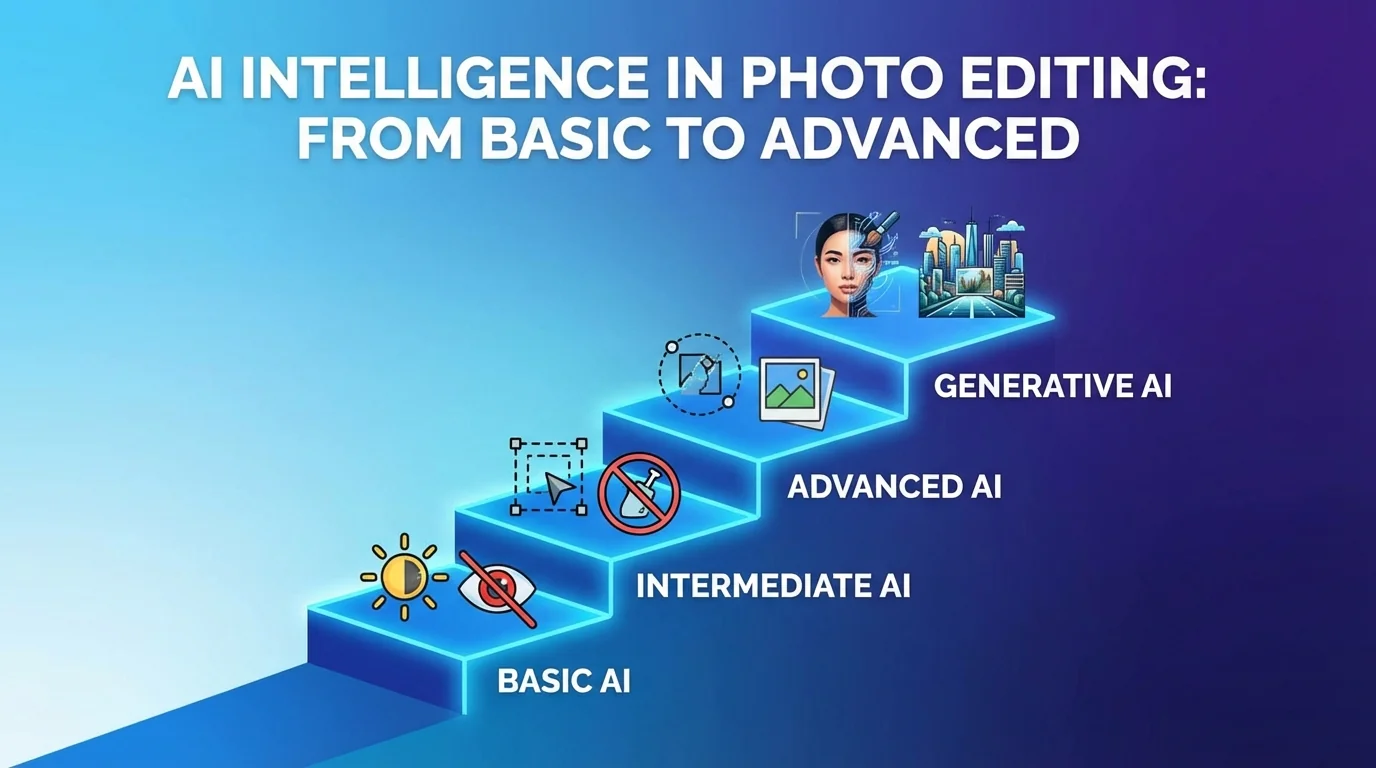

从低到高可以分为:自动滤镜、规则式智能、AI辅助、AI原生四个等级,绝大部分用户接触到的还停留在前两级。

我自己琢磨了一个分级方法,不一定权威但挺实用:

第一级:自动滤镜。就是Instagram那种一键套滤镜。说白了就是对整张图做统一的色彩/对比度/饱和度调整。跟"智能"完全不沾边,但很多人觉得"自动帮我变好看了"就等于"智能"。

第二级:规则式智能。手机自带的美颜就在这一级。能检测人脸,按预设规则磨皮瘦脸。比第一级强在"知道脸在哪",但处理方式是死板的——不管你脸多大它都用同一个比例来瘦,不管你皮肤什么状态都同一个力度磨。

第三级:AI辅助。这一级开始用真正的深度学习了。典型的比如Photoshop的Neural Filters——它能识别人脸的年龄、表情、光照方向,然后做针对性的处理。你可以让一个人"变年轻"、"变开心",这些是传统算法做不到的。但它还是需要人来选择要做什么。

第四级:AI原生。最高级。你给AI一张图,它能自己判断哪里需要修、怎么修、修到什么程度。不需要你做任何选择,出来的效果就像有一个经验丰富的修图师帮你处理过一样。目前能做到这个水平的工具还不多,FlowPix编辑部测过的也只有两三款勉强够格。

为什么分清楚很重要

分不清"智能修图"和"AI修图"的区别,你可能会花冤枉钱买个美颜相机级别的工具,还以为自己在用前沿科技。

举个真实案例。我一个做电商的朋友去年花了三千块买了一款号称"AI智能修图"的软件。结果买回来一用,就是个批量加滤镜+自动裁剪的工具。自动去背景功能确实有,但抠图质量还不如免费的Remove.bg。

他跟客服投诉,客服说"我们这就是智能修图啊,自动处理就是智能"。从法律上讲人家没骗你——"智能"这个词又没有明确的技术标准。但从体验上讲,这跟你花了高铁票价坐了个绿皮火车的感觉差不多。

所以在选修图工具之前,先看几个指标:底层用的是什么模型(有没有提到具体的神经网络架构)?处理结果是千篇一律还是因图而异?能不能做"理解性"操作(比如根据语义去除背景里的特定物体)?如果这些都答不上来,那大概率就是套了个"智能"皮的传统工具。详细的选工具方法可以参考这篇按需选软件的指南。

现在的AI修图到底"智能"到什么程度了

2026年的AI修图已经能做到语义级别的理解——它不只是处理像素,而是"看懂"了照片里有什么。

举几个例子你就明白了:

语义分割。AI能分辨出照片里哪些是人、哪些是树、哪些是天空、哪些是建筑。然后对不同区域做不同处理——人的皮肤做美颜,天空做增蓝,建筑做锐化——全自动,不需要你手动建蒙版。

意图理解。你跟AI说"把这张照片变得更有电影感",它能理解"电影感"意味着什么:压暗高光、提升暗部、加一点青色色调、16:9裁剪。这不是关键词匹配,是语义理解。

上下文补全。你把照片里的一个人擦掉,AI能根据周围环境"猜"出被擦掉位置应该长什么样,然后补上去。这个能力在三四年前还只能在论文里看到,现在已经变成了普通消费者都能用的功能。

但它也有明显的局限。处理复杂的光影关系时经常"理解错误",对中国人面部特征的优化也不如对欧美面孔的好(训练数据偏差的问题),生成细节时偶尔会出现六根手指这种离谱错误。

普通用户怎么判断自己用的是哪一级

最简单的方法:拿两张差异很大的照片让工具处理,如果出来的效果几乎一样,那就是低级"智能";如果效果明显不同且都很合理,那才是真AI。

我个人觉得这个测试方法特别好用。比如你拿一张逆光照和一张顶光照同时处理——低级智能修图会对两张都做一样的"提亮+磨皮",结果逆光那张可能变好了,顶光那张反而过曝了。真正的AI工具会根据两张照片的不同情况做不同处理,两张都变好。

另一个判断方法:看它能不能做"局部智能处理"。如果一个工具只能对整张图做统一调整,那大概率是第一二级。如果它能自己判断出"脸需要磨皮但衣服的纹理要保留"、"天空要提亮但人脸的曝光刚好"——这才是AI在工作。

说了这么多,核心一句话:别被"智能"两个字唬住了。真正的AI修图确实能做很多惊艳的事,但前提是你得学会分辨真假。

如果你身边也有人搞不清AI修图和智能修图的区别,把这篇分享给他们——少交一笔智商税,就是赚了。