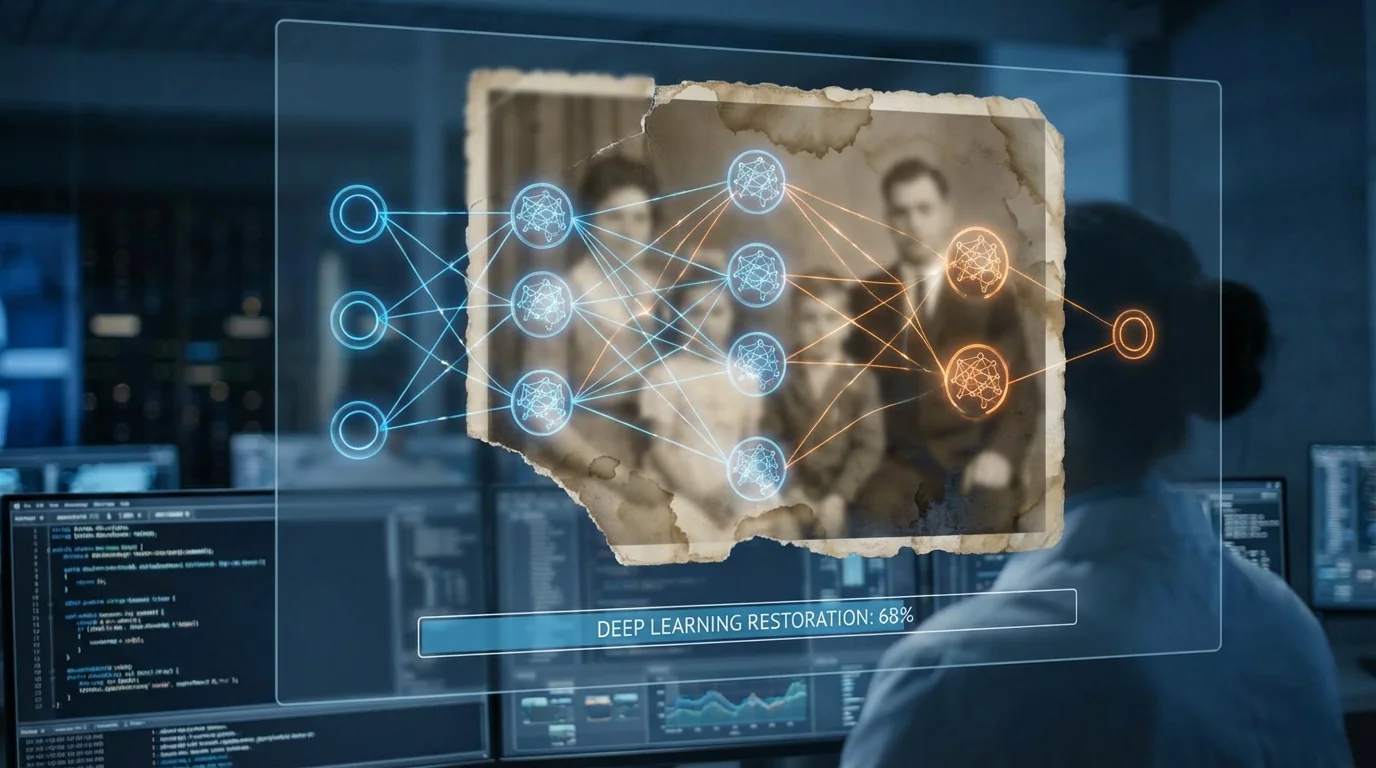

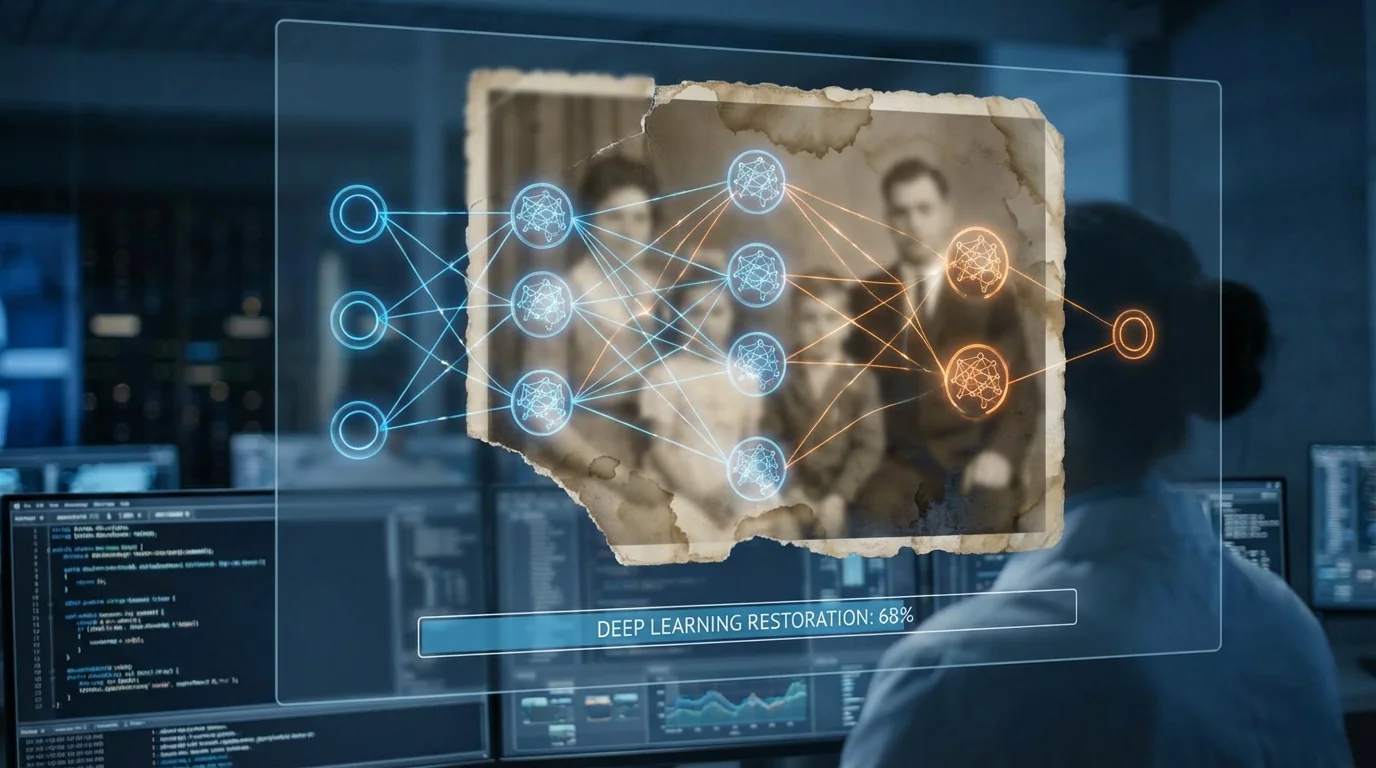

深度学习修图还原技术:AI是怎么把废片救回来的

简单说:深度学习修图还原靠的是"学习-补全"——模型从海量清晰图里学了什么是正常纹理、人脸、场景,遇到模糊破损的图就根据周围信息"猜"出该长什么样。超分、去噪、修复是三大应用。

一张糊成一片的照片,AI能救回来——这事儿听起来像魔法。

背后其实是深度学习。FlowPix编辑部把原理捋了捋,用人话讲清楚。

深度学习怎么"救"废片

模型训练时看了几百万张清晰图,学会了"正常"的纹理、边缘、人脸结构。遇到模糊的图,它根据学到的知识"补全"缺失的细节。不是真恢复,是智能猜测。

关键点:AI不是把"丢失的信息"找回来,而是根据上下文"猜"出合理的细节。所以有时候会猜错——比如把皱纹修没了、把背景里的东西"脑补"成别的。但大部分情况下猜得挺准。

这就是为什么老照片修复、模糊变清晰能work。模型见过足够多的清晰人脸,知道眼睛该长什么样、皮肤纹理大概啥样,就能补。

三大技术方向

超分辨率(糊变清)、去噪(噪点变干净)、修复(破损补全)。三者用的网络结构不同,但思路类似:输入坏图,输出好图。

超分:Real-ESRGAN、ESPCN这类,把低分辨率图放大并增强细节。去噪:学了干净图和噪点图的对齐数据,输入噪点图输出干净图。修复:学了完整图,遇到缺失区域根据周围补,类似inpainting。

Real-ESRGAN是开源的,GitHub上能下。效果不错,很多人用。商业软件像Topaz、Remini,底层也是类似思路,只是模型更大、优化更好。

能救到什么程度

轻度模糊、轻度噪点、小范围破损——效果很好。严重糊、严重损——能改善但救不完美。AI不是万能的。

| 问题类型 | AI能救程度 | 说明 |

|---|---|---|

| 轻度模糊 | 很好 | 能恢复不少细节 |

| 严重模糊 | 有限 | 会脑补,可能不准 |

| 高ISO噪点 | 很好 | 去噪成熟 |

| 破损、划痕 | 中等 | 小范围可补 |

根据IEEE 2025年图像恢复领域综述,深度学习方法的PSNR(客观指标)比传统方法平均高3-5dB。主观上,用户更偏好AI修复的结果。但极端情况仍有局限。

想了解神经网络具体怎么修图,看神经网络如何修图。FlowPix编辑部结论:深度学习修图还原已经挺成熟了,日常"救废片"够用。别指望它把彻底糊掉的图救成高清,那不现实。