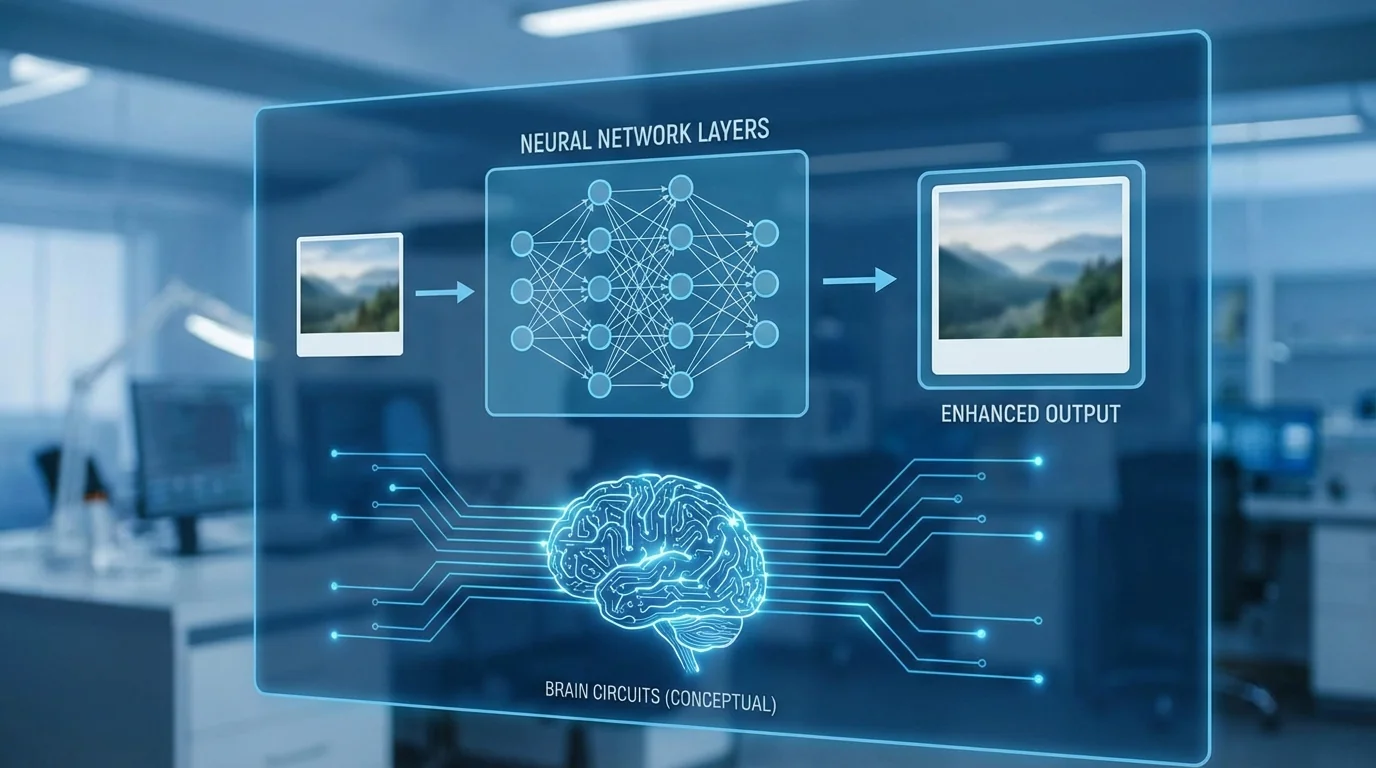

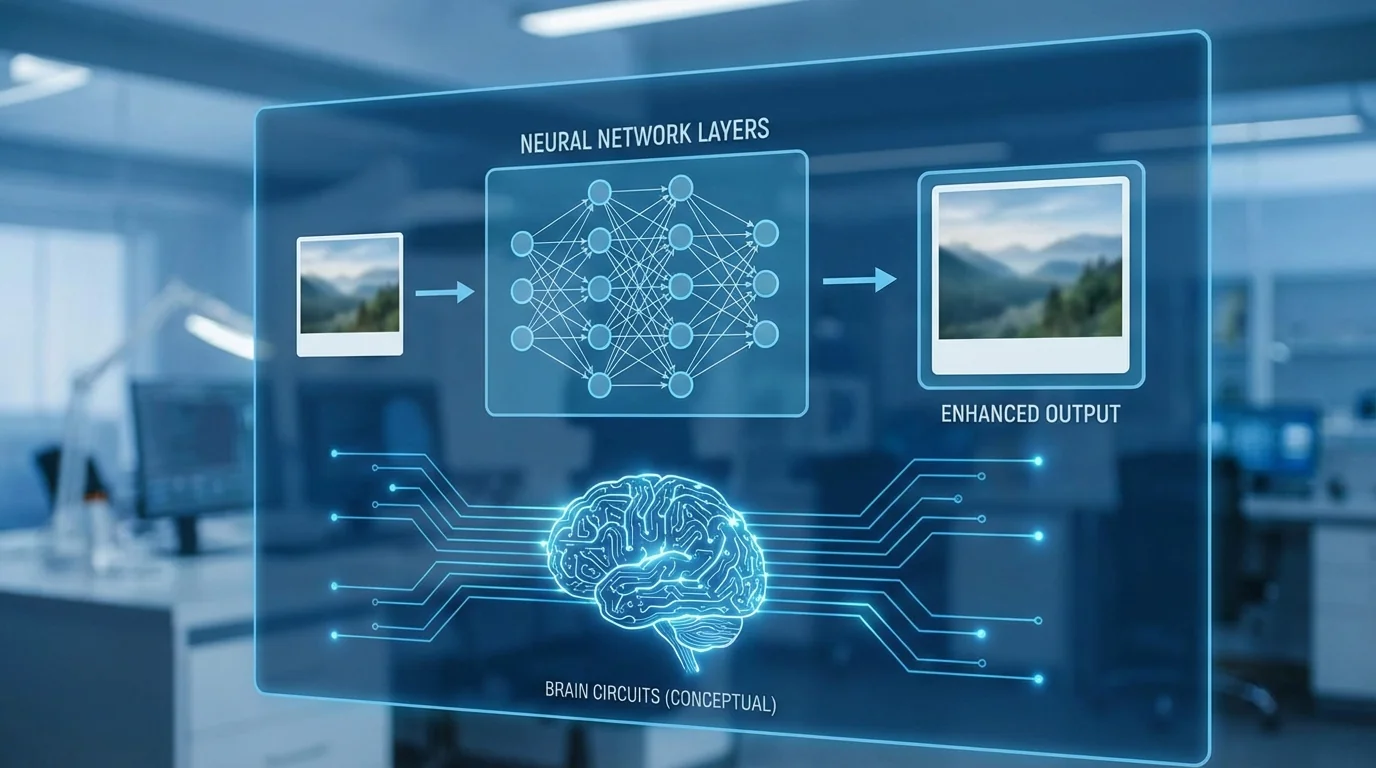

神经网络如何修图?AI修图背后的技术揭秘

简单说:AI修图背后主要是CNN(卷积神经网络)、GAN(生成对抗网络)、扩散模型。CNN做识别和分割,GAN和扩散模型做"生成"——补全、增强、风格迁移。不同任务用不同架构。

AI修图点一下就有结果,背后是一堆数学和代码。

不搞技术的人也能懂个大概。FlowPix编辑部用人话讲一下神经网络怎么修图的。

CNN——识别和分割

CNN(卷积神经网络)擅长"看"——识别人脸、天空、物体边界。修图里的抠图、选择主体、人脸检测,都是CNN干的。

你点"选择主体",软件秒把人物抠出来。背后是CNN扫了一遍图,识别出"这是人",然后输出 mask。U-Net、DeepLab 这类架构就是干这个的。

人脸检测、关键点定位也是。瘦脸、大眼要先知道眼睛在哪、脸型轮廓在哪,CNN把这些标出来,后面的变形算法才能动。

GAN——生成和对抗

GAN(生成对抗网络)有"生成器"和"判别器"打架。生成器负责造图,判别器负责挑刺。打多了,生成器越造越真。超分、去噪、风格迁移很多用GAN。

老照片修复、模糊变清晰,生成器要"造"出细节。判别器看"这图真不真",假的就打回去重造。对抗训练让输出越来越自然。

Pix2Pix、CycleGAN 这些是经典架构。很多商业修图软件的底层用了类似思路。

扩散模型——新晋主力

扩散模型(Diffusion)是近几年火的。从噪声一步步"去噪"成清晰图,能做生成、编辑、inpainting。Stable Diffusion、DALL-E 都用它。

Photoshop 的生成式填充、很多 AI 修图的"智能补全",背后是扩散模型。它比 GAN 更稳定,生成质量高。缺点是慢,要迭代多步。

Stability AI 的 Stable Diffusion 开源了,很多人基于它做修图工具。商业软件也在跟进。

不同任务用什么

抠图、分割用CNN,超分去噪用GAN或扩散,风格迁移用GAN,智能补全用扩散。没有一种架构通吃,各干各的。

| 任务 | 常用架构 | 代表 |

|---|---|---|

| 抠图、选择主体 | CNN (U-Net等) | DeepLab, MODNet |

| 超分、去噪 | GAN / 扩散 | Real-ESRGAN, Topaz |

| 风格迁移 | GAN | CycleGAN |

| 智能补全、inpainting | 扩散 | Stable Diffusion |

根据 Papers With Code 2025 年统计,图像编辑相关论文中扩散模型占比已超 40%,超过 GAN。技术迭代很快。

想了解深度学习怎么救废片,看深度学习修图还原技术。FlowPix编辑部结论:神经网络修图不是黑魔法,是数学+数据+算力。理解个大概,用起来心里有数。