AI修图和AI生图到底有啥区别?别再搞混了 - FlowPix

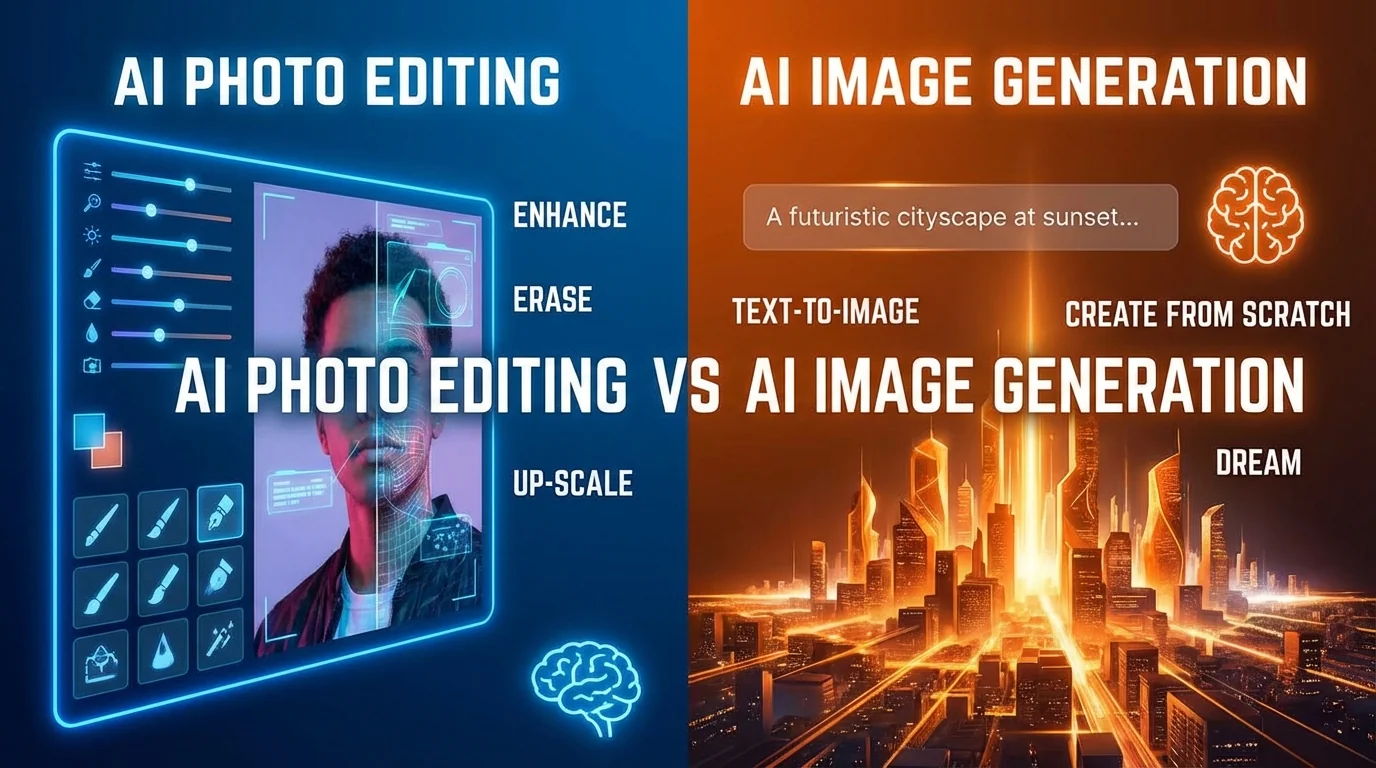

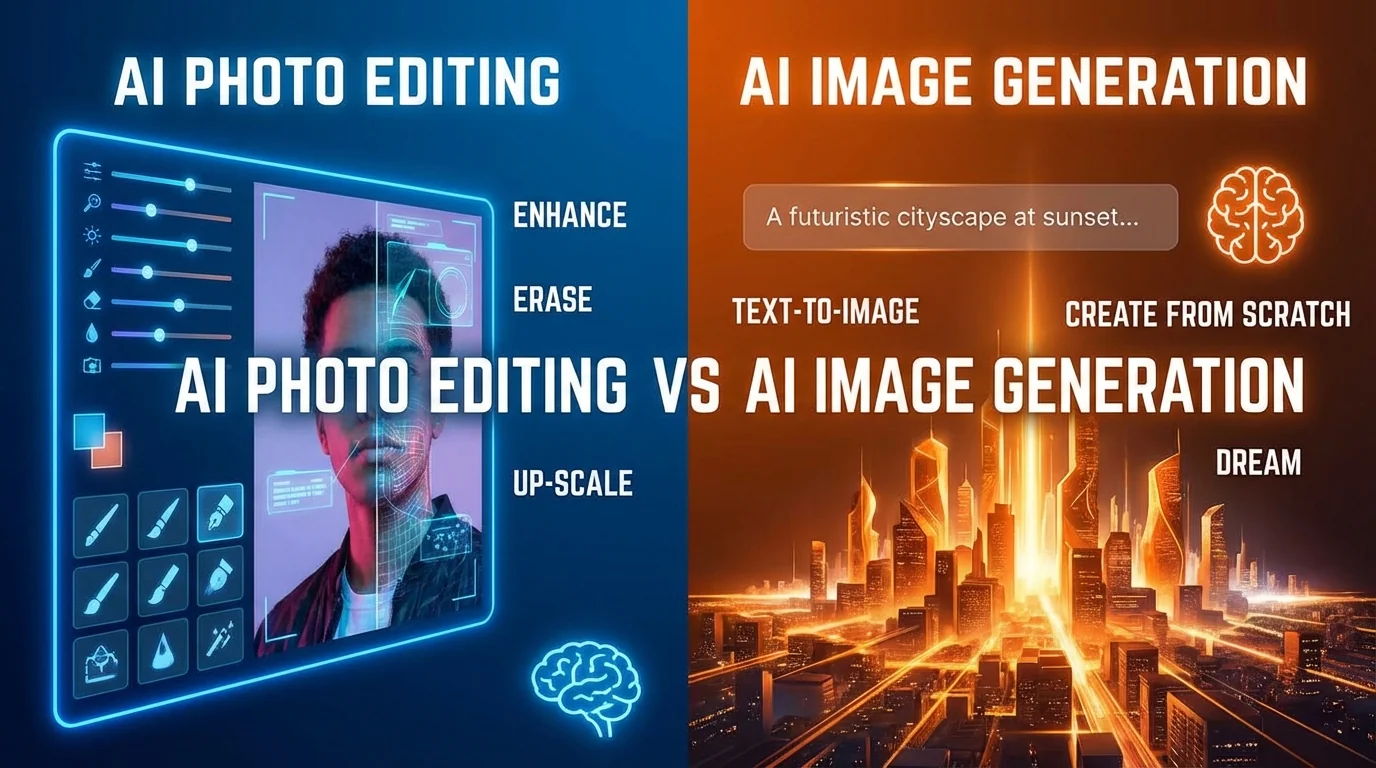

简单说:AI修图是拿一张已有的照片去改(调色、去杂物、美颜),AI生图是从零凭空画一张新图(输入文字描述就出图)。两者用的技术不同、产出不同、适用场景也完全不同。

AI修图和AI生图到底有啥区别?别再搞混了

我发现很多人把ai修图生图这两个概念混在一起说。上个月有个做电商的客户跟我说"帮我用AI生一张产品图",我以为他要凭空生成,结果他掏出一张拍好的产品照——他要的是修图。还有一次,一个设计师朋友说"AI修图太厉害了能凭空创造画面",其实他说的是Midjourney生图。

搞混了无所谓,但选错工具就浪费时间了。你拿Midjourney去做证件照美颜,那不是白折腾吗?你拿美图秀秀想"生成"一张全新的产品图,那也做不到。

这篇把两者的区别掰开了讲清楚。不讲那些玄乎的技术名词,就用人话说。

最本质的区别:改图 vs 造图

AI修图的输入是一张已有照片,输出还是这张照片(只是变好看了)。AI生图的输入是一段文字描述,输出是一张全新的、世界上从未存在过的图片。

打个比方。AI修图就像是装修——你有一套毛坯房(原图),找装修公司(AI)来刷墙、铺地板、装灯(调色、去瑕疵、美颜)。装修完了还是你这套房子,只是好看了。

AI生图就像是盖房子。你跟建筑师(AI)说"我要一栋三层带花园的别墅",他从零开始画图纸、打地基、盖起来。出来的房子是全新的,不基于任何已有的房子。

听起来简单?但实际应用中很多人就是分不清。比如"把这张照片里的背景换成海滩"——这算修图还是生图?答案是:都算。AI修图工具可以做(保留人物,替换背景),AI生图工具也可以做(以原图为参考重新生成整张图)。结果可能长得差不多,但过程和细节差别很大。

技术原理有什么不同

AI修图主要用的是图像分割、超分辨率、风格迁移等传统视觉AI技术;AI生图用的是扩散模型(Diffusion Model),从随机噪点中"去噪"出一张完整的图。

AI修图的技术相对成熟。去背景用的是语义分割——AI把图片里的每个像素分类为"人""天空""草地",然后精确操作。美颜用的是人脸关键点检测加图像处理。画质增强用的是超分辨率网络。这些技术都有十多年的研究积累了,稳定靠谱。

AI生图就不一样了。Stable Diffusion、Midjourney、DALL-E这些工具用的都是扩散模型。简单说就是:先给一张图加很多噪点直到变成纯噪声,然后训练一个神经网络学会"去噪"的过程。生图的时候,从一堆随机噪点开始,按照你输入的文字提示一步步去噪,最后得到一张清晰的图。

根据arXiv上发表的研究论文统计,2024-2025年间关于图像生成的学术论文数量同比增长了超过200%,这个领域还在爆炸式发展。修图技术虽然也在进步,但增速远没有生图这么疯狂。

技术差异带来一个关键区别:AI修图的结果是确定的——同一张图用同样的参数修,出来的效果一样。AI生图的结果是随机的——同一段文字描述,每次生成都不一样。这对实际使用的影响很大。

各自擅长的场景

AI修图擅长处理已有照片的优化和修正(证件照美颜、产品图去背景、风景照调色);AI生图擅长创造全新视觉内容(插画、概念图、虚拟场景)。

用一张表格看得更清楚:

| 场景 | AI修图 | AI生图 | 我的建议 |

|---|---|---|---|

| 证件照美颜 | 直接修原照片,效果精准 | 会"画"出一个新的人脸,不是本人了 | 必须用修图 |

| 电商产品图去背景 | 精确保留产品细节 | 可能改变产品外观 | 用修图 |

| 社交媒体配图 | 优化现有照片 | 从零创造吸引眼球的图 | 看你有没有原图 |

| 文章插画 | 能做,但需要有原素材 | 输入描述直接生成,超方便 | 生图更合适 |

| 品牌视觉设计 | 优化已有设计稿 | 快速产出创意概念图 | 生图做初稿,修图做终稿 |

| 老照片修复 | 修复划痕、上色、提高清晰度 | 可能"重新画"一张,失去原味 | 修图 |

你看出规律了吗?凡是要保持"真实性"的场景——产品要像产品、人脸要像本人——就该用修图。凡是不在乎"像不像"只要好看的场景——插画、概念图、装饰性配图——生图更高效。

两者能不能配合使用

当然能,而且"先生图再修图"已经成了很多设计师的标准工作流——AI生成初稿解决"从0到1",AI修图打磨细节解决"从1到100"。

我自己就经常这么干。比如需要一张博客封面图,我会先用Midjourney生成一个大概的画面。但AI生成的图总有这样那样的小问题——手指多了一根、文字变成乱码、局部细节模糊。这时候就把生成的图导入修图工具,用AI去杂物、锐化细节、调调色。

FlowPix编辑部做文章配图基本都是这个流程。生图出草稿,修图出成品。效率比纯手画快十倍不止。

反过来也行。你有一张照片,觉得构图还行但风格不喜欢,可以用AI生图工具做"风格迁移"——把照片变成油画风、水彩风、赛博朋克风。严格来说这既不是纯修图也不是纯生图,而是以原图为基础的"重新诠释"。具体操作方法可以看AI生成的图如何修,里面有实际案例。

有个真实故事值得分享——去年有个做独立游戏的小团队,美术就一个人。他用Stable Diffusion生成游戏场景的初稿(生图),然后在Photoshop里用AI辅助修细节(修图),最后用Spine做成动画。整个游戏的美术资源80%是这么做出来的。一个人干出了以前三五个人的活。

各自的局限性

AI修图的天花板是"原图质量"——垃圾进垃圾出,拍得太差AI也救不回来。AI生图的天花板是"可控性"——你很难精确控制画面的每一个细节。

先说修图的局限。一张严重过曝的照片(天空全白),AI能恢复一些细节但不可能凭空变出云彩。一张模糊到人脸都看不清的照片,AI超分能让它"看起来"清晰一点,但本质上是AI猜出来的细节,不是真的。所以拍照的时候还是得上心,别指望AI什么都能救。

AI生图的问题更多一些。最著名的就是"手指问题"——AI画人物经常多指、少指、指头弯曲角度不对。虽然2025-2026年的新模型已经好了很多,但还是时不时翻车。

另一个大问题是文字。你让AI在图里写"Hello World",它大概率给你生成一堆看起来像字但读不出来的乱码。这是扩散模型的架构限制,短期内很难彻底解决。

还有版权和伦理的问题。AI修图改的是你自己拍的照片,版权清晰。AI生图呢?训练数据里包含了大量网络图片,生成的图是否侵权,至今没有明确的法律定论。商用的时候得留个心眼。

工具怎么选

需要修图就用Lightroom、Photoshop、美图秀秀这类工具;需要生图就用Midjourney、DALL-E、Stable Diffusion;两者都需要就选有生图+修图一体的(比如Photoshop+Firefly组合)。

如果你只是日常修修照片——调个色、去个痘印、换个背景——纯修图工具就够了,不用碰生图。手机上醒图、美图秀秀、Snapseed都很好。电脑上Lightroom和Photoshop是标杆。关于各种修图工具的详细测评可以看AI修图哪个好用实测。

如果你需要创造性的视觉内容——做自媒体配图、写小红书需要好看的插画——试试Midjourney或者DALL-E。Midjourney画质最高但要在Discord里操作(我到现在还是觉得这个交互方式很反人类),DALL-E在ChatGPT里直接用最方便。

如果两者都需要,老实讲Adobe那套东西(Photoshop + Firefly + Lightroom)是目前最完整的。虽然贵了点(每月68块),但修图和生图都能在里面搞定。当然,如果你想先了解AI修图的几种模式,可以先看看那篇文章再决定。

最后说句大实话:大多数人日常需要的是修图而不是生图。别被AI生图的酷炫效果迷了眼——能把手里的照片修好看,比凭空画一张新图实用得多。

这篇关于AI修图和生图区别的文章如果理清了你的疑惑,欢迎分享给同样搞不清状况的朋友,帮他们少走弯路。