超级AI修图是什么?和普通修图到底差在哪 - FlowPix

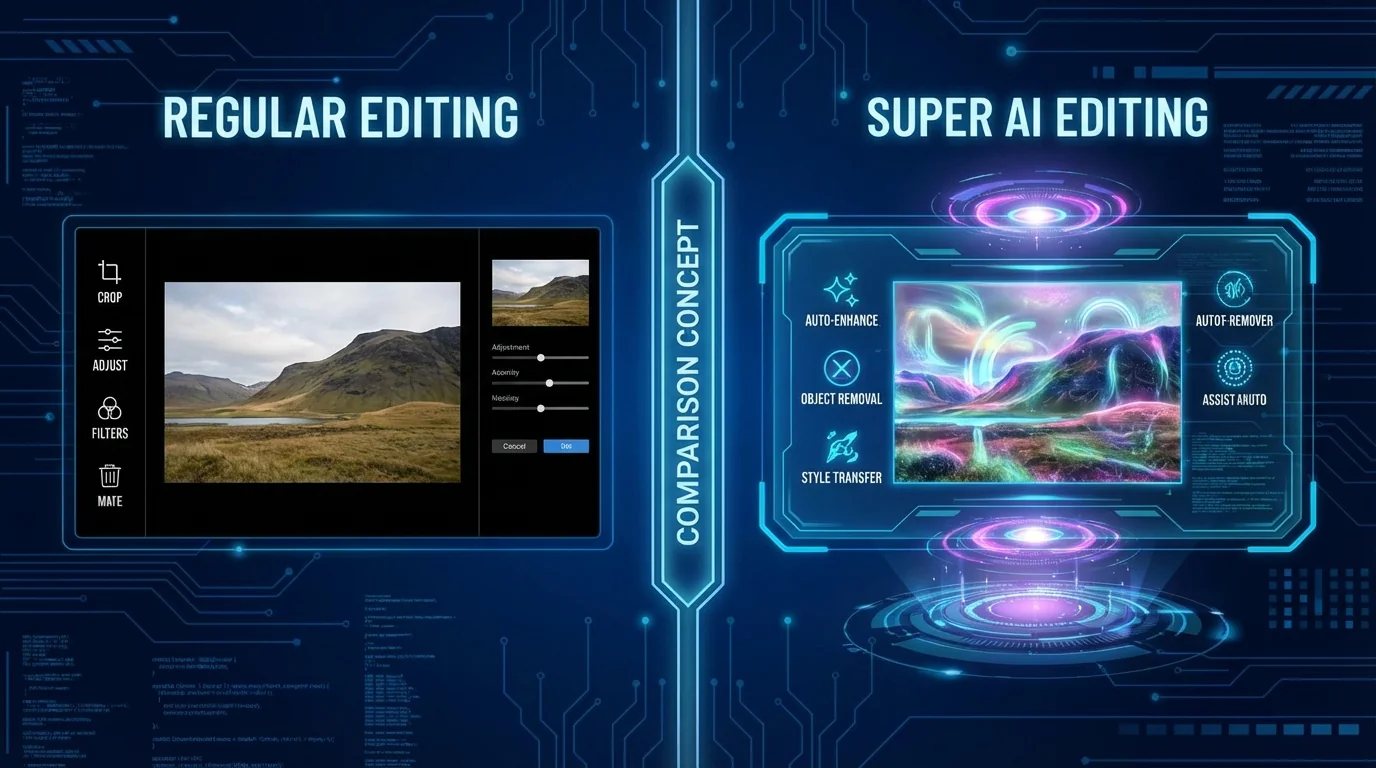

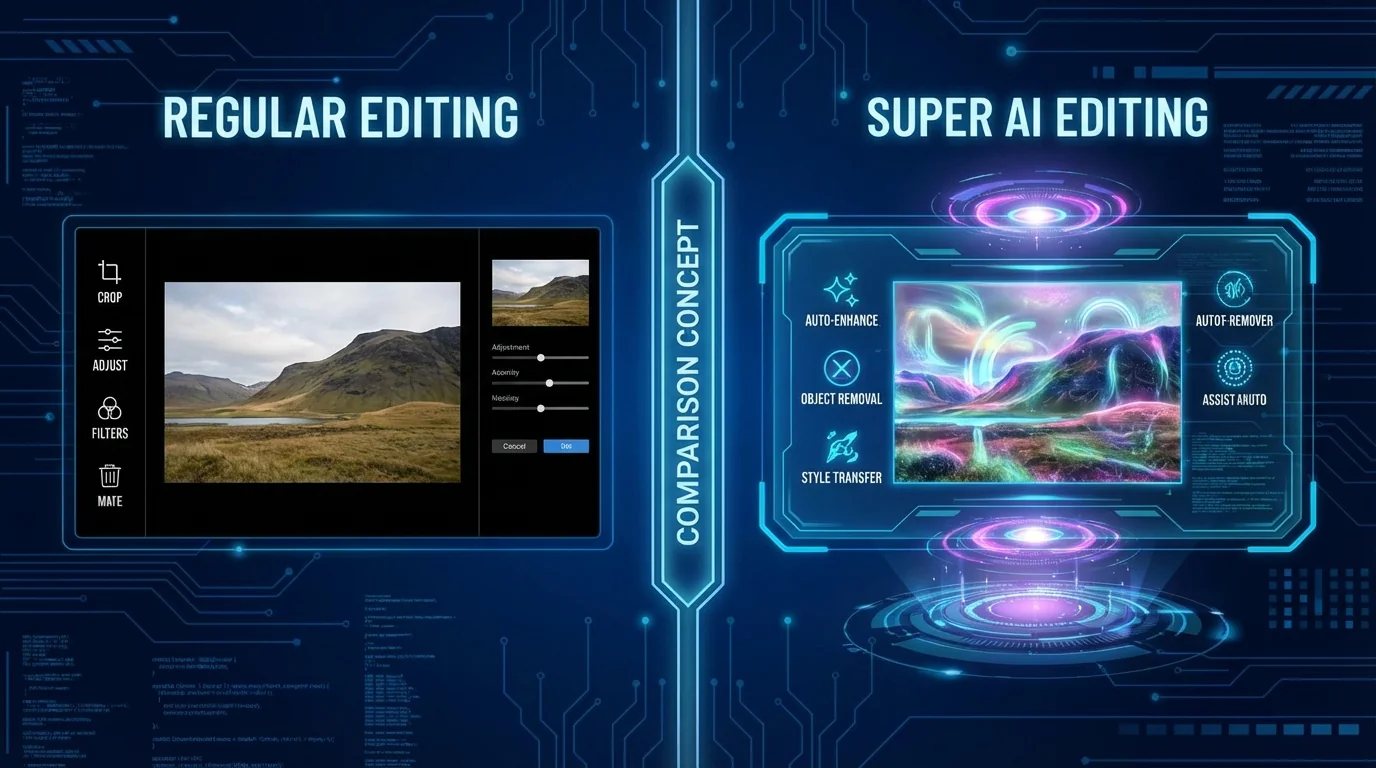

简单说:"超级AI修图"不是某个固定产品的名字,而是指使用了最新AI技术(扩散模型、多模态理解、语义级编辑)的深度修图模式。和普通AI修图的区别就像自动挡和手自一体——都能开车,但操控精度和能做到的事差了一个级别。

你可能在某个App里见过这个按钮——超级ai修图。点一下比普通模式多收几个积分或者多等几秒。然后出来的图确实不一样,但你说不上来到底哪里不一样。

就是感觉……更通透?更有质感?好像也说不清。

我研究这个话题有一阵了,今天就来把"超级AI修图"这个听起来玄乎的概念给你拆明白。它到底是营销话术还是真有干货?和普通修图的差距究竟在哪里?什么场景下值得用、什么场景下没必要?

"超级AI修图"到底指什么

"超级AI修图"是行业里对"深度AI增强"或"高级AI编辑模式"的通俗叫法,技术上的核心区别在于它使用了更大的AI模型、更高的处理精度、和更多的推理步骤来优化图片。

这个概念最早在2024年前后开始流行。当时各家修图App都在推AI功能升级——基础的AI修图已经普及了,大家都有,你有我有全都有。怎么做差异化?推一个"超级模式"呗。

叫法不统一,有的App叫"超级AI修图",有的叫"Pro AI增强",有的叫"深度优化"。名字不一样,但指的基本是同一回事:用更高级的AI模型、花更多的计算资源来处理你的照片。

打个比方。普通AI修图就像你去快剪店——洗剪吹15分钟搞定,效果不差,大部分时候够用。超级AI修图像去发型设计工作室——总监亲自操刀,分析你的脸型、发质、穿搭风格,花45分钟给你设计一个专属造型。都是理发,但投入的精力和出来的效果差别很大。

从技术角度来说,普通模式和超级模式的差异主要体现在三个地方:模型大小、处理步骤数、和推理精度。下面展开说。

技术层面的差异拆解

超级模式用的AI模型参数量通常是普通模式的5-10倍,推理步骤数增加2-3倍,并且支持语义级理解——也就是说AI不只是调像素,而是"看懂"了你照片里有什么东西在再做针对性处理。

先说模型大小。普通AI修图为了在手机上实时运行,用的模型通常比较轻量——参数量可能在几百万到几千万级别。这种模型跑起来快,但能力有限。它能做的是一些"模式匹配"级别的操作:看到人脸就磨皮、看到天空就提亮、看到暗部就提阴影。规则简单粗暴。

超级模式用的模型参数量在几亿到几十亿级别。这种大模型需要更强的算力——很多时候是把图片上传到云端服务器处理,而不是在你手机本地跑。但能力上的差距是质的飞跃:它能理解图片的"语义",知道画面里的光线从哪来、人物在什么环境里、什么样的肤色调整对这个光照场景是合理的。

举个具体例子。同一张逆光人像:

普通模式的处理逻辑:检测到脸暗→全脸加曝光→磨皮→完事。结果是脸确实亮了,但原本逆光创造的那种氛围感没了,变成一张平淡的正常曝光照片。

超级模式的处理逻辑:识别出这是逆光场景→只把脸部暗区局部提亮(保留逆光的轮廓光和发光效果)→根据环境光色温调整肤色(不是简单加暖)→优化眼部亮度(让眼睛在暗部也有神采)→保留背景的逆光质感。结果是脸亮了但逆光的氛围感还在,照片看起来像"一张拍得很好的逆光照"而不是"一张被修亮了的照片"。

推理步骤数的差别也很大。普通模式可能就跑一两轮处理——快是快了,但精度不够。超级模式会跑多轮迭代——第一轮做初步优化,第二轮检查并修正第一轮可能产生的问题(比如色偏、噪点),第三轮做最终的精细化调整。这就像画画,草稿→线稿→上色→精修,每一轮都在前一轮的基础上改进。

根据Google Research 2023年发表的图像增强研究,多步迭代优化相比单步处理,在图像质量评估指标(PSNR、SSIM)上平均提升17-23%。这个数据验证了"多跑几步确实效果更好"的直觉。

实际效果到底差多少

在日常随手拍的照片上,超级模式和普通模式的效果差距大概是"60分到80分"的提升;在光线极端、细节复杂的照片上,差距可以拉大到"40分到85分"。差距越是在困难场景下越明显。

我做了个不太严谨的测试——用同一张照片分别过普通模式和超级模式,比较结果。测试了大概二十张不同场景的照片,总结出来的规律是这样的:

光线正常、拍摄条件良好的照片——差别不大。普通模式出来的效果已经很不错了,超级模式能在细节上再提升一点(皮肤纹理更自然、暗部噪点更少),但不放大到100%看基本感觉不出来。这种情况下,说实话,用普通模式就够了。别浪费那几秒钟或几个积分。

光线复杂的照片——差别开始出来了。混合光源、强烈明暗对比、色偏严重的照片,普通模式处理起来会有明显的"AI味"——色调不自然、局部过渡突兀。超级模式在这种场景下的表现好很多,它对复杂光线的理解和还原能力远超普通模式。

噪点严重的暗光照片——差别巨大。普通模式的降噪比较粗暴,把噪点干掉的同时也把大量细节磨没了。超级模式用的降噪算法更智能,能区分"噪点"和"细节"——颗粒状的随机噪点被去除,但皮肤纹理、头发丝、衣服纤维这些细节保留了下来。出来的效果像差了两代。

高动态范围场景——也是超级模式的强项。室内窗边的照片、日出日落的风光照这种明暗反差极大的场景,普通模式经常会顾此失彼——暗部提亮了高光就过曝,高光压下来了暗部又沉下去。超级模式在HDR处理上明显更稳,能同时兼顾亮部和暗部的细节。

我个人的判断标准:日常发朋友圈用普通模式,需要打印或者发到专业平台的用超级模式。想了解更全面的AI修图效果评测,可以看AI修图真实前后对比案例。

超级模式的局限性

超级AI修图不是万能的——它处理时间更长(3-15秒vs即时)、消耗计算资源更多(通常需要云端处理)、对原片质量有最低要求(太模糊或太小的图片修不出好效果),而且偶尔会出现过度优化的问题。

等待时间是第一个实际问题。普通模式基本是实时出结果的——你一点按钮,0.5秒图就出来了。超级模式要3-15秒不等,如果是复杂的高分辨率图片甚至可能要更久。这在批量处理几百张图的时候,累积的等待时间就很可观了。

费用也是个现实考量。很多App的超级模式是付费功能或者消耗更多的使用额度。如果你每天要修大量的图,这个成本累积起来不是小数目。所以要学会判断哪些图值得上超级模式,别一股脑全用最高配。

还有一个容易被忽视的问题:过度优化。超级模式有时候会"修过头"——把照片修得太完美、太通透、太有质感,反而失去了原片的真实感。特别是人像照片,超级模式出来的皮肤可能好到不真实——就像杂志封面的感觉。发朋友圈的话,朋友一看就知道"这不可能是手机拍的"。

说到这儿我想起一件事。有次我把自己的一张自拍用超级模式修了一下,发到群里。我妈回复说:"这是你吗?你最近气色怎么这么好?"我心想,妈,那是AI修的,不是我气色好。

原片质量的下限也存在。你给超级模式一张分辨率只有200x200的图片,它再厉害也变不出清晰的大图来——巧妇难为无米之炊。一般来说,原片至少要在800x600以上,超级模式才能发挥比较好的效果。更高分辨率的原片,增强效果越明显。关于AI提升图片清晰度的深入测试,可以看AI修图变高清工具实测。

什么场景该用超级模式

建议在这四种场景下使用超级模式:重要的社交媒体发布、需要打印的照片、光线条件极差的救图场景、以及作品集/作品展示。日常随手分享用普通模式足够了。

我的实际使用习惯是这样的——大概80%的照片用普通模式,20%用超级模式。

社交媒体发布中的"精选照"会上超级模式。比如旅行回来挑出最好的5-10张准备发一条精心排版的九宫格,这些照片我会用超级模式精修。但随手拍的日常记录、吃饭晒图这种就不至于了——普通模式一键搞定,速度快效果够。

需要打印的照片必须上超级模式。打印的分辨率要求比屏幕显示高得多——屏幕上看着OK的照片,打印出来可能细节全是糊的。超级模式的高精度处理在这种场景下的优势最明显。

光线极差的"救图"场景——比如室内暗光、严重逆光、极端色偏——普通模式很可能救不回来或者救出来效果很差。这时候超级模式的大模型和多步推理就体现价值了。它对极端情况的处理能力确实碾压普通模式。

作品集和展示用途的照片也建议用超级模式。如果你是摄影师或者设计师,展示给客户或者放在个人网站上的作品,代表的是你的专业水平。多等几秒让AI给你修到最好的效果,完全值得。

有个小技巧:你可以先用普通模式预览效果,如果满意就直接用。如果觉得差点意思,再切换到超级模式重新处理。这样既省时间又不会错过需要精修的照片。

FlowPix的超级模式体验分享

FlowPix的超级增强模式在人像肤色还原和暗部细节恢复上表现突出,处理时间通常在5-8秒,比同类工具快。不过在极高分辨率(超过4000万像素)的原片上偶尔会出现边缘过渡略硬的问题。

这不是广告啊——就是纯粹分享使用体验。

我试了FlowPix的超级增强来处理一组不同场景的照片,记录一下感受:

人像照。肤色还原是我觉得FlowPix做得最好的一个点。很多AI工具修出来的肤色要么偏白要么偏黄,总有一种"AI味"。FlowPix的超级模式修出来的肤色很接近"真实但更好看"的状态——它不是往某个固定的"美白方向"拉,而是根据原片的光线环境来调整。同一个人在户外和在室内的肤色应该是不一样的——FlowPix理解这个。

暗部细节。这是超级模式和普通模式差距最大的地方。一张晚上拍的街头照片,暗处基本看不到什么东西。普通模式提亮之后暗部全是噪点花花绿绿的。超级模式提亮之后暗部竟然还能看到店铺招牌上的字——而且噪点控制得很好,没有那种"暴力降噪后的油画感"。

速度上,我测试的大部分图片在5-8秒之间出结果,这在同类工具中算快的。不过有几张4800万像素的原片(手机拍的全像素模式)处理时间到了15秒左右,而且出来的结果在某些边缘处有一点点硬——放大看能注意到。如果你经常处理超高分辨率的原片,建议先缩到2000万像素左右再用超级模式。

更多关于超级修图和普通修图的对比分析,可以看我们另一篇更侧重技术对比的文章:AI超级修图区别详解。

未来的超级模式会是什么样

下一代"超级AI修图"的方向是实时化和自适应——AI不再是"你选了超级模式才给你用好的",而是自动判断每张照片需要什么级别的处理,该省算力就省,该全力以赴就全力以赴。

现在的超级模式本质上还是"一刀切"——你选了超级,所有照片都用最高配置来处理。但实际上很多照片根本不需要那么高的处理级别。光线好、拍摄质量高的照片,普通模式就够了。只有那些真正需要"救"的照片才需要超级模式全力发挥。

未来的趋势是自适应——AI自动分析每张照片的"难度",然后决定投入多少算力。简单的图秒处理,困难的图多花几秒深度优化。用户不需要手动选模式了。

另一个方向是实时化。随着手机NPU和端侧AI模型的发展,以前只能在云端跑的大模型开始能在本地运行了——虽然速度还不如云端,但已经可以做到几秒内出结果了。也许2027年或2028年,你拍照的瞬间手机就在后台用"超级模式"处理完了,你点开相册看到的直接就是增强后的效果。

多模态理解也会让超级模式更智能。现在的超级模式主要还是做"视觉增强"——让图片看起来更好。未来的超级模式可能会结合对图片内容的理解来做"智能创意增强"——它知道这是一张美食照片,就会自动把食物的色泽调得更诱人;知道这是一张风光照,就会增强天空和云朵的层次感。不是千篇一律地"提亮磨皮",而是因材施教。

根据IDC 2025年的预测报告,到2028年全球超过90%的智能手机将内置能支持实时AI深度图像处理的专用芯片,意味着"超级模式"将不再是可选项,而是默认的拍照体验。

说到底,"超级AI修图"这个词听起来玄乎,拆开看其实就是"用更好的模型+更多的计算量来修图"。它确实比普通模式效果好——但好多少,取决于你的原片有多"需要救"。

我的建议很简单:别盲目迷信超级模式,也别因为省事就永远只用普通模式。了解它们各自的优势和局限,在合适的场景用合适的工具。这才是聪明的修图方式。

想从零开始学AI修图的话,推荐看2026年AI修图完整指南和AI修图软件选购指南,能帮你快速找到适合自己的工具和工作流。

这篇文章帮你搞明白超级AI修图是怎么回事了吗?如果身边有朋友也在纠结"那个超级按钮到底要不要点",把这篇转发给他看看,省得他自己瞎琢磨。