GAN技术在AI修图中的应用:对抗生成网络修图原理 - FlowPix

简单说:GAN(生成对抗网络)是目前AI修图的核心引擎之一,靠两个神经网络互相"较劲"来生成逼真图像。你用的去背景、超分辨率、人脸美化功能,背后大概率都有GAN在干活。

GAN技术在AI修图中的应用:对抗生成网络修图原理

你有没有好奇过,gan ai修图到底是怎么把一张模糊照片变清晰的?或者那些一键换天空、一键去皱纹的功能,凭什么能做到这么自然?

我第一次接触GAN这个概念的时候,是2022年底。那会儿DALL-E 2刚出来没多久,大家都在惊叹AI能画画了。我一个做设计的朋友跟我说:"你知道吗,这玩意的底层就是两个AI打架。"我当时觉得他在瞎说。

后来认真查了一下资料,发现他说的还真没错——GAN的核心逻辑确实就是"打架"。只不过这个"打架"的方式相当精妙。

GAN是什么?用大白话讲清楚

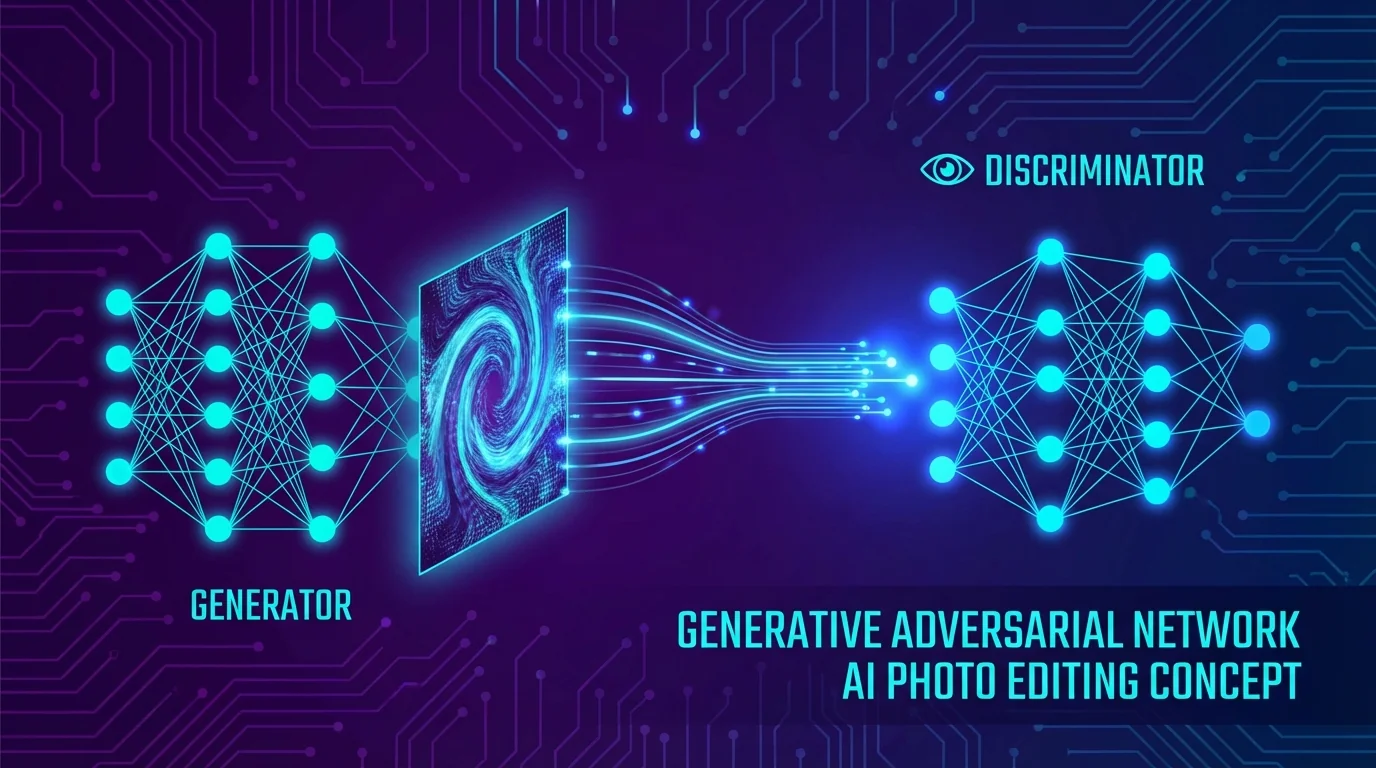

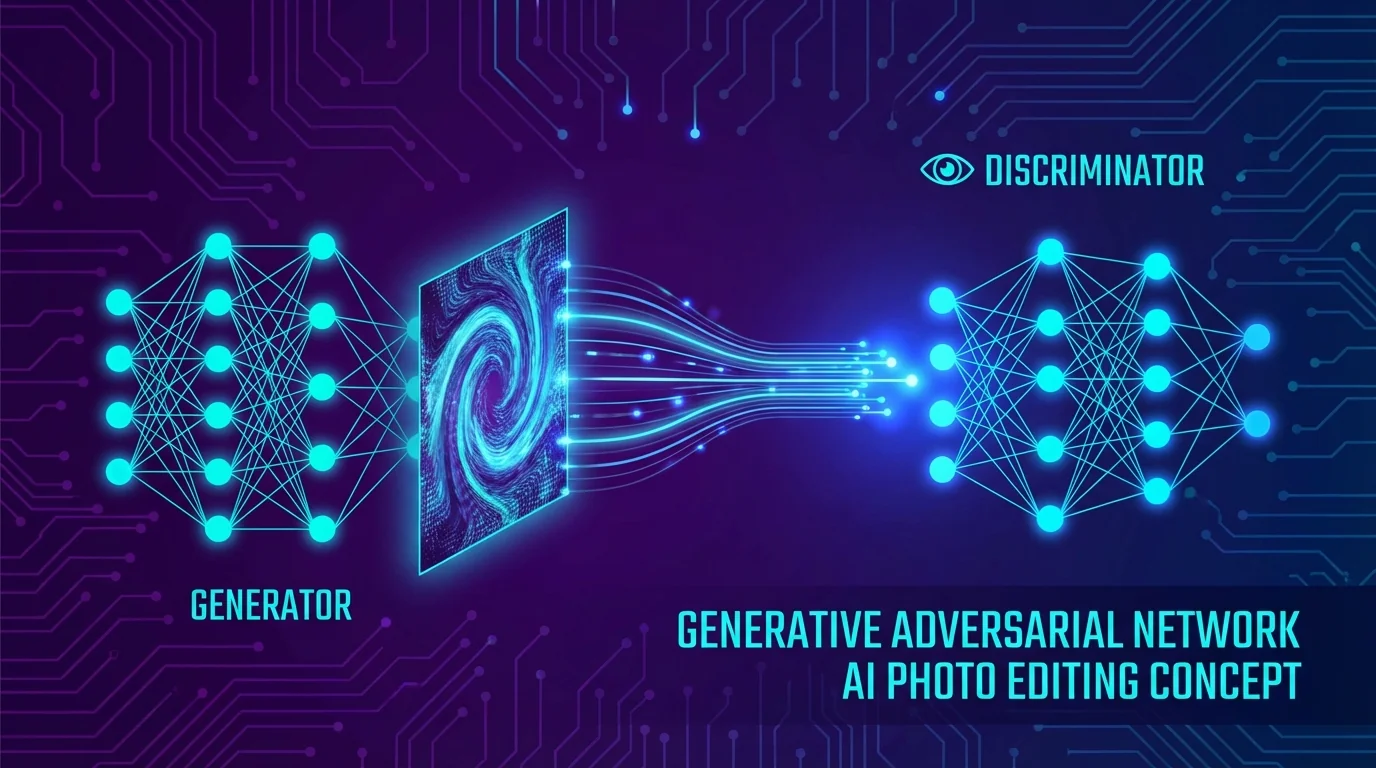

GAN全称Generative Adversarial Network(生成对抗网络),由两个神经网络组成:一个负责造假(生成器),一个负责验假(判别器),两者在对抗中不断进步,最终生成器能造出以假乱真的图像。

打个比方吧。你可以把GAN想象成一个造假画的过程。

生成器就是那个造假画的人。一开始画得很烂,一眼假。判别器是鉴定师,负责判断这画是真迹还是赝品。造假的人每次被鉴定师识破了,就回去研究——到底哪里露馅了?笔触不对?色彩不对?颜料的质感不对?然后改进,再拿过来给鉴定师看。

鉴定师也没闲着。他也在不断提高自己的鉴别能力,因为造假的手艺越来越好了嘛。

两边互相逼对方进步,到最后——造假的水平高到鉴定师也分不出真假了。这就是GAN训练收敛的状态。2014年Ian Goodfellow提出这个框架的时候,学术圈都炸了,因为这个思路实在太妙。

根据Google Scholar的数据,Goodfellow那篇GAN原始论文的引用次数已经超过65000次,是近十年深度学习领域被引用最多的论文之一。这个数字本身就说明了GAN在AI界的地位。

GAN在修图领域的五大杀手级应用

GAN在AI修图中主要应用于超分辨率增强、人脸属性编辑、图像修复(inpainting)、风格迁移和去噪,其中前三个已经高度成熟,覆盖了绝大多数日常修图需求。

我逐个说说,不按什么"重要性排序"——因为哪个重要完全取决于你拿来干嘛。

超分辨率(Super Resolution)

把低分辨率图片放大还能保持清晰度,这事在GAN出现之前基本做不到。传统的放大算法(双线性插值那些)放大后糊成一片,没法看。

SRGAN(2017年提出的)彻底改变了这个局面。它让生成器学习"高清图片应该长什么样",然后在放大低分辨率图片时"脑补"出合理的细节。你看那些老照片修复、视频画质提升的功能?底层就是这套技术的变种。

我试了下用ESRGAN(SRGAN的升级版)处理一张2008年用诺基亚拍的照片——说实话效果惊到我了。虽然不可能真的还原出当年的细节,但它"编造"的细节太合理了,就像你没看过原始高清版,你根本不会怀疑。

人脸属性编辑

换发型、加胡子、变年龄、改表情。这些听起来很玄的操作,GAN做起来已经相当成熟了。

代表性的模型是StyleGAN系列(NVIDIA开源的StyleGAN3),它把人脸的各种属性"解耦"了——意思是它能单独控制头发、五官、年龄这些维度,改一个属性的时候不影响其他部分。这就是为什么你用AI脸部修图工具调大眼睛的时候,鼻子和嘴巴不会跟着变形。

图像修复(Inpainting)

去水印、去路人、去瑕疵——本质上都是"把图片上某个区域抹掉,然后让AI补上合理的内容"。GAN在这方面的表现已经好到有点可怕了。

你选中一个区域,生成器会分析周围的纹理、光照、颜色,然后"画"出一块跟周围环境融为一体的内容。FlowPix团队在做修图工具测评的时候发现,基于GAN的inpainting对规则纹理(比如墙面、地面)的补全效果尤其好,复杂纹理(比如人脸上去痣)偶尔会翻车。

风格迁移

想让你的照片变成梵高画风?赛博朋克风?日系小清新?CycleGAN能做到无监督的风格迁移——不需要成对的训练数据,直接学习两种风格之间的映射关系。

我个人觉得风格迁移目前还差点意思。那些"一键变油画"的效果嘛,看看图个乐还行,真拿来用总觉得有股廉价的AI味。不过这也和工具的调教水平有关——好的工具会把GAN的输出跟原图做精细的混合,差的就是直接糊上去。

去噪

高ISO照片的噪点问题折磨了摄影爱好者很多年。GAN的去噪不是简单地"抹平"(那样会丢失细节),而是在保留纹理的前提下去掉噪点。说白了就是它能分清"这是噪点"和"这是画面本身的纹理"。

GAN vs Diffusion模型:现在到底谁更强?

2026年的现实情况是,GAN在修图领域仍然是主力,但Diffusion模型(扩散模型)正在特定任务上赶超,两者更多是互补关系而非替代关系。

你可能听说过Stable Diffusion、DALL-E 3这些,它们用的是另一种技术路线——扩散模型。很多人问我:GAN是不是过时了?

没有。起码在修图这个具体场景下没有。

原因很简单:速度。GAN生成一张图只需要前向传播一次,快得很。Diffusion模型要反复迭代去噪(通常需要20-50步),慢很多。你用修图工具的时候希望等30秒出结果吗?肯定不想。所以AI修图工具背后大量使用的还是GAN。

但在生成质量上,Diffusion模型确实开始超过GAN了。特别是大面积的创意生成——比如画一个从没见过的场景——Diffusion更擅长。这也是为什么DALL-E和Midjourney用的是Diffusion架构。

不过——话说回来——现在最前沿的工具已经开始混合使用两种架构了。GAN负责快速处理,Diffusion负责精细打磨。我觉得这可能是未来的趋势。

GAN修图为什么偶尔会翻车

GAN修图翻车的主要原因是"幻觉"——生成器编造了不存在的细节,或者训练数据的偏见导致输出结果不合理。

了解原理之后,你就能明白为什么AI修图有时候会出一些离谱的结果了。

最经典的翻车场景是多余的手指。GAN在处理手部的时候特别容易出错,因为手的形态变化太多了,训练数据里手的姿势分布又不均匀。所以它经常"脑补"出六根手指或者扭曲的关节。

还有一个常见问题是"模式坍塌"(mode collapse)。简单说就是生成器找到了一种"偷懒"的方式——它生成的所有图都长差不多,虽然都能骗过判别器,但缺乏多样性。反映到修图上就是:不管你上传什么脸,出来的效果都长一个样。这个问题在深度学习修图的发展过程中一直在被优化。

老实讲,GAN翻车不可怕,可怕的是你意识不到它翻车了。有时候它编造的细节非常逼真,你以为是还原了原始信息,其实那是生成器"发挥"出来的。这在医学影像修复领域是个很严肃的问题——你不能让AI"脑补"出一个不存在的病灶。

GAN修图技术到底怎么学

普通用户不需要学GAN的数学原理,只需要理解它的能力边界就够了;如果是开发者,建议从PyTorch官方教程的DCGAN开始入门。

我见过不少人一上来就啃GAN的论文,看到满屏的损失函数和梯度公式直接劝退。

如果你只是用修图工具的话,知道以下几件事就够了:

- GAN擅长"生成"和"修补",不擅长精确控制微小的局部细节

- 放大倍数越高、修复区域越大,"脑补"的成分就越多

- GAN对人脸的处理比风景、物体更成熟(因为训练数据多)

- 不同工具用的GAN架构不一样,效果差距可以非常大

如果你是技术向的,想自己玩一玩,推荐从PyTorch的DCGAN人脸生成教程开始。跑通一遍大概两三个小时,你就能直观感受到GAN是怎么一步步学会"画脸"的。那种从一片噪声慢慢变成人脸的过程,说实话挺震撼的。

然后可以去看看AI修图软件的技术架构,了解这些基础研究是怎么被工程化落地到实际产品中的。中间的gap比你想的要大——学术界追求的是跑分高,工业界追求的是速度快、效果稳、不翻车。这两件事经常矛盾。

2026年GAN在AI修图中的最新进展

2026年GAN修图的最大进展是"可控性"大幅提升和实时处理能力的突破,轻量化GAN让手机端也能跑出专业级效果。

去年(2025)到现在,我比较关注的几个方向:

一个是GAN跟Transformer的融合。传统GAN用的是卷积神经网络,现在有人把Vision Transformer塞进去,生成质量确实上了一个台阶。不过代价是计算量变大了,对显卡要求更高。

另一个是手机端的轻量化GAN。以前你想跑GAN修图得用电脑,现在不少修图APP已经把精简版的GAN模型塞进手机芯片了。虽然效果比电脑端差一些,但做做基本的美颜磨皮绰绰有余。FlowPix在这方面也做了不少优化工作——移动端出图速度控制在2秒以内。

还有一个方向是3D-aware GAN——让GAN理解三维空间。这意味着修图的时候可以改变光照方向、改变人脸朝向,而且效果比纯2D处理自然得多。这个技术跟AI人物修图的结合前景很大。

说到底,GAN这个框架从2014年到现在已经10年出头了,依然在进化。有人说它会被Diffusion完全取代,我觉得不太可能——至少在需要实时处理的修图场景里,GAN的速度优势短期内无可替代。

写在最后

今天聊了这么多关于GAN的东西,回过头来看,我觉得普通用户其实不需要知道太多底层原理。你只需要知道——那些让你照片变好看的AI工具,背后有一个很聪明的"造假+验假"的机制在运转。

但如果你跟我一样,喜欢知道一个东西"为什么"能工作,那了解GAN绝对值得。它改变了整个AI修图的游戏规则,而且还在继续改变。

觉得这篇文章把GAN讲明白了?分享给你那些总问"AI修图怎么这么厉害"的朋友吧——下次他们再问,你就可以装作很懂地说"哦,那是GAN"了。