AI计算修图软件是怎么做出来的?技术架构揭秘 - FlowPix

简单说:一款AI修图软件的核心是深度学习模型,开发流程大致分为数据收集→模型训练→推理优化→产品封装四个阶段。一个靠谱的AI修图产品,从研发到上线通常需要6-18个月。

AI计算修图软件是怎么做出来的?技术架构揭秘

有个做前端开发的同事上周问我:"你们天天说AI修图AI修图,这玩意到底是怎么做出来的?是不是就写几个滤镜加上'AI'俩字就开始卖了?"

这问题问得好。说实话,市面上确实有一些产品就是传统算法换了个皮,但真正基于深度学习的AI计算修图软件,背后的技术链条比大多数人想的复杂得多。今天我尽量用大白话把这事儿讲明白。

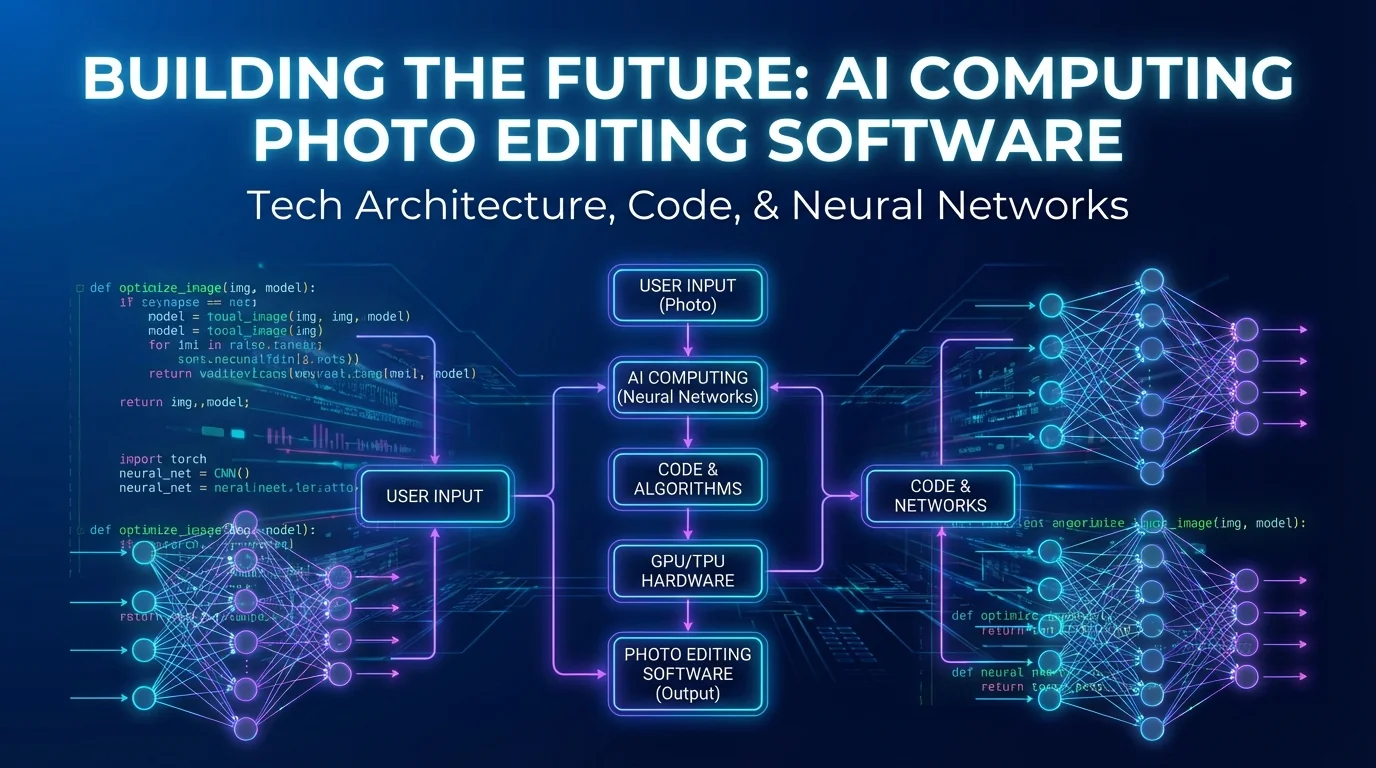

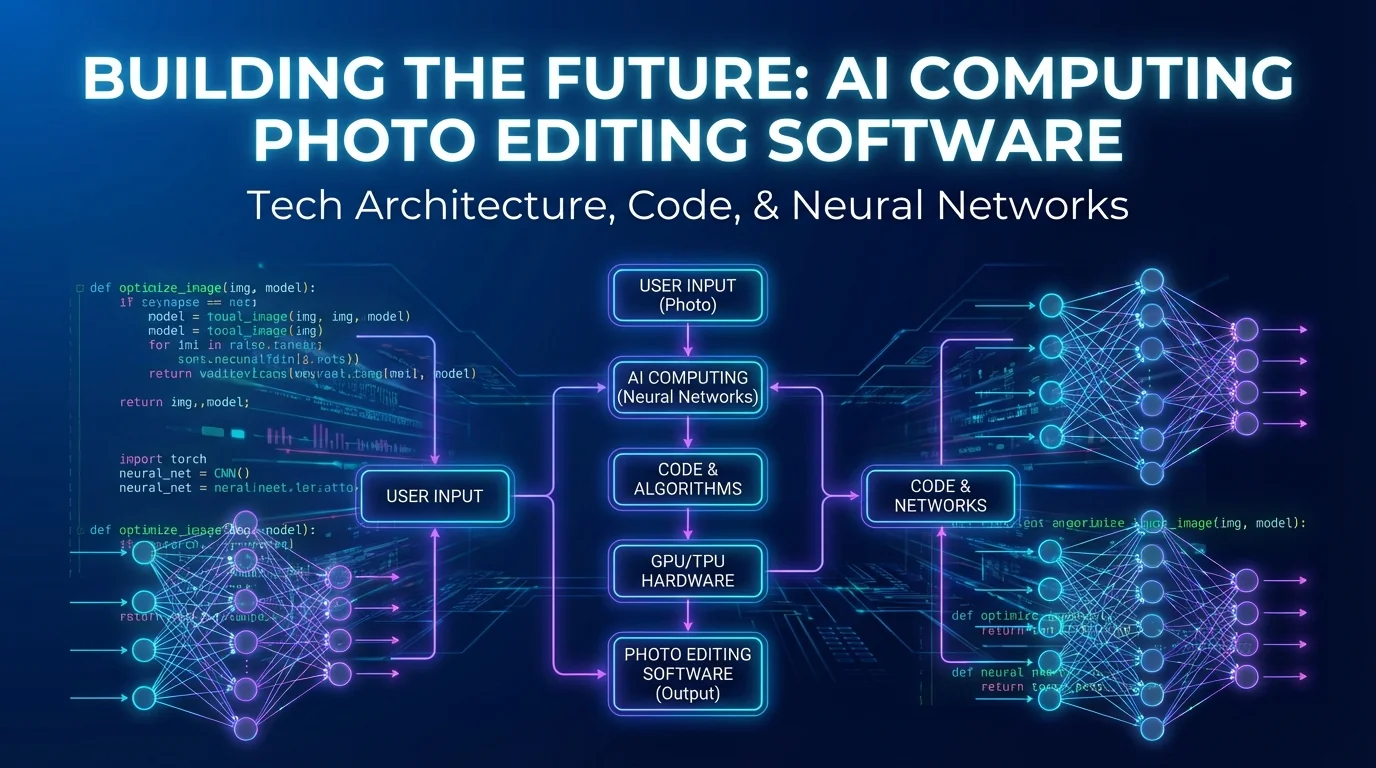

AI修图软件的整体架构长啥样

一款典型的AI修图软件由三层组成:最底层是AI模型引擎,中间是推理服务层,最上面是用户界面和交互逻辑。

你可以把它想象成一家餐厅。AI模型是厨师(负责"做菜"),推理服务层是后厨管理系统(负责接单、分配、出餐),用户界面就是你面前的菜单和桌子(你只管点菜、吃饭)。

具体来说:

- 模型层:包含各种预训练的深度学习模型——人脸检测模型、皮肤分割模型、超分辨率模型、风格迁移模型等等。一个修图软件背后可能跑着十几个不同的模型。

- 推理层:负责把用户上传的图片送进模型处理,然后把处理结果返回。这一层要解决的核心问题是速度——用户上传一张照片,总不能让人等两分钟吧。

- 应用层:就是你看到的那些按钮、滑块、滤镜预览。把复杂的AI能力包装成"一键美颜""智能抠图"这样的简单操作。

第一步:数据收集和标注

做AI修图的第一步不是写代码,而是收集海量的图片数据,然后请人一张张标注——这是最费钱、最费时间的环节。

比如你要做一个"AI磨皮"功能。模型需要学习"什么是好的皮肤质感",所以你得准备两组照片:一组是原片(有痘痘、毛孔、斑点的),一组是对应的精修片(修过皮肤的)。模型通过对比这两组照片,学会"怎么把粗糙皮肤变光滑"。

这些数据从哪来?一般有几个来源:

自己拍。有些大公司会组建自己的摄影团队,专门拍各种光线、角度、肤色的人像照片。然后雇专业修图师修出对应的"完美版"。这种数据质量最高,但成本也最吓人——修一张人像精修图市场价几十到上百元,你想想需要几万张什么概念。

公开数据集。学术界有不少开源的人脸和图像数据集,比如CelebA就有超过20万张名人面部照片。但这些数据通常不包含对应的精修版,需要自己后期处理。

用户授权数据。一些修图平台会在用户协议里写明,用户上传的照片可用于"产品改进"。这是一大数据来源,但隐私问题很敏感。

第二步:模型训练

数据准备好之后,就该训练模型了。这个阶段的核心工作是选择网络架构、设计损失函数、然后用GPU集群跑上几天到几周。

目前AI修图领域最主流的网络架构有几种:

U-Net及其变体——这是图像分割和修复领域的"标配"。它的结构像个U形管道,输入图片从左边进去,经过层层压缩提取特征,再层层展开恢复细节。大部分AI磨皮、去斑功能用的就是这类架构。

GAN(生成对抗网络)——两个网络互相对抗:一个负责生成"修过的图",另一个负责判断"这图是真修的还是AI生成的"。两个网络越打越强,最后生成的结果就越来越真实。AI换脸、风格迁移很多用的是GAN。

Transformer架构——最近两年在图像领域也火了起来。它特别擅长捕捉图片中远距离的关系——比如让脸部的光影和背景的光影保持一致。

根据arXiv上的论文统计,2024-2025年发表的AI图像编辑论文中,超过40%采用了Transformer或其混合架构,GAN的占比从三年前的60%下降到了约25%。趋势很明显。

训练一个修图模型需要多少算力?粗略算一下,用4-8张A100显卡训练一个中等规模的人像修复模型,大概需要3-7天。如果是从头训练一个大模型,周期可能拉长到一个月以上。这就是为什么小团队很难独立开发AI修图软件——光GPU租赁费用就是一笔巨大开支。

第三步:推理优化(让模型跑得快)

训练出来的模型往往又大又慢,直接部署到产品里用户体验会很差,所以必须做推理优化——把模型"瘦身"并加速。

这个环节在FlowPix编辑部内部我们叫它"从实验室到车间"的过程。学术论文里的模型处理一张图可能要好几秒,但产品要求是毫秒级响应。怎么压?

常用的优化手段:

- 模型量化:把模型参数从32位浮点数压缩到16位甚至8位整数。精度损失很小,但速度能快2-4倍

- 知识蒸馏:用一个大模型("老师")去教一个小模型("学生"),让小模型学到大模型的核心能力,但体积只有原来的十分之一

- ONNX/TensorRT:把模型转换成专门优化过的推理格式,充分利用GPU的并行计算能力

- 端侧部署:对于手机端的修图App,还需要把模型转成CoreML(iOS)或TFLite(Android)格式

这一步做得好不好,直接决定了用户体验。同样的AI美颜功能,优化好的产品处理一张照片只要0.3秒,优化差的要等3秒。三秒听起来不长?你打开美图秀秀点一下美颜试试,要是等三秒你肯定觉得卡了。

第四步:产品封装和上线

模型和推理引擎准备好之后,还要做大量的工程工作:设计UI、处理边缘case、做A/B测试、适配各种设备,这些工作量不比模型训练少。

我认识一个做AI修图App的创业团队,三个人从模型训练到产品上线花了十个月。其中模型相关的工作占了四个月,剩下六个月全在做产品工程——界面设计、异常处理、用户反馈迭代、应用商店审核。

有几个容易被忽略的工程细节:

边缘case处理。用户上传的照片千奇百怪——极度曝光、极度模糊、奇怪的角度、戴了面具只露一只眼睛。模型训练时没见过这些情况,推理出来的结果可能很离谱。所以产品里需要加一层"前置检测",发现异常输入就走兜底逻辑。

云端 vs 本地。修图计算放在云端还是用户设备上?云端算力强但要传图,涉及隐私和网络延迟。本地计算保护隐私但手机算力有限。很多产品采用混合方案——轻量处理本地做,重度处理上传到云端。

关于AI修图的更多技术细节,我们之前在AI修图算法原理和神经网络修图技术里都有展开讲过。如果你对模型训练的数据层面感兴趣,也可以看看AI修图与深度学习那篇。

普通人能自己做一个AI修图工具吗

技术上可以——GitHub上有大量开源的图像处理模型,拿来用几行代码就能跑起来。但做成一个"产品"的门槛要高得多。

如果你只是想玩玩,用Python + 开源模型,一个下午就能搭出一个简单的"AI修图脚本"。比如用CodeFormer做人脸修复、用Real-ESRGAN做图片超分辨率,效果都相当能打。

但如果你想做成一个面向用户的产品?那就是另一回事了。你需要考虑并发处理、存储管理、用户体系、付费系统、客服支持、合规审查……技术只占了三成,剩下七成是产品和运营。

我个人觉得,对于独立开发者来说,更现实的路径是基于现有的API来做产品。比如调用主流AI修图工具的开放接口,在上面做二次开发,省掉了模型训练的巨大成本。

未来的技术方向

端侧大模型、实时视频修图、多模态控制(用文字指挥修图)是接下来最值得关注的三个方向。

现在手机芯片的AI算力越来越猛,很多原本只能在云端跑的模型开始往手机上搬。苹果的Neural Engine、高通的Hexagon处理器、联发科的APU,都在争这块蛋糕。以后你打开相机的瞬间,AI修图可能已经实时完成了——你按下快门看到的就是修好的照片。

多模态控制也很有意思。你对着一张照片说"把天空变成夕阳色,人脸亮度提高一点",AI就按你的描述修改。Adobe的Firefly已经在往这个方向走了,虽然现在还不太成熟,但趋势很清楚。

说实话,做AI修图产品这行越来越卷了。但对用户来说这是好事——竞争越激烈,产品就越好用、越便宜。

觉得这篇技术揭秘对你有帮助的话,分享到你的技术群或者朋友圈吧。关于AI修图的问题,欢迎在评论区交流讨论。