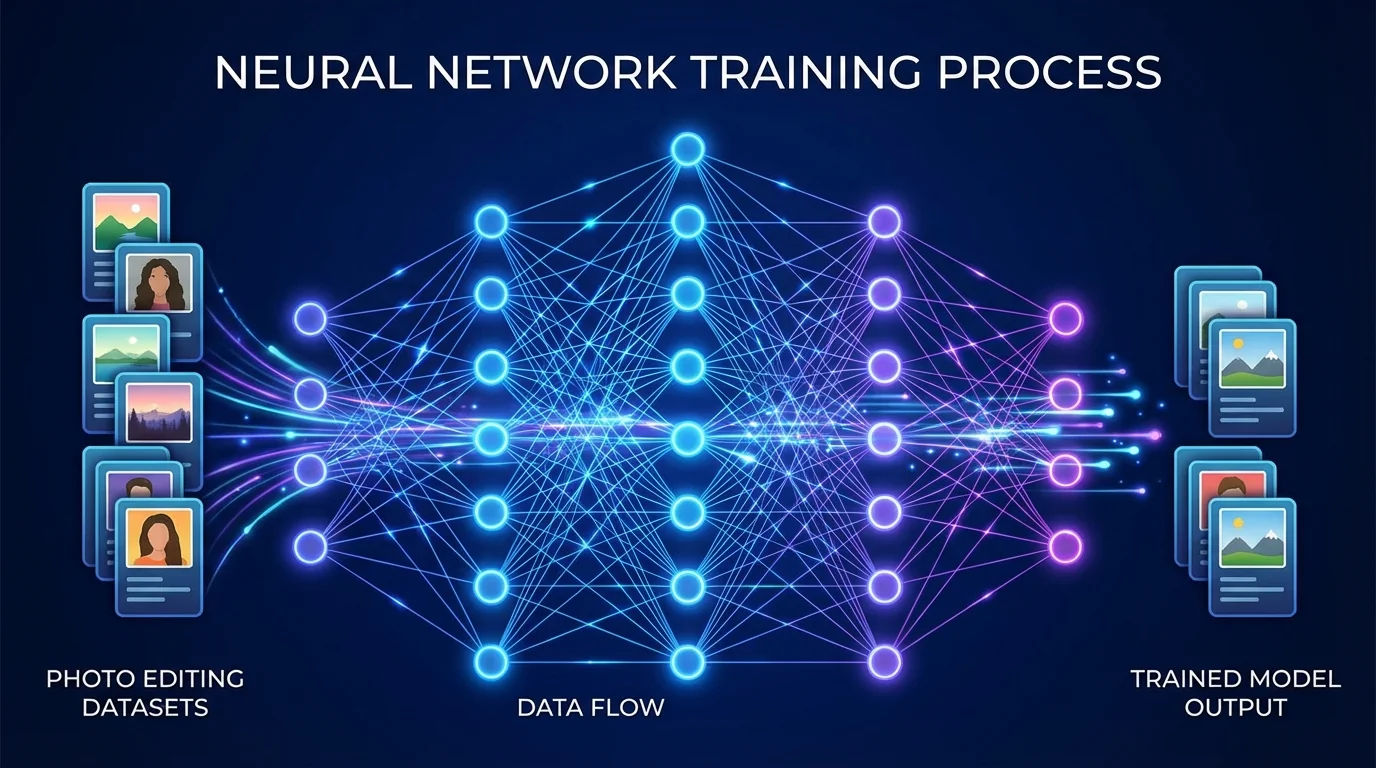

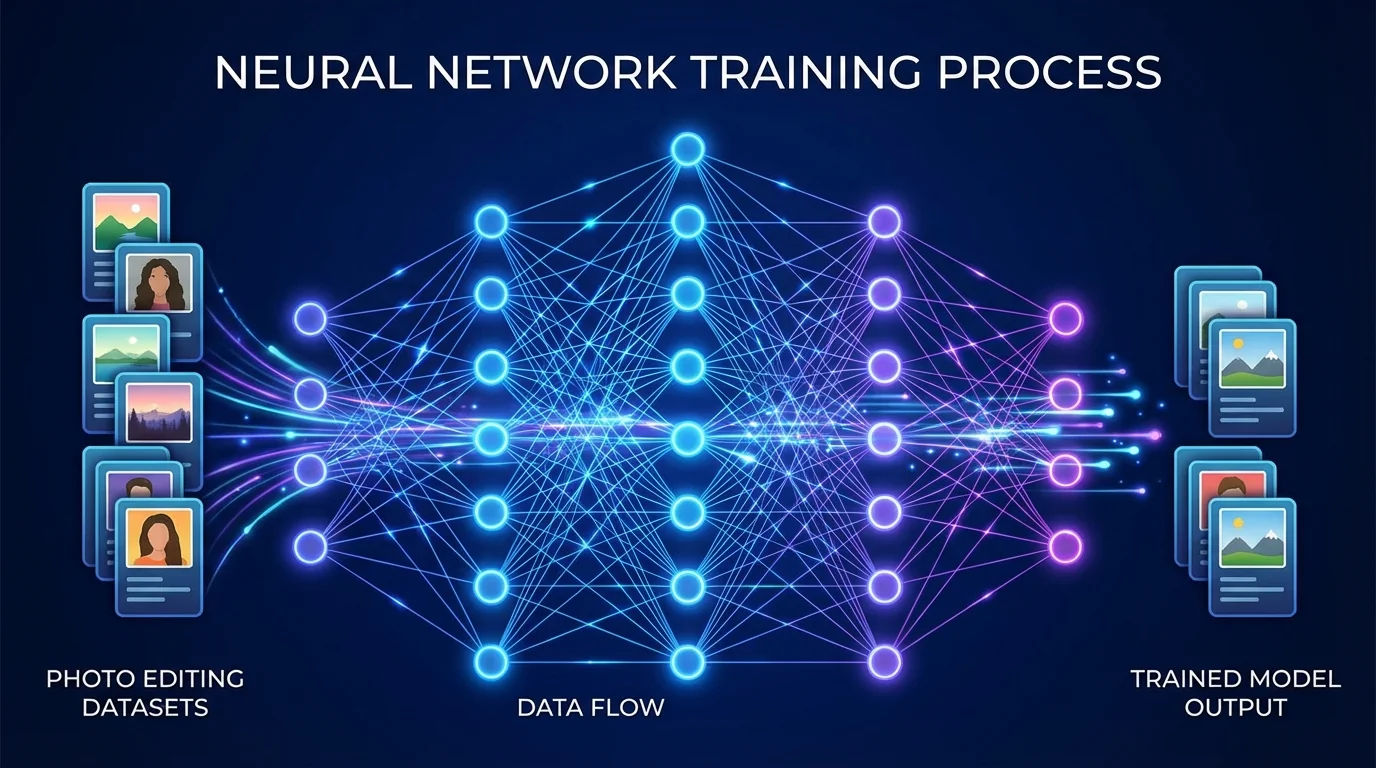

AI修图模型是怎么训练出来的?通俗易懂的技术科普

简单说:AI修图模型训练分三步——准备大量「原图+修后图」配对数据、选好模型架构(GAN或扩散)、用算力反复迭代让模型学会「怎么修」。数据质量比数量重要,算力烧钱。

你点一下「一键美颜」,AI秒出结果。背后这套模型是怎么练出来的?

我去年跟做算法的朋友聊过,他吐槽说训练一个修图模型要烧几十万。好奇查了资料,用人话捋一捋——不搞技术也能懂个大概。

第一步:数据集从哪来

训练AI修图,核心是「成对数据」——原图一张,修后图一张。模型学的是「从A变到B」的映射。数据越多越多样,模型越稳。

抠图模型:需要「原图+抠好的mask」或「原图+去背景图」。美颜模型:需要「素颜照+精修照」配对。消除模型:需要「有水印/杂物的图+干净图」。

数据从哪搞?有的公司自己拍、自己修,攒内部数据集。有的用公开数据集,比如ImgEdit这种120万对编辑样本的。2025年还有GPT-IMAGE-EDIT-1.5M,150万级指令编辑三元组——指令+原图+修后图,专门给指令式修图用。数据规模上去了,但质量筛选很关键,垃圾数据喂多了模型会学歪。

第二步:模型架构选什么

修图模型常用GAN或扩散模型。GAN是「生成器+判别器」对抗训练,扩散是「加噪-去噪」学分布。选哪种看任务和算力。

GAN:两个网络打架,一个造图一个挑刺。适合超分、去噪、风格迁移,训练快但容易崩。扩散模型:先给图加噪声,再学怎么一步步去噪恢复。Stable Diffusion、DALL-E都用这套,效果更好,但算力吃得多。

Stability AI的Stable Diffusion开源后,很多人基于它做修图微调。商业产品里各家架构不一样,有的用U-Net做分割,有的用Transformer做全局理解。想了解具体算法可以看AI修图算法揭秘,还有神经网络怎么修图。

第三步:训练怎么跑

训练就是「喂数据-算损失-调参数」循环。损失函数告诉模型「你修得离标准答案差多少」,反向传播更新权重,迭代几万到几百万步。

简单说:模型输出一张图,跟标准答案(修后图)比,差多少算个分数。分数高就说明修得不好,梯度反传回去调参数。下一轮再试,慢慢分数就下来了。

难点在哪?数据要对齐——原图和修后图必须一一对应,不能乱配。标注成本高,尤其是美颜这种主观任务,什么叫「修得好」很难统一。算力也烧钱,大模型训练动不动几百张A100跑几周。

根据Grand View Research报告,AI训练数据集市场(含图像)到2033年将保持高速增长,图像编辑类数据需求尤其大。想了解主流模型可以看主流AI修图模型盘点,技术趋势看AI修图趋势2026。

FlowPix编辑部结论:AI修图训练没啥黑魔法,就是数据+架构+算力。普通人用现成工具就行,真想搞懂原理,记住这三步就够了。