AI修图技术是怎么研发出来的?从实验室到你手机里的路

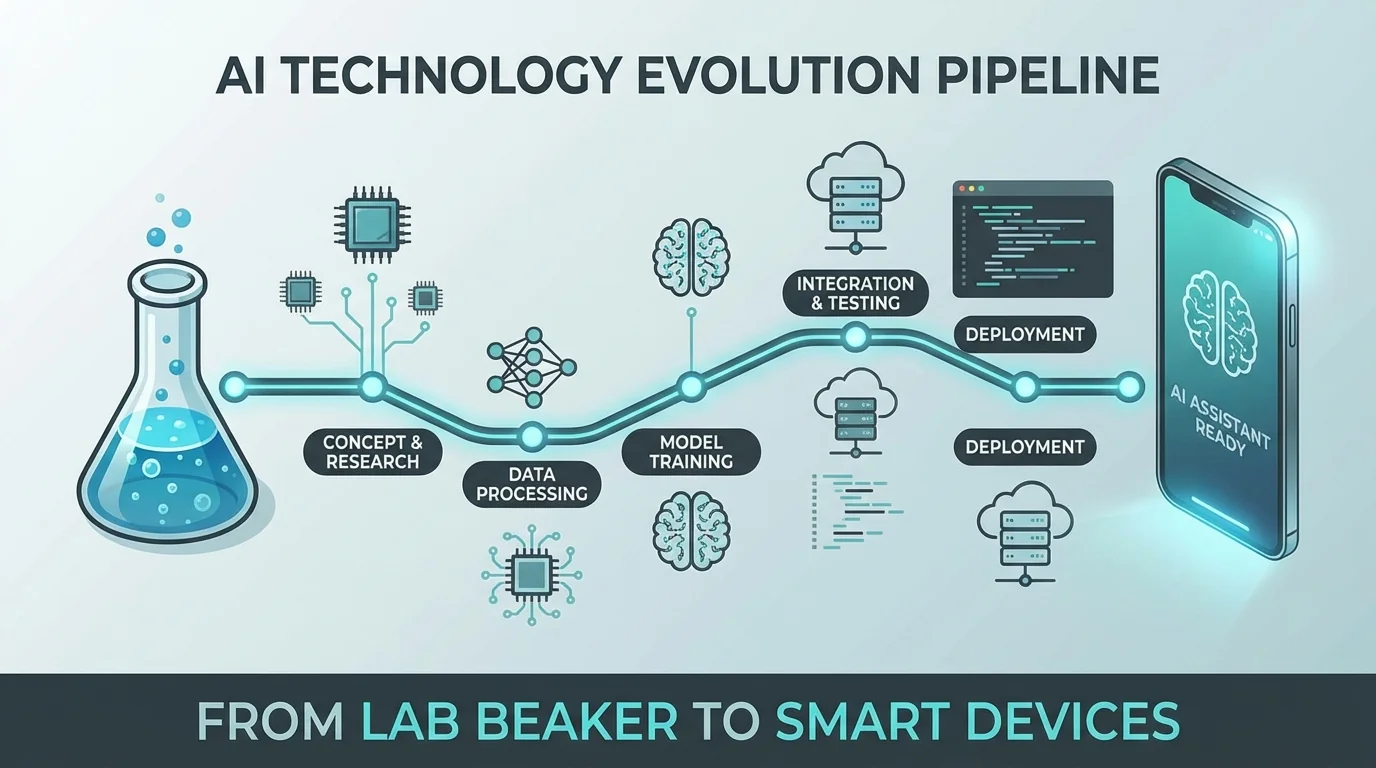

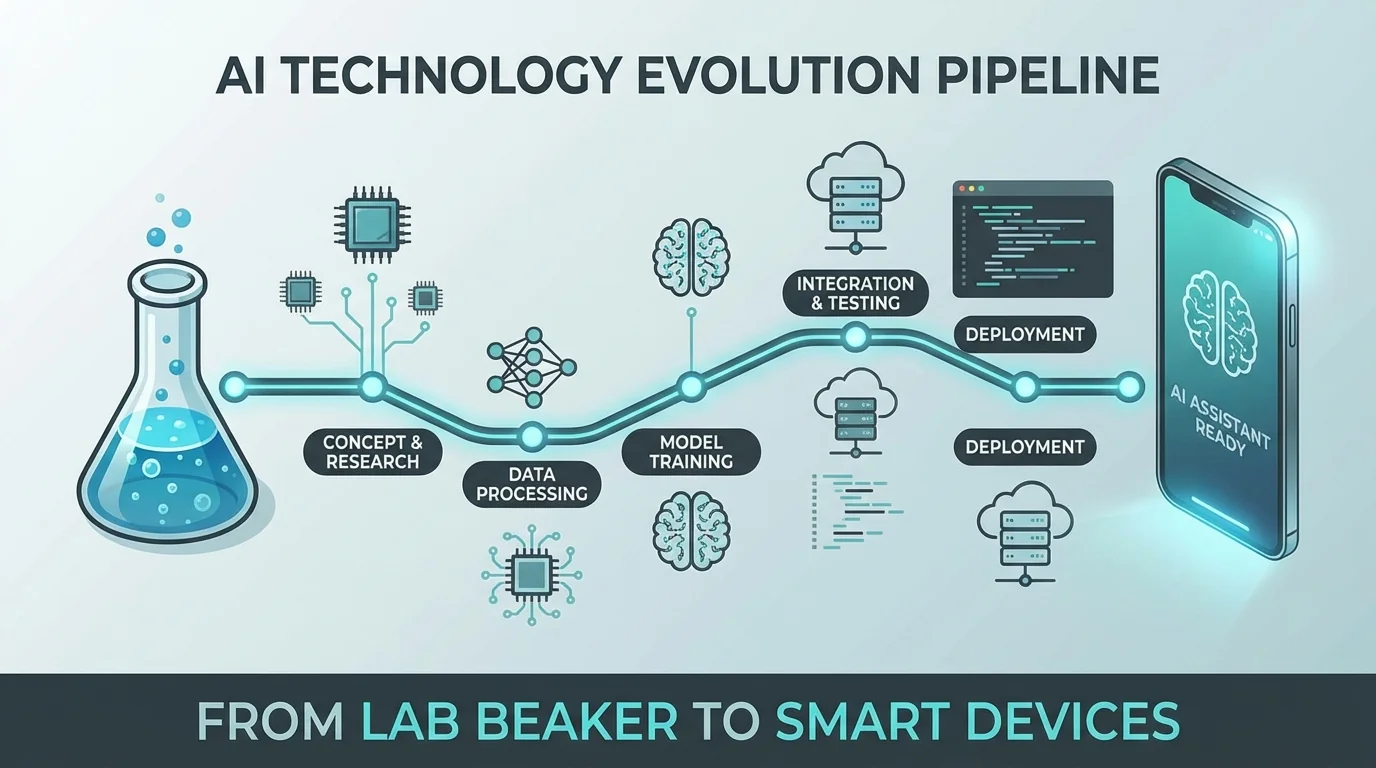

简单说:AI修图技术从学术论文起步,经过GAN、扩散模型几代迭代,再通过工程优化和产品打磨,才到你手机里。论文发出来到能用,往往要两三年。

你点一下美颜,秒出结果。这玩意儿怎么来的?

去年跟一个做计算机视觉的朋友吃饭,他吐槽说发论文和做产品完全是两码事。实验室里跑得动,不代表手机能跑。好奇查了一圈,把这条路捋一捋——从论文到App,中间隔了好几道坎。

学术论文是起点

AI修图技术大多起源于顶会论文,ImageNet、CVPR、ICCV这些。研究者先解决「能不能做」,再考虑「能不能用」。

2014年GAN(生成对抗网络)出来,图像生成领域炸了。两个网络打架,一个造图一个挑刺,假图越来越真。很快有人拿来做风格迁移、去噪、超分辨率。那时候的论文,跑一张图可能要几分钟,显存吃满。

2015-2018年,arXiv上图像编辑类论文井喷。去背景、美颜、老照片修复——每个方向都有团队在搞。但论文里的模型往往只跑在实验室的GPU上,普通人用不上。

扩散模型是转折点。2020年DDPM提出,2022年Stable Diffusion开源,效果一下子把GAN甩开一截。细节更丰富,训练更稳定。但算力需求也上去了——想了解具体算法可以看AI修图算法揭秘,还有神经网络怎么修图。

从实验室到产品的三道坎

论文到产品要过三关:模型压缩、推理加速、体验打磨。很多技术死在第一关。

第一关:模型能不能变小?

实验室里跑的是几十亿参数的大模型,手机端跑不动。得做蒸馏、剪枝、量化——把模型压到几十MB甚至几MB,还要尽量保住效果。这活儿技术含量高,大厂有专门的团队在做。

第二关:推理能不能快?

论文里跑一张图可能几秒,用户等不了。得用TensorRT、CoreML、ONNX这些框架做推理优化,有的还能跑在手机NPU上。FlowPix编辑部实测过不少App,本地跑的美颜和云端跑的速度差挺多——本地快但功能有限,云端功能全但依赖网络。

第三关:体验能不能好?

技术再牛,用户不会用也白搭。一键美颜、滑块调强度、预设风格——这些交互设计都是产品团队一点点磨出来的。有的算法效果不错,但调参太复杂,用户根本玩不转,最后就砍掉了。

根据Grand View Research报告,全球AI计算机视觉市场(含图像编辑)到2030年将保持年均20%以上增长,其中移动端部署是增长最快的细分方向之一。

主要技术突破

修图AI能普及,靠的是几项关键突破:扩散模型、指令式编辑、端侧部署。三者缺一,都到不了你手机里。

扩散模型让生成质量上了台阶——Stability AI开源Stable Diffusion后,很多人基于它做修图微调。指令式编辑(用文字描述要改什么)让交互变简单,不用学复杂的选区、蒙版。端侧部署让隐私和速度都兼顾,照片不用上传就能修。

各家产品路线不一样。有的用自研大模型+云端推理,有的用轻量模型+本地推理。想了解主流模型可以看主流AI修图模型盘点,技术趋势看AI修图趋势2026。

训练这块,数据质量比数量重要。想搞懂模型怎么练出来的,看AI修图模型是怎么训练的。FlowPix会持续跟进这类技术科普,有想了解的可以留言。