AI修图完整过程揭秘:从导入到出图每一步在做什么

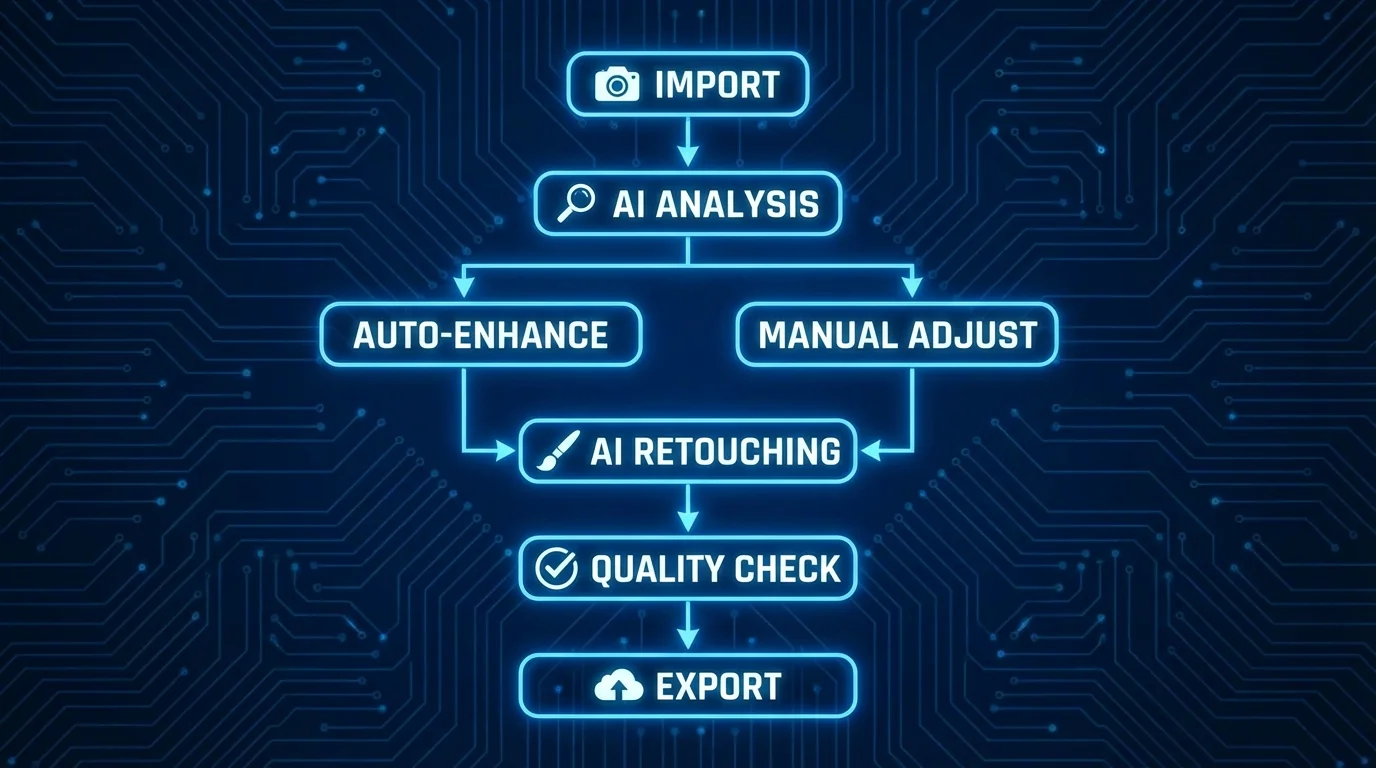

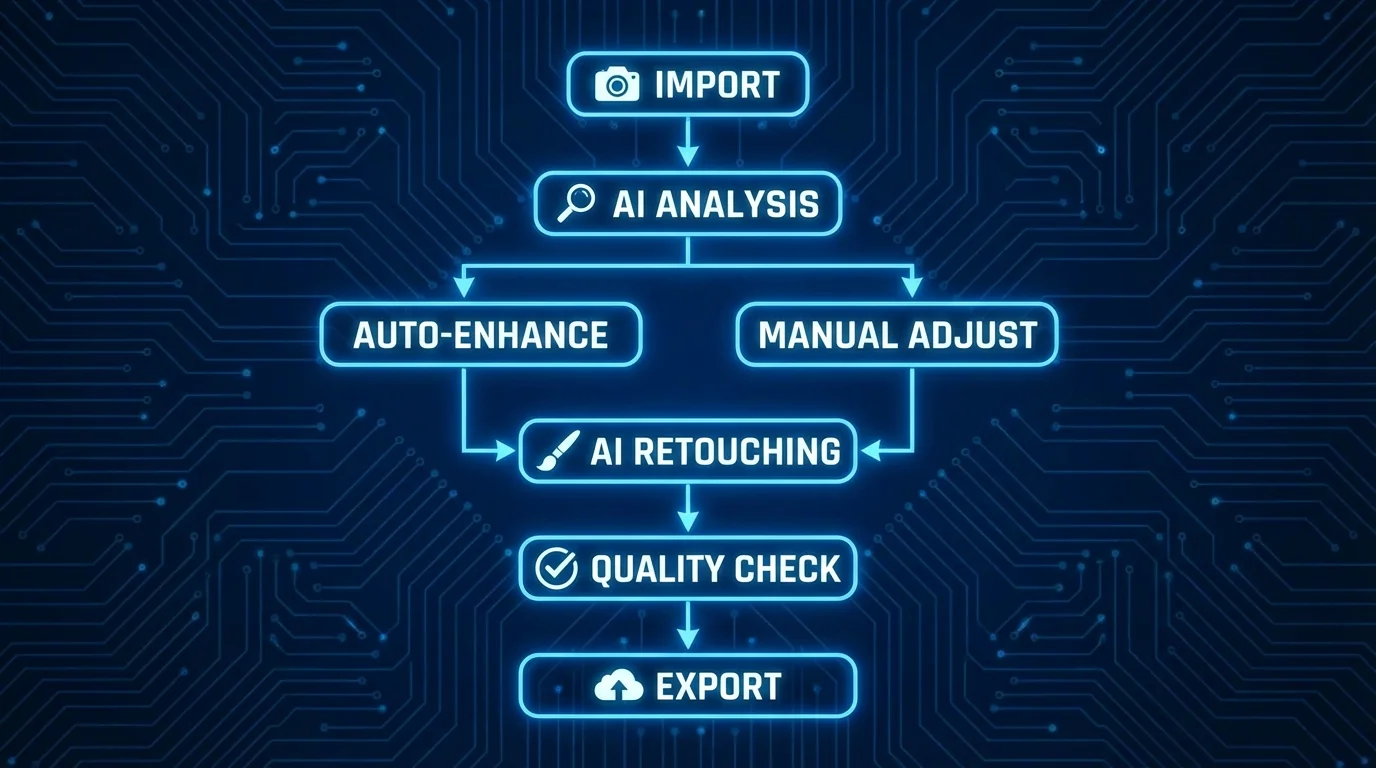

简单说:AI修图分五步——上传编码、场景分析、模型推理、后处理、输出编码。你看到的"一键修图"背后,是云端GPU在跑神经网络,整个过程通常2-10秒。

你有没有好奇过:点一下"一键美颜",AI到底在干嘛?

表面上看就是上传、等几秒、出图。但背后其实有一套完整流程。今天把每一步拆开讲,让你知道自己的照片经历了什么。

第一步:上传与编码

你的照片先被压缩、编码,然后通过网络传到云端服务器——这一步决定了画质上限和等待时间。

点"导入"或"选择照片"之后,App会先读取原图。如果原图很大(比如手机拍的4000万像素),很多App会先压缩再上传,不然传太慢。压缩比例各家不一样,有的保留原图,有的压到1080p——这就是为什么有些工具修完画质会掉。

编码格式一般是JPEG或PNG,转成适合传输的格式。上传速度取决于你的网速和服务器位置。国内App的服务器在国内,通常快;国外工具可能慢一点。

隐私提醒:照片上传到云端意味着数据会离开你的设备。如果特别在意隐私,可以选支持本地处理的工具,比如部分手机自带相册的AI功能。更多可以看本地离线AI修图。

第二步:场景与内容分析

AI会先"看懂"你的图——识别人脸、物体、背景、光线,为后续处理做准备。

这是AI修图区别于传统修图的关键。传统软件不知道图里有什么,你得手动选区、手动调参数。AI会先跑一遍识别模型:这是人像、这是风景、这是产品图;人脸在哪、皮肤区域在哪、天空在哪。

用的技术主要是计算机视觉里的目标检测和语义分割。神经网络在训练时见过海量标注数据,学会了"人长什么样"、"天空长什么样"。你的图进来,模型输出一张"语义图"——每个像素属于哪个类别,后续处理就按这个来。

比如你点"一键美颜",AI先找到人脸,再找到皮肤区域,然后只对皮肤区域做磨皮,眼睛嘴巴不动。这就是为什么AI美颜比全局滤镜自然——它知道该动哪、不该动哪。想深入了解可以看AI修图模型是怎么训练出来的。

第三步:模型推理与处理

根据你的操作(美颜、抠图、增强等),对应的神经网络开始"算"——这是最耗时的步骤。

不同功能对应不同模型。美颜用美颜模型,抠图用分割模型,超分用超分辨率模型。你选什么功能,就调用什么模型。

模型推理是在GPU上跑的。云端服务器有大量GPU,你的图进去后排队等待,轮到你了就开始算。算的过程就是矩阵运算——输入像素数据,经过几十上百层神经网络,输出新的像素数据。听起来简单,但计算量巨大,一张图可能要算几亿次乘法。

所以为什么有时候要等几秒甚至十几秒?因为真的在算。不是卡住了,是AI在干活。根据NVIDIA的数据,现代AI图像处理单张推理通常在1-5秒,复杂操作可能更久。

批量处理时,多张图可以并行算,所以总时间不会线性增加。这也是AI修图效率高的原因之一。

第四步:后处理与合成

模型输出的是"原始结果",还要经过锐化、色彩校正、边缘融合等后处理,才能变成你看到的最终图。

神经网络直接输出的图有时候会有瑕疵:边缘有锯齿、色彩偏色、噪点增多。所以会加一层后处理:边缘羽化、色彩空间转换、降噪。这些步骤比较轻量,耗时很少。

如果是抠图换背景,还要做融合:把抠出来的主体和新背景合成,调整光影、色调统一。好的工具会做得比较自然,差的会有明显拼接感。

第五步:编码与输出

处理完的图被编码成JPEG/PNG,传回你的设备,保存到相册或显示在界面上。

最后一步和第一步类似,只是方向反过来。云端把结果图编码、压缩、传回。你的App收到后解码、显示。保存时再按你选的画质做一次编码——选"高清"就少压一点,选"原图"就尽量无损。

整个流程走完,从你点"修图"到看到结果,通常2-10秒。取决于图片大小、网络速度、服务器负载、功能复杂度。想了解更完整的操作流程可以看AI怎么修图完整流程。

下次用AI修图的时候,可以想想:你的照片正在云端被神经网络"理解"和"改造"。这大概就是2026年修图的魔法吧。