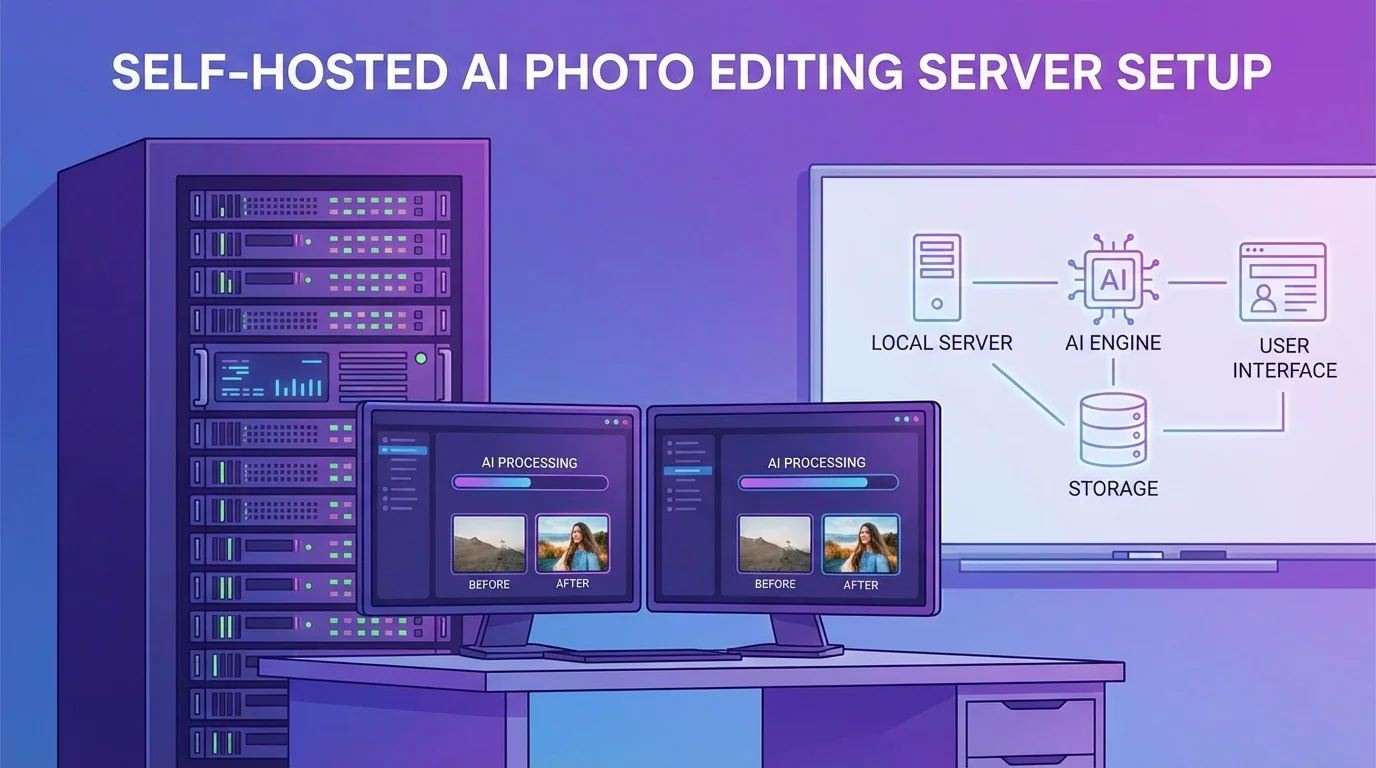

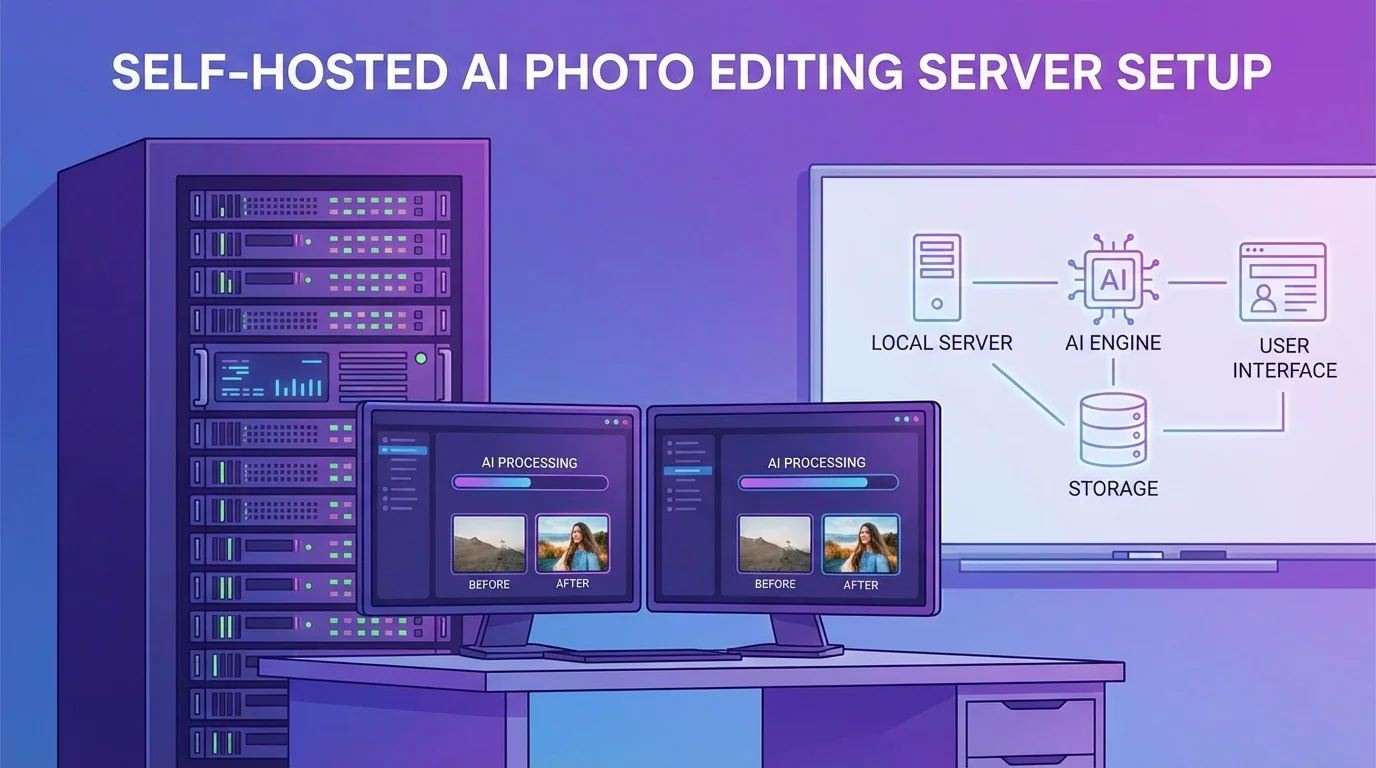

自建AI修图服务器教程:从零搭建私有化修图系统的完整方案

自建AI修图服务器教程:从零搭建私有化修图系统的完整方案

简单说:自建AI修图服务器的核心是一台带独立显卡的机器加上开源模型,总成本大概5000-15000元就能搞定。数据完全在自己手里,不限次数不限量,适合每天修图量超过200张的团队。

为什么要自己搭服务器?

自建AI修图服务器最大的价值不是省钱,而是数据安全和不受限制。你的客户照片不用上传到第三方平台,修图量也没有每日上限。

我个人觉得,对于大部分个人用户来说,用在线工具完全够了。但如果你是开工作室的,或者在电商公司负责产品图——每天几百张图往外传,心里多少会犯嘀咕。

去年我帮一个做婚纱摄影的朋友搭过一套。他当时的痛点特别明确:旺季一天800张照片要处理,之前用某SaaS平台月费2000多块,还经常排队等出图。自己搭了之后,一次性投入大概12000块硬件成本,三个月就回本了。

根据Grand View Research 2025年的报告,全球AI图像编辑市场规模已经突破38亿美元,年增长率超过26%。这说明什么?用AI修图已经不是什么新鲜事了,但怎么用得更聪明——这才是关键。

硬件要求到底多高?

自建AI修图服务器的硬件门槛比很多人想象的低,一张8GB显存的显卡就能跑起来基础模型。当然,显存越大越舒服,这毫无疑问。

说实话,很多教程把这事说得特别复杂,动不动就推荐A100、H100这种企业级显卡。拜托,那是给大公司烧钱用的。我们中小团队的配置思路完全不一样。

硬件配置参考:

| 档位 | 显卡 | 内存 | 适用场景 | 预算 |

|---|---|---|---|---|

| 入门 | RTX 3060 12GB | 32GB | 个人/小工作室,日处理100张内 | 约5000元 |

| 主力 | RTX 4070 Ti 16GB | 64GB | 中型团队,日处理200-500张 | 约10000元 |

| 高端 | RTX 4090 24GB | 64GB+ | 大量并发,日处理1000张+ | 约15000元+ |

这里有个坑必须提一下:别只看显卡,内存也很重要。模型加载进内存之后常驻的那部分相当吃资源。我第一次搭的时候只配了16GB内存,结果跑两个模型就开始疯狂用swap,速度慢得让人崩溃。后来加到64GB才舒坦。

CPU倒是无所谓,i5级别就够了。SSD建议上1TB以上,模型文件动辄几个GB。

用什么开源模型?

目前自建AI修图最主流的方案是基于Stable Diffusion生态,配合ControlNet和各类专用模型来实现不同修图功能。整套生态完全免费开源。

你可能会问:开源模型效果跟商业工具比怎么样?

老实讲,单个功能拎出来对比,开源方案在某些场景确实不如商业AI修图工具。但胜在灵活——你可以自己训练、自己调、自己组合。而且2026年的开源模型进步太快了,很多效果已经追上甚至超过了一年前的商业方案。

核心模型推荐:

- 超分辨率/画质增强:Real-ESRGAN,老牌选手,效果稳定

- 人像美颜/磨皮:GFPGAN 或 CodeFormer,后者在保细节方面更强

- 背景去除/抠图:RMBG-2.0 或 SAM 2(Meta出品)

- 去水印/物体消除:LaMa,这个模型我用了快两年了,依然是最优解

- 综合修图:基于ComfyUI节点式工作流,想怎么组合就怎么组合

这些模型可以在Hugging Face上免费下载。如果你对开源AI修图工具不太了解,建议先看看那篇详细介绍。

实际搭建步骤

整个搭建流程大概需要2-4小时,分为环境准备、模型部署、API接口搭建三步。不需要你是专业运维,会基本的命令行操作就行。

第一步,装好操作系统和显卡驱动。推荐Ubuntu 22.04 LTS,Windows也能跑但坑更多。显卡驱动用NVIDIA官方的,然后装CUDA 12.x和cuDNN。

这里插一嘴——很多人在这步就卡住了,通常是CUDA版本和PyTorch版本对不上。我的建议是直接用Conda创建虚拟环境,省去一堆版本冲突的头疼问题。

第二步,选择你的部署框架。有三个主流选择:

- ComfyUI — 最灵活,节点式操作,适合需要自定义工作流的团队。想了解更多可以看AI修图软件安装教程

- Stable Diffusion WebUI (A1111) — 最老牌,插件生态最丰富,适合刚入门的

- 自己写Python脚本 — 最轻量,适合只需要单一功能(比如只做超分)的场景

我个人最推荐ComfyUI。虽然上手有点学习曲线,但一旦搞懂了,你可以把各种模型串成流水线——照片进去,自动抠图、美颜、增强、输出,全程不用人工干预。

第三步,搭API接口。如果你的团队需要通过网络调用修图服务(比如设计师在自己电脑上提交图片),可以用FastAPI或者Flask包一层HTTP接口。ComfyUI本身也支持API模式,启动时加上 --listen 0.0.0.0 参数就行。

性能优化这事不能偷懒

部署完只是第一步,真正影响日常使用体验的是推理速度和并发能力的优化。裸跑和优化后的速度差距能到3-5倍。

几个关键优化点:

第一个是半精度推理。把模型从FP32切到FP16,速度翻倍,效果损失肉眼几乎看不出来。绝大多数开源模型都支持。

第二个是模型预加载。别每次请求都重新加载模型,常驻内存是基本操作。我之前帮别人优化的时候,发现他每处理一张图都在重新加载一次CodeFormer——那单张处理时间从0.8秒飙到12秒,离谱。

第三个是批处理。如果你要做批量修图,把图片打成batch一起送进模型,比一张张处理快得多。RTX 4090跑Real-ESRGAN做4倍超分,batch_size设成4的时候,吞吐量比逐张处理高了将近3倍。

还有个容易被忽略的:图片预处理。统一缩放到模型最佳输入尺寸再送进去,别直接丢原图。一张5000x3000的照片和一张1024x768的照片,处理时间差好几倍。

踩过的坑和避坑建议

自建AI修图服务器最容易翻车的地方不是技术本身,而是运维和维护。你得做好长期打理的心理准备。

坑一:显存溢出。跑着跑着突然报CUDA OOM(显存不足),特别是同时处理大分辨率图片的时候。解决办法是设置最大输入尺寸限制,超过的自动缩放。

坑二:模型更新。开源社区迭代很快,新模型隔几周就出。你得有人定期关注社区动态,测试新模型效果。FlowPix编辑部就经常跟踪这些更新——我们发现不少时候新模型在特定场景下效果提升非常明显。

坑三:散热问题。显卡长时间满载运行,温度容易飙到85度以上。如果是放在办公室角落的塔式机箱,必须额外加风扇或者考虑水冷。我朋友的4090跑了一个夏天之后开始频繁降频,就是因为散热没做好。

还有一点——备份!模型文件和配置文件一定要定期备份。硬盘坏了重新下载模型、重新调参数,那种痛苦经历一次就够了。

自建 vs SaaS,怎么选?

日均处理量低于50张的,老实用SaaS服务更划算;超过200张的,自建开始有明显成本优势。中间地带看你对数据安全的重视程度。

算一笔账:主流AI修图SaaS每张图处理费用大概0.1-0.5元。一天200张,按0.2元算,月费用1200元。自建的话硬件一次性投入10000元,电费每月大概200-300元。8-10个月回本,之后就是纯省。

但自建的隐性成本是人力。你需要有人懂基本的Linux操作,能处理简单的故障排查。如果团队里完全没技术背景的人,建议先看看AI修图本地部署教程感受一下难度再做决定。

还有一种折中方案:用云GPU。像AutoDL、恒源云这类平台,按小时租显卡,RTX 4090大概2-4元/小时。旺季租、淡季停,灵活控制成本。

写在最后

说实话,自建AI修图这事门槛正在快速降低。两年前搭一套还需要折腾好几天,现在半天就能跑起来。开源社区的力量确实大,各种一键安装脚本、Docker镜像、预配置环境越来越成熟了。

如果你正在考虑自建,我的建议是:先用一台旧电脑或者租一个云GPU试水,跑通整个流程再决定要不要买硬件。别一上来就冲着4090去,万一发现自己用不上呢。

觉得这篇教程有帮助的话,转发给同样在纠结的朋友吧。有什么搭建过程中遇到的问题,也欢迎在评论区一起聊。